অবজেক্ট ডিটেক্টর টাস্ক আপনাকে একাধিক শ্রেণীর অবজেক্টের উপস্থিতি এবং অবস্থান সনাক্ত করতে দেয়। উদাহরণস্বরূপ, একটি অবজেক্ট ডিটেক্টর একটি চিত্রের মধ্যে কুকুর সনাক্ত করতে পারে। এই নির্দেশাবলী আপনাকে দেখায় কিভাবে iOS এ অবজেক্ট ডিটেক্টর টাস্ক ব্যবহার করতে হয়। এই নির্দেশাবলীতে বর্ণিত কোড নমুনা GitHub এ উপলব্ধ।

আপনি এই ওয়েব ডেমো দেখে এই কাজটি কার্যকর দেখতে পারেন। এই কাজের ক্ষমতা, মডেল এবং কনফিগারেশন বিকল্প সম্পর্কে আরও তথ্যের জন্য, ওভারভিউ দেখুন।

কোড উদাহরণ

MediaPipe টাস্কের উদাহরণ কোড হল iOS এর জন্য একটি অবজেক্ট ডিটেক্টর অ্যাপের একটি মৌলিক বাস্তবায়ন। উদাহরণটি অবিচ্ছিন্নভাবে বস্তুগুলি সনাক্ত করতে একটি ভৌত iOS ডিভাইসে ক্যামেরা ব্যবহার করে এবং বস্তুগুলিকে স্থিরভাবে সনাক্ত করতে ডিভাইস গ্যালারী থেকে ছবি এবং ভিডিওগুলিও ব্যবহার করতে পারে৷

আপনি অ্যাপটিকে আপনার নিজের iOS অ্যাপের জন্য একটি সূচনা পয়েন্ট হিসাবে ব্যবহার করতে পারেন, অথবা একটি বিদ্যমান অ্যাপ পরিবর্তন করার সময় এটি উল্লেখ করতে পারেন। অবজেক্ট ডিটেক্টর উদাহরণ কোডটি গিটহাবে হোস্ট করা হয়েছে।

কোডটি ডাউনলোড করুন

নিম্নলিখিত নির্দেশাবলী আপনাকে দেখায় কিভাবে গিট কমান্ড লাইন টুল ব্যবহার করে উদাহরণ কোডের একটি স্থানীয় অনুলিপি তৈরি করতে হয়।

উদাহরণ কোড ডাউনলোড করতে:

নিম্নলিখিত কমান্ড ব্যবহার করে গিট সংগ্রহস্থল ক্লোন করুন:

git clone https://github.com/google-ai-edge/mediapipe-samplesঐচ্ছিকভাবে, স্পার্স চেকআউট ব্যবহার করতে আপনার গিট ইনস্ট্যান্স কনফিগার করুন, যাতে আপনার কাছে অবজেক্ট ডিটেক্টর উদাহরণ অ্যাপের জন্য শুধুমাত্র ফাইল থাকে:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/object_detection/ios/

উদাহরণ কোডের একটি স্থানীয় সংস্করণ তৈরি করার পরে, আপনি MediaPipe টাস্ক লাইব্রেরি ইনস্টল করতে পারেন, Xcode ব্যবহার করে প্রকল্পটি খুলতে পারেন এবং অ্যাপটি চালাতে পারেন। নির্দেশাবলীর জন্য, iOS এর জন্য সেটআপ গাইড দেখুন।

মূল উপাদান

নিম্নলিখিত ফাইলগুলিতে অবজেক্ট ডিটেক্টর উদাহরণ অ্যাপ্লিকেশনের জন্য গুরুত্বপূর্ণ কোড রয়েছে:

- ObjectDetectorService.swift : ডিটেক্টর শুরু করে, মডেল নির্বাচন পরিচালনা করে এবং ইনপুট ডেটাতে অনুমান চালায়।

- CameraViewController.swift : লাইভ ক্যামেরা ফিড ইনপুট মোডের জন্য UI প্রয়োগ করে এবং সনাক্তকরণের ফলাফলগুলি কল্পনা করে৷

- MediaLibraryViewController.swift : স্থির চিত্র এবং ভিডিও ফাইল ইনপুট মোডের জন্য UI প্রয়োগ করে এবং সনাক্তকরণের ফলাফলগুলি কল্পনা করে।

সেটআপ

এই বিভাগে অবজেক্ট ডিটেক্টর ব্যবহার করার জন্য আপনার ডেভেলপমেন্ট এনভায়রনমেন্ট এবং কোড প্রোজেক্ট সেট আপ করার জন্য মূল ধাপগুলি বর্ণনা করে। প্ল্যাটফর্ম সংস্করণ প্রয়োজনীয়তা সহ MediaPipe কার্যগুলি ব্যবহার করার জন্য আপনার বিকাশের পরিবেশ সেট আপ করার বিষয়ে সাধারণ তথ্যের জন্য, iOS এর জন্য সেটআপ নির্দেশিকা দেখুন।

নির্ভরতা

অবজেক্ট ডিটেক্টর MediaPipeTasksVision লাইব্রেরি ব্যবহার করে, যা CocoaPods ব্যবহার করে ইনস্টল করা আবশ্যক। লাইব্রেরিটি সুইফট এবং অবজেক্টিভ-সি উভয় অ্যাপের সাথেই সামঞ্জস্যপূর্ণ এবং কোনো অতিরিক্ত ভাষা-নির্দিষ্ট সেটআপের প্রয়োজন নেই।

ম্যাকওএস-এ কোকোপড ইনস্টল করার নির্দেশাবলীর জন্য, কোকোপডস ইনস্টলেশন নির্দেশিকা পড়ুন। আপনার অ্যাপের জন্য প্রয়োজনীয় পড দিয়ে কীভাবে একটি Podfile তৈরি করবেন তার নির্দেশাবলীর জন্য, CocoaPods ব্যবহার করুন দেখুন।

নিম্নলিখিত কোড ব্যবহার করে Podfile এ MediaPipeTasksVision পড যোগ করুন:

target 'MyObjectDetectorApp' do

use_frameworks!

pod 'MediaPipeTasksVision'

end

যদি আপনার অ্যাপে ইউনিট পরীক্ষার লক্ষ্য অন্তর্ভুক্ত থাকে, তাহলে আপনার Podfile সেট আপ করার বিষয়ে অতিরিক্ত তথ্যের জন্য iOS এর জন্য সেট আপ গাইড দেখুন।

মডেল

MediaPipe অবজেক্ট ডিটেক্টর টাস্কের জন্য একটি প্রশিক্ষিত মডেল প্রয়োজন যা এই কাজের সাথে সামঞ্জস্যপূর্ণ। অবজেক্ট ডিটেক্টরের জন্য উপলব্ধ প্রশিক্ষিত মডেল সম্পর্কে আরও তথ্যের জন্য, টাস্ক ওভারভিউ মডেল বিভাগটি দেখুন।

একটি মডেল নির্বাচন করুন এবং ডাউনলোড করুন এবং Xcode ব্যবহার করে আপনার প্রকল্প ডিরেক্টরিতে যোগ করুন। আপনার Xcode প্রকল্পে ফাইলগুলি কীভাবে যুক্ত করবেন তার নির্দেশাবলীর জন্য, আপনার Xcode প্রকল্পে ফাইল এবং ফোল্ডারগুলি পরিচালনা করুন দেখুন।

আপনার অ্যাপ বান্ডেলে মডেলের পাথ নির্দিষ্ট করতে BaseOptions.modelAssetPath প্রপার্টি ব্যবহার করুন। একটি কোড উদাহরণের জন্য, পরবর্তী বিভাগ দেখুন।

টাস্ক তৈরি করুন

আপনি অবজেক্ট ডিটেক্টর টাস্ক তৈরি করতে পারেন এর ইনিশিয়ালাইজারগুলির একটিকে কল করে। ObjectDetector(options:) ইনিশিয়ালাইজার কনফিগারেশন বিকল্পগুলির জন্য মান সেট করে যার মধ্যে রয়েছে রানিং মোড, ডিসপ্লে নেম লোকেল, ফলাফলের সর্বোচ্চ সংখ্যা, কনফিডেন্স থ্রেশহোল্ড, ক্যাটাগরি অ্যালাউলিস্ট এবং ডিনালিস্ট।

আপনার যদি কাস্টমাইজড কনফিগারেশন বিকল্পগুলির সাথে একটি অবজেক্ট ডিটেক্টর শুরু করার প্রয়োজন না হয়, আপনি ডিফল্ট বিকল্পগুলির সাথে একটি অবজেক্ট ডিটেক্টর তৈরি করতে ObjectDetector(modelPath:) ইনিশিয়ালাইজার ব্যবহার করতে পারেন। কনফিগারেশন বিকল্প সম্পর্কে আরও তথ্যের জন্য, কনফিগারেশন ওভারভিউ দেখুন।

অবজেক্ট ডিটেক্টর টাস্ক 3টি ইনপুট ডেটা টাইপ সমর্থন করে: স্টিল ইমেজ, ভিডিও ফাইল এবং লাইভ ভিডিও স্ট্রিম। ডিফল্টরূপে, ObjectDetector(modelPath:) স্থির চিত্রের জন্য একটি কাজ শুরু করে। আপনি যদি ভিডিও ফাইল বা লাইভ ভিডিও স্ট্রীম প্রক্রিয়া করার জন্য আপনার কাজ শুরু করতে চান, তাহলে ভিডিও বা লাইভস্ট্রিম চলমান মোড নির্দিষ্ট করতে ObjectDetector(options:) ব্যবহার করুন। লাইভস্ট্রিম মোডের জন্য অতিরিক্ত objectDetectorLiveStreamDelegate কনফিগারেশন বিকল্পেরও প্রয়োজন, যা অবজেক্ট ডিটেক্টরকে অ্যাসিঙ্ক্রোনাসভাবে প্রতিনিধিকে সনাক্তকরণের ফলাফল প্রদান করতে সক্ষম করে।

কীভাবে টাস্ক তৈরি করতে হয় এবং অনুমান চালাতে হয় তা দেখতে আপনার চলমান মোডের সাথে সম্পর্কিত ট্যাবটি চয়ন করুন৷

সুইফট

ছবি

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .image options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

ভিডিও

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .video options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

লাইভস্ট্রিম

import MediaPipeTasksVision // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. class ObjectDetectorResultProcessor: NSObject, ObjectDetectorLiveStreamDelegate { func objectDetector( _ objectDetector: ObjectDetector, didFinishDetection objectDetectionResult: ObjectDetectorResult?, timestampInMilliseconds: Int, error: Error?) { // Process the detection result or errors here. } } let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .liveStream options.maxResults = 5 // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. let processor = ObjectDetectorResultProcessor() options.objectDetectorLiveStreamDelegate = processor let objectDetector = try ObjectDetector(options: options)

উদ্দেশ্য-C

ছবি

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeImage; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

ভিডিও

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeVideo; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

লাইভস্ট্রিম

@import MediaPipeTasksVision; // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. @interface APPObjectDetectorResultProcessor : NSObject@end @implementation MPPObjectDetectorResultProcessor - (void)objectDetector:(MPPObjectDetector *)objectDetector didFinishDetectionWithResult:(MPPObjectDetectorResult *)ObjectDetectorResult timestampInMilliseconds:(NSInteger)timestampInMilliseconds error:(NSError *)error { // Process the detection result or errors here. } @end NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeLiveStream; options.maxResults = 5; // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. APPObjectDetectorResultProcessor *processor = [APPObjectDetectorResultProcessor new]; options.objectDetectorLiveStreamDelegate = processor; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

কনফিগারেশন বিকল্প

এই টাস্কে iOS অ্যাপের জন্য নিম্নলিখিত কনফিগারেশন বিকল্প রয়েছে:

| বিকল্পের নাম | বর্ণনা | মান পরিসীমা | ডিফল্ট মান |

|---|---|---|---|

runningMode | টাস্কের জন্য চলমান মোড সেট করে। তিনটি মোড আছে: IMAGE: একক ইমেজ ইনপুট জন্য মোড. ভিডিও: একটি ভিডিওর ডিকোড করা ফ্রেমের মোড। লাইভ_স্ট্রিম: ইনপুট ডেটার লাইভস্ট্রিমের মোড, যেমন ক্যামেরা থেকে। এই মোডে, ফলাফল শ্রোতাকে অ্যাসিঙ্ক্রোনাসভাবে ফলাফল পেতে একটি শ্রোতা সেট আপ করতে কল করতে হবে। | { RunningMode.image, RunningMode.video, RunningMode.liveStream } | RunningMode.image |

displayNamesLocales | টাস্কের মডেলের মেটাডেটাতে প্রদত্ত প্রদর্শন নামের জন্য ব্যবহার করার জন্য লেবেলের ভাষা সেট করে, যদি উপলব্ধ থাকে। ইংরেজির জন্য ডিফল্ট হল en । আপনি TensorFlow Lite Metadata Writer API ব্যবহার করে একটি কাস্টম মডেলের মেটাডেটাতে স্থানীয় লেবেল যোগ করতে পারেন | স্থানীয় কোড | en |

maxResults | ফিরতে সর্বোচ্চ স্কোর করা শনাক্তকরণ ফলাফলের ঐচ্ছিক সর্বোচ্চ সংখ্যা সেট করে। | যেকোনো ইতিবাচক সংখ্যা | -1 (সমস্ত ফলাফল ফেরত দেওয়া হয়) |

scoreThreshold | ভবিষ্যদ্বাণী স্কোর থ্রেশহোল্ড সেট করে যা মডেল মেটাডেটাতে প্রদত্ত একটিকে ওভাররাইড করে (যদি থাকে)। এই মানের নিচের ফলাফল প্রত্যাখ্যান করা হয়। | কোন ভাসা | সেট করা হয়নি |

categoryAllowlist | অনুমোদিত বিভাগের নামের ঐচ্ছিক তালিকা সেট করে। যদি খালি না থাকে, শনাক্তকরণ ফলাফল যার বিভাগের নাম এই সেটে নেই তা ফিল্টার আউট করা হবে। সদৃশ বা অজানা বিভাগের নাম উপেক্ষা করা হয়। এই বিকল্পটি categoryDenylist সাথে পারস্পরিকভাবে একচেটিয়া এবং একটি ত্রুটিতে উভয় ফলাফল ব্যবহার করে। | কোনো স্ট্রিং | সেট করা হয়নি |

categoryDenylist | অনুমোদিত নয় এমন বিভাগের নামের ঐচ্ছিক তালিকা সেট করে। খালি না থাকলে, এই সেটে যার বিভাগের নাম আছে তা সনাক্তকরণের ফলাফলগুলি ফিল্টার করা হবে৷ সদৃশ বা অজানা বিভাগের নাম উপেক্ষা করা হয়। এই বিকল্পটি categoryAllowlist সাথে পারস্পরিকভাবে একচেটিয়া এবং একটি ত্রুটিতে উভয় ফলাফল ব্যবহার করে। | কোনো স্ট্রিং | সেট করা হয়নি |

লাইভস্ট্রিম কনফিগারেশন

যখন চলমান মোডটি লাইভস্ট্রিমে সেট করা হয়, তখন অবজেক্ট ডিটেক্টরের জন্য অতিরিক্ত objectDetectorLiveStreamDelegate কনফিগারেশন বিকল্পের প্রয়োজন হয়, যা ডিটেক্টরকে অ্যাসিঙ্ক্রোনাসভাবে সনাক্তকরণের ফলাফল প্রদান করতে সক্ষম করে। প্রতিনিধি objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:) পদ্ধতি প্রয়োগ করে, যা অবজেক্ট ডিটেক্টর প্রতিটি ফ্রেমের জন্য সনাক্তকরণ ফলাফল প্রক্রিয়া করার পরে কল করে।

| বিকল্পের নাম | বর্ণনা | মান পরিসীমা | ডিফল্ট মান |

|---|---|---|---|

objectDetectorLiveStreamDelegate | লাইভস্ট্রিম মোডে অ্যাসিঙ্ক্রোনাসভাবে সনাক্তকরণ ফলাফল পেতে অবজেক্ট ডিটেক্টরকে সক্ষম করে। যে ক্লাসের উদাহরণটি এই বৈশিষ্ট্যে সেট করা হয়েছে objectDetector(_:didFinishDetection:timestampInMilliseconds:error:) পদ্ধতি প্রয়োগ করতে হবে। | প্রযোজ্য নয় | সেট করা হয়নি |

ডেটা প্রস্তুত করুন

অবজেক্ট ডিটেক্টরে পাঠানোর আগে আপনাকে ইনপুট ইমেজ বা ফ্রেমটিকে MPImage অবজেক্টে রূপান্তর করতে হবে। MPImage বিভিন্ন ধরনের iOS ইমেজ ফরম্যাট সমর্থন করে এবং অনুমানের জন্য যেকোন চলমান মোডে সেগুলি ব্যবহার করতে পারে। MPImage সম্পর্কে আরও তথ্যের জন্য, MPImage API পড়ুন।

আপনার ব্যবহারের ক্ষেত্রে এবং আপনার অ্যাপ্লিকেশনের জন্য প্রয়োজনীয় চলমান মোডের উপর ভিত্তি করে একটি iOS চিত্র বিন্যাস চয়ন করুন। MPImage UIImage , CVPixelBuffer , এবং CMSampleBuffer iOS ইমেজ ফর্ম্যাটগুলি গ্রহণ করে৷

UIIমেজ

UIImage ফরম্যাট নিম্নলিখিত চলমান মোডগুলির জন্য উপযুক্ত:

ছবি: একটি অ্যাপ বান্ডেল, ব্যবহারকারীর গ্যালারি, বা

UIImageচিত্র হিসাবে ফর্ম্যাট করা ফাইল সিস্টেম থেকে ছবিগুলিকেMPImageঅবজেক্টে রূপান্তর করা যেতে পারে।ভিডিও: CGImage ফরম্যাটে ভিডিও ফ্রেম বের করতে AVAssetImageGenerator ব্যবহার করুন, তারপর সেগুলোকে

UIImageছবিতে রূপান্তর করুন।

সুইফট

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(uiImage: image)

উদ্দেশ্য-C

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

উদাহরণটি ডিফল্ট UIImage.Orientation.Up অভিযোজন সহ একটি MPImage শুরু করে। আপনি সমর্থিত UIImage.Orientation মানগুলির সাথে একটি MPImage আরম্ভ করতে পারেন। অবজেক্ট ডিটেক্টর .upMirrored , .downMirrored , .leftMirrored , .rightMirrored এর মত মিরর করা অভিযোজন সমর্থন করে না৷

UIImage সম্পর্কে আরও তথ্যের জন্য, UIImage অ্যাপল ডেভেলপার ডকুমেন্টেশন পড়ুন।

সিভিপিক্সেলবাফার

CVPixelBuffer ফর্ম্যাটটি এমন অ্যাপ্লিকেশনগুলির জন্য উপযুক্ত যা ফ্রেম তৈরি করে এবং প্রক্রিয়াকরণের জন্য iOS CoreImage ফ্রেমওয়ার্ক ব্যবহার করে৷

CVPixelBuffer ফর্ম্যাট নিম্নলিখিত চলমান মোডগুলির জন্য উপযুক্ত:

ছবি: আইওএস-এর

CoreImageফ্রেমওয়ার্ক ব্যবহার করে কিছু প্রক্রিয়াকরণের পরেCVPixelBufferছবি তৈরি করে এমন অ্যাপগুলি ইমেজ চলমান মোডে অবজেক্ট ডিটেক্টরে পাঠানো যেতে পারে।ভিডিও: ভিডিও ফ্রেমগুলি প্রক্রিয়াকরণের জন্য

CVPixelBufferফর্ম্যাটে রূপান্তরিত করা যেতে পারে, এবং তারপর ভিডিও মোডে অবজেক্ট ডিটেক্টরে পাঠানো যেতে পারে।লাইভস্ট্রিম: ফ্রেম তৈরি করতে একটি iOS ক্যামেরা ব্যবহার করে অ্যাপগুলিকে লাইভস্ট্রিম মোডে অবজেক্ট ডিটেক্টরে পাঠানোর আগে প্রক্রিয়াকরণের জন্য

CVPixelBufferফর্ম্যাটে রূপান্তরিত করা যেতে পারে।

সুইফট

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(pixelBuffer: pixelBuffer)

উদ্দেশ্য-C

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

CVPixelBuffer সম্পর্কে আরও তথ্যের জন্য, CVPixelBuffer অ্যাপল ডেভেলপার ডকুমেন্টেশন পড়ুন।

CMSampleBuffer

CMSampleBuffer ফরম্যাট একটি ইউনিফর্ম মিডিয়া ধরনের মিডিয়া নমুনা সঞ্চয় করে এবং লাইভস্ট্রিম চলমান মোডের জন্য উপযুক্ত। iOS ক্যামেরা থেকে লাইভ ফ্রেমগুলি iOS AVCaptureVideoDataOutput দ্বারা CMSampleBuffer ফর্ম্যাটে অ্যাসিঙ্ক্রোনাসভাবে বিতরণ করা হয়।

সুইফট

// Obtain a CMSampleBuffer. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(sampleBuffer: sampleBuffer)

উদ্দেশ্য-C

// Obtain a `CMSampleBuffer`. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithSampleBuffer:sampleBuffer error:nil];

CMSampleBuffer সম্পর্কে আরও তথ্যের জন্য, CMSampleBuffer অ্যাপল ডেভেলপার ডকুমেন্টেশন পড়ুন।

টাস্ক চালান

অবজেক্ট ডিটেক্টর চালানোর জন্য, নির্ধারিত চলমান মোডের জন্য নির্দিষ্ট detect() পদ্ধতি ব্যবহার করুন:

- স্থির চিত্র:

detect(image:) - ভিডিও:

detect(videoFrame:timestampInMilliseconds:) - লাইভস্ট্রিম:

detectAsync(image:)

নিম্নলিখিত কোড নমুনাগুলি এই বিভিন্ন চলমান মোডগুলিতে অবজেক্ট ডিটেক্টর চালানোর প্রাথমিক উদাহরণগুলি দেখায়:

সুইফট

ছবি

let objectDetector.detect(image:image)

ভিডিও

let objectDetector.detect(videoFrame:image)

লাইভস্ট্রিম

let objectDetector.detectAsync(image:image)

উদ্দেশ্য-C

ছবি

MPPObjectDetectorResult *result = [objectDetector detectInImage:image error:nil];

ভিডিও

MPPObjectDetectorResult *result = [objectDetector detectInVideoFrame:image timestampInMilliseconds:timestamp error:nil];

লাইভস্ট্রিম

BOOL success = [objectDetector detectAsyncInImage:image timestampInMilliseconds:timestamp error:nil];

অবজেক্ট ডিটেক্টর কোডের উদাহরণ এই প্রতিটি মোডের বাস্তবায়নকে আরও বিস্তারিতভাবে দেখায় detect(image:) , detect(videoFrame:) , এবং detectAsync(image:) । উদাহরণ কোড ব্যবহারকারীকে প্রক্রিয়াকরণ মোডগুলির মধ্যে স্যুইচ করার অনুমতি দেয় যা আপনার ব্যবহারের ক্ষেত্রে প্রয়োজন নাও হতে পারে।

নিম্নলিখিত নোট করুন:

ভিডিও মোড বা লাইভস্ট্রিম মোডে চলার সময়, আপনাকে অবজেক্ট ডিটেক্টর টাস্কে ইনপুট ফ্রেমের টাইমস্ট্যাম্পও প্রদান করতে হবে।

ইমেজ বা ভিডিও মোডে চলার সময়, অবজেক্ট ডিটেক্টর টাস্ক বর্তমান থ্রেডটিকে ব্লক করে যতক্ষণ না এটি ইনপুট ইমেজ বা ফ্রেম প্রক্রিয়াকরণ শেষ করে। বর্তমান থ্রেড ব্লক করা এড়াতে, iOS ডিসপ্যাচ বা NSOoperation ফ্রেমওয়ার্ক ব্যবহার করে একটি ব্যাকগ্রাউন্ড থ্রেডে প্রক্রিয়াকরণ চালান।

লাইভস্ট্রিম মোডে চলাকালীন, অবজেক্ট ডিটেক্টর টাস্ক অবিলম্বে ফিরে আসে এবং বর্তমান থ্রেডটিকে ব্লক করে না। এটি প্রতিটি ইনপুট ফ্রেম প্রক্রিয়াকরণের পরে সনাক্তকরণের ফলাফল সহ

objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:)পদ্ধতি ব্যবহার করে। অবজেক্ট ডিটেক্টর একটি ডেডিকেটেড সিরিয়াল ডিসপ্যাচ কিউতে অ্যাসিঙ্ক্রোনাসভাবে এই পদ্ধতিটি চালু করে। ব্যবহারকারী ইন্টারফেসে ফলাফল প্রদর্শনের জন্য, ফলাফলগুলি প্রক্রিয়াকরণের পরে প্রধান সারিতে ফলাফলগুলি প্রেরণ করুন৷ অবজেক্ট ডিটেক্টর টাস্ক যখন অন্য ফ্রেম প্রক্রিয়াকরণে ব্যস্ত থাকে তখনdetectAsyncফাংশনটি কল করা হলে, অবজেক্ট ডিটেক্টর নতুন ইনপুট ফ্রেমটিকে উপেক্ষা করে।

হ্যান্ডেল এবং প্রদর্শন ফলাফল

অনুমান চালানোর পরে, অবজেক্ট ডিটেক্টর টাস্ক একটি ObjectDetectorResult অবজেক্ট প্রদান করে যা ইনপুট ইমেজে পাওয়া বস্তুগুলির বর্ণনা দেয়।

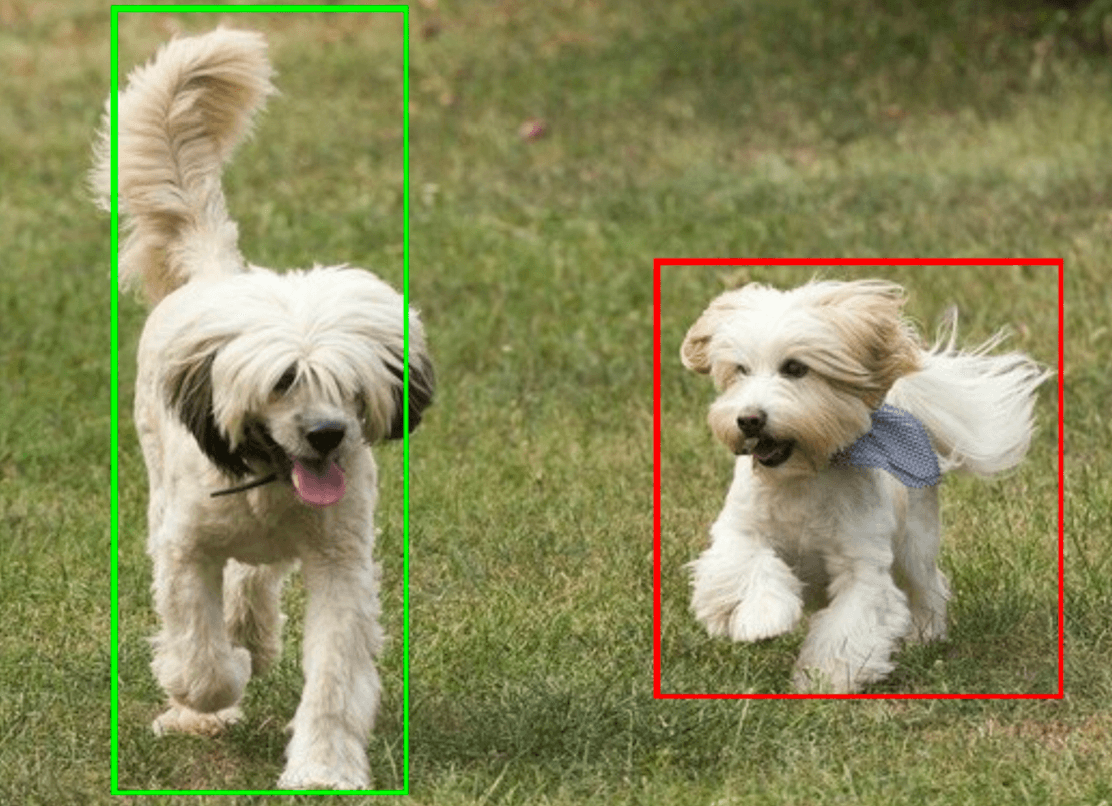

নিম্নলিখিত এই টাস্ক থেকে আউটপুট ডেটার একটি উদাহরণ দেখায়:

ObjectDetectorResult:

Detection #0:

Box: (x: 355, y: 133, w: 190, h: 206)

Categories:

index : 17

score : 0.73828

class name : dog

Detection #1:

Box: (x: 103, y: 15, w: 138, h: 369)

Categories:

index : 17

score : 0.73047

class name : dog

নিম্নলিখিত চিত্রটি টাস্ক আউটপুটের একটি ভিজ্যুয়ালাইজেশন দেখায়:

অবজেক্ট ডিটেক্টর উদাহরণ কোড প্রদর্শন করে কিভাবে টাস্ক থেকে ফিরে পাওয়া সনাক্তকরণ ফলাফল প্রদর্শন করতে হয়, বিস্তারিত জানার জন্য কোড উদাহরণ দেখুন।