API-ja Live mundëson ndërveprime zanore dhe vizuale me vonesë të ulët, në kohë reale me Gemini. Ai përpunon rrjedha të vazhdueshme audio, imazhesh dhe teksti për të ofruar përgjigje të menjëhershme, të ngjashme me ato të njerëzve, duke krijuar një përvojë të natyrshme bisedore për përdoruesit tuaj.

Rastet e përdorimit

Live API mund të përdoret për të ndërtuar agjentë zëri në kohë reale për një sërë industrish, duke përfshirë:

- Tregtia elektronike dhe shitjet me pakicë: Asistentë blerjesh që ofrojnë rekomandime të personalizuara dhe agjentë mbështetës që zgjidhin problemet e klientëve.

- Lojëra: Personazhe interaktivë jo-lojtarë (NPC), asistentë ndihmës në lojë dhe përkthim në kohë reale i përmbajtjes në lojë.

- Ndërfaqe të gjeneratës së ardhshme: Përvoja të mundësuara nga zëri dhe video në robotikë, syze inteligjente dhe automjete.

- Kujdesi shëndetësor: Shoqërues shëndetësorë për mbështetjen dhe edukimin e pacientëve.

- Shërbime financiare: Këshilltarë të inteligjencës artificiale për menaxhimin e pasurisë dhe udhëzime për investime.

- Edukimi: Mentorë të inteligjencës artificiale dhe shoqërues të nxënësve që ofrojnë udhëzime dhe reagime të personalizuara.

Karakteristikat kryesore

Live API ofron një sërë gjithëpërfshirëse veçorish për ndërtimin e agjentëve zanorë të fuqishëm:

- Mbështetje shumëgjuhëshe : Bisedoni në 70 gjuhë të mbështetura.

- Hyrje me barge : Përdoruesit mund ta ndërpresin modelin në çdo kohë për ndërveprime që i përgjigjen nevojave të përdoruesit.

- Përdorimi i mjetit : Integron mjete si thirrja e funksioneve dhe Kërkimi në Google për ndërveprime dinamike.

- Transkriptime audio : Ofron transkripte teksti si të të dhënave hyrëse nga përdoruesi ashtu edhe të atyre dalëse nga modeli.

- Audio proaktive : Ju lejon të kontrolloni kur përgjigjet modeli dhe në cilat kontekste.

- Dialog afektiv : Përshtat stilin dhe tonin e përgjigjes për t'iu përshtatur shprehjes së hyrjes së përdoruesit.

Specifikimet teknike

Tabela e mëposhtme përshkruan specifikimet teknike për Live API:

| Kategoria | Detajet |

|---|---|

| Modalitetet e të dhënave | Audio (audio PCM 16-bit i papërpunuar, 16kHz, little-endian), imazhe (JPEG <= 1FPS), tekst |

| Modalitetet e prodhimit | Audio (audio PCM 16-bit i papërpunuar, 24kHz, little-endian) |

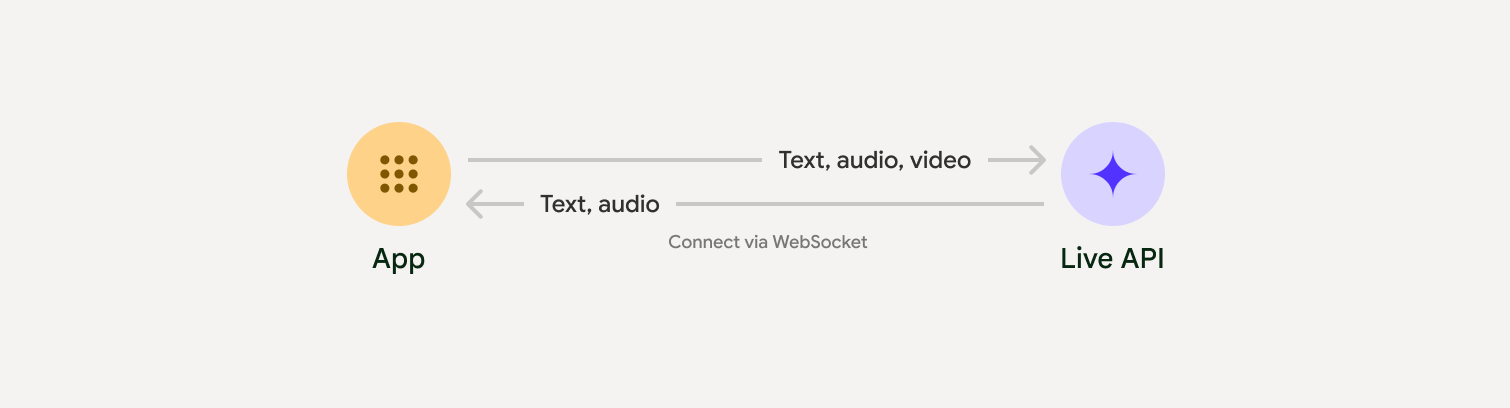

| Protokolli | Lidhje me Stateful WebSocket (WSS) |

Zgjidhni një qasje zbatimi

Kur integroheni me Live API, do t'ju duhet të zgjidhni një nga qasjet e mëposhtme të implementimit:

- Server-me-server : Backend-i juaj lidhet me Live API duke përdorur WebSockets . Zakonisht, klienti juaj dërgon të dhëna transmetimi (audio, video, tekst) në serverin tuaj, i cili më pas ia përcjell ato Live API.

- Klient-me-server : Kodi juaj i frontend-it lidhet direkt me Live API-n duke përdorur WebSockets për të transmetuar të dhëna, duke anashkaluar backend-in tuaj.

Filloni

Zgjidhni udhëzuesin që përputhet me mjedisin tuaj të zhvillimit:

Tutoriali i GenAI SDK

Lidhu me Gemini Live API duke përdorur GenAI SDK për të ndërtuar një aplikacion multimodal në kohë reale me një backend Python.

Tutoriali i WebSocket

Lidhu me Gemini Live API duke përdorur WebSockets për të ndërtuar një aplikacion multimodal në kohë reale me një frontend JavaScript dhe tokena efemeralë.

Tutoriali i ADK-së

Krijo një agjent dhe përdor Transmetimin e Agjentit të Zhvillimit të Kit (ADK) për të mundësuar komunikimin me zë dhe video.

Integrimet e partnerëve

Për të përmirësuar zhvillimin e aplikacioneve audio dhe video në kohë reale, mund të përdorni një integrim të palës së tretë që mbështet Gemini Live API mbi WebRTC ose WebSockets.

Përdorni API-n Gemini Live me agjentët LiveKit.

Pipecat nga DailyKrijo një chatbot me inteligjencë artificiale në kohë reale duke përdorur Gemini Live dhe Pipecat.

Fishjam nga Software MansionKrijoni aplikacione transmetimi të drejtpërdrejtë të videos dhe audios me Fishjam.

Agjentët e Vizionit sipas RrjedhësNdërtoni aplikacione të inteligjencës artificiale me zë dhe video në kohë reale me Vision Agents.

VoximplantLidhni thirrjet hyrëse dhe dalëse me Live API me Voximplant.

AgoraNdërtoni aplikacione të AI bisedore në kohë reale me Agora.

SDK-ja e inteligjencës artificiale të FirebaseFilloni me Gemini Live API duke përdorur Firebase AI Logic.