Wykrywacze obiektów mogą identyfikować, które z znanego zbioru obiektów mogą być obecne, i podawać informacje o ich położeniu na danym obrazie lub w strumieniu wideo. Detektor obiektów jest trenowany do wykrywania obecności i lokalizacji wielu klas obiektów. Na przykład model może być trenowany na obrazach zawierających różne owoce wraz z etykietą określającą klasę owoców (np. jabłko, banan lub truskawka) oraz danymi określającymi, gdzie każdy obiekt pojawia się na obrazie. Więcej informacji o detektorach obiektów znajdziesz w przykładzie wykrywania obiektów.

Użyj interfejsu API biblioteki zadań ObjectDetector, aby wdrożyć w aplikacjach mobilnych własne detektory obiektów lub detektory wstępnie wytrenowane.

Kluczowe funkcje interfejsu ObjectDetector API

Przetwarzanie obrazu wejściowego, w tym obracanie, zmiana rozmiaru i konwersja przestrzeni kolorów.

Etykieta lokalizacji na mapie.

Próg wyniku do filtrowania wyników.

Wyniki wykrywania k najbardziej prawdopodobnych obiektów.

Lista dozwolonych i odrzuconych etykiet.

Obsługiwane modele detektorów obiektów

Te modele są zgodne z ObjectDetectorAPI.

Wstępnie wytrenowane modele wykrywania obiektów w TensorFlow Hub.

Modele utworzone przez AutoML Vision Edge Object Detection.

Modele utworzone przez TensorFlow Lite Model Maker do wykrywania obiektów.

modele niestandardowe, które spełniają wymagania dotyczące zgodności modeli;

Uruchamianie wnioskowania w Javie

Przykład użycia ObjectDetector w aplikacji na Androida znajdziesz w aplikacji referencyjnej do wykrywania obiektów.

Krok 1. Zaimportuj zależność Gradle i inne ustawienia

Skopiuj plik modelu .tflite do katalogu zasobów modułu Androida, w którym będzie uruchamiany model. Określ, że plik nie powinien być kompresowany, i dodaj bibliotekę TensorFlow Lite do pliku build.gradle modułu:

android {

// Other settings

// Specify tflite file should not be compressed for the app apk

aaptOptions {

noCompress "tflite"

}

}

dependencies {

// Other dependencies

// Import the Task Vision Library dependency

implementation 'org.tensorflow:tensorflow-lite-task-vision'

// Import the GPU delegate plugin Library for GPU inference

implementation 'org.tensorflow:tensorflow-lite-gpu-delegate-plugin'

}

Krok 2. Korzystanie z modelu

// Initialization

ObjectDetectorOptions options =

ObjectDetectorOptions.builder()

.setBaseOptions(BaseOptions.builder().useGpu().build())

.setMaxResults(1)

.build();

ObjectDetector objectDetector =

ObjectDetector.createFromFileAndOptions(

context, modelFile, options);

// Run inference

List<Detection> results = objectDetector.detect(image);

Więcej opcji konfigurowania ObjectDetector znajdziesz w kodzie źródłowym i dokumentacji Javadoc.

Uruchamianie wnioskowania na iOS

Krok 1. Zainstaluj zależności

Biblioteka zadań obsługuje instalację za pomocą CocoaPods. Upewnij się, że w systemie jest zainstalowany CocoaPods. Instrukcje znajdziesz w przewodniku instalacji CocoaPods.

Szczegółowe informacje o dodawaniu podów do projektu w Xcode znajdziesz w przewodniku po CocoaPods.

Dodaj pod TensorFlowLiteTaskVision do pliku Podfile.

target 'MyAppWithTaskAPI' do

use_frameworks!

pod 'TensorFlowLiteTaskVision'

end

Upewnij się, że model .tflite, którego będziesz używać do wnioskowania, znajduje się w pakiecie aplikacji.

Krok 2. Korzystanie z modelu

Swift

// Imports

import TensorFlowLiteTaskVision

// Initialization

guard let modelPath = Bundle.main.path(forResource: "ssd_mobilenet_v1",

ofType: "tflite") else { return }

let options = ObjectDetectorOptions(modelPath: modelPath)

// Configure any additional options:

// options.classificationOptions.maxResults = 3

let detector = try ObjectDetector.detector(options: options)

// Convert the input image to MLImage.

// There are other sources for MLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

guard let image = UIImage (named: "cats_and_dogs.jpg"), let mlImage = MLImage(image: image) else { return }

// Run inference

let detectionResult = try detector.detect(mlImage: mlImage)

Objective-C

// Imports

#import <TensorFlowLiteTaskVision/TensorFlowLiteTaskVision.h>

// Initialization

NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"ssd_mobilenet_v1" ofType:@"tflite"];

TFLObjectDetectorOptions *options = [[TFLObjectDetectorOptions alloc] initWithModelPath:modelPath];

// Configure any additional options:

// options.classificationOptions.maxResults = 3;

TFLObjectDetector *detector = [TFLObjectDetector objectDetectorWithOptions:options

error:nil];

// Convert the input image to MLImage.

UIImage *image = [UIImage imageNamed:@"dogs.jpg"];

// There are other sources for GMLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

GMLImage *gmlImage = [[GMLImage alloc] initWithImage:image];

// Run inference

TFLDetectionResult *detectionResult = [detector detectWithGMLImage:gmlImage error:nil];

Więcej opcji konfigurowania TFLObjectDetector znajdziesz w kodzie źródłowym.

Uruchamianie wnioskowania w Pythonie

Krok 1. Zainstaluj pakiet pip

pip install tflite-support

Krok 2. Korzystanie z modelu

# Imports

from tflite_support.task import vision

from tflite_support.task import core

from tflite_support.task import processor

# Initialization

base_options = core.BaseOptions(file_name=model_path)

detection_options = processor.DetectionOptions(max_results=2)

options = vision.ObjectDetectorOptions(base_options=base_options, detection_options=detection_options)

detector = vision.ObjectDetector.create_from_options(options)

# Alternatively, you can create an object detector in the following manner:

# detector = vision.ObjectDetector.create_from_file(model_path)

# Run inference

image = vision.TensorImage.create_from_file(image_path)

detection_result = detector.detect(image)

Więcej opcji konfigurowania ObjectDetector znajdziesz w kodzie źródłowym.

Uruchamianie wnioskowania w C++

// Initialization

ObjectDetectorOptions options;

options.mutable_base_options()->mutable_model_file()->set_file_name(model_path);

std::unique_ptr<ObjectDetector> object_detector = ObjectDetector::CreateFromOptions(options).value();

// Create input frame_buffer from your inputs, `image_data` and `image_dimension`.

// See more information here: tensorflow_lite_support/cc/task/vision/utils/frame_buffer_common_utils.h

std::unique_ptr<FrameBuffer> frame_buffer = CreateFromRgbRawBuffer(

image_data, image_dimension);

// Run inference

const DetectionResult result = object_detector->Detect(*frame_buffer).value();

Więcej opcji konfigurowania ObjectDetector znajdziesz w kodzie źródłowym.

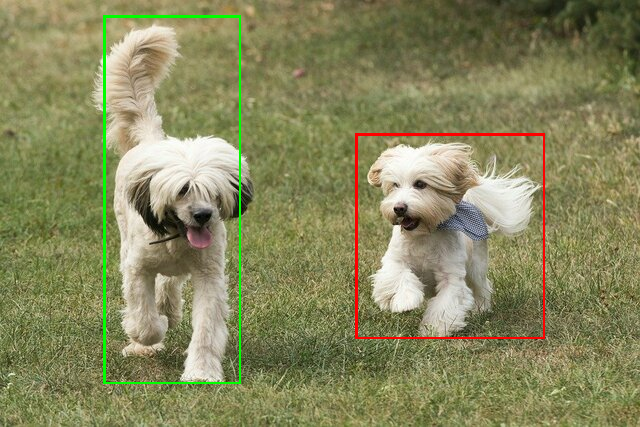

Przykładowe wyniki

Oto przykład wyników wykrywania modelu ssd mobilenet v1 z TensorFlow Hub.

Results:

Detection #0 (red):

Box: (x: 355, y: 133, w: 190, h: 206)

Top-1 class:

index : 17

score : 0.73828

class name : dog

Detection #1 (green):

Box: (x: 103, y: 15, w: 138, h: 369)

Top-1 class:

index : 17

score : 0.73047

class name : dog

Wyrenderuj ramki ograniczające na obrazie wejściowym:

Wypróbuj proste narzędzie demonstracyjne CLI dla ObjectDetector z własnym modelem i danymi testowymi.

Wymagania dotyczące zgodności modeli

Interfejs ObjectDetector API oczekuje modelu TFLite z obowiązkowymi metadanymi modelu TFLite. Zobacz przykłady tworzenia metadanych dla detektorów obiektów za pomocą interfejsu API do tworzenia metadanych TensorFlow Lite.

Zgodne modele detektorów obiektów powinny spełniać te wymagania:

Tensor obrazu wejściowego: (kTfLiteUInt8/kTfLiteFloat32)

- obraz wejściowy o rozmiarze

[batch x height x width x channels]. - wnioskowanie zbiorcze nie jest obsługiwane (

batchmusi mieć wartość 1). - obsługiwane są tylko dane wejściowe RGB (wartość

channelsmusi wynosić 3); - Jeśli typ to kTfLiteFloat32, do metadanych muszą być dołączone opcje normalizacji, aby można było normalizować dane wejściowe.

- obraz wejściowy o rozmiarze

Tensory wyjściowe muszą być 4 wyjściami operacji

DetectionPostProcess, czyli:- Tensor lokalizacji (kTfLiteFloat32)

- tensor o rozmiarze

[1 x num_results x 4], wewnętrzna tablica reprezentująca ramki ograniczające w formacie [góra, lewo, prawo, dół]. - Właściwości BoundingBoxProperties muszą być dołączone do metadanych i muszą określać

type=BOUNDARIESoraz `coordinate_type=RATIO. Tensor klas (kTfLiteFloat32)

tensor o rozmiarze

[1 x num_results], gdzie każda wartość reprezentuje indeks klasy w postaci liczby całkowitej.opcjonalne (ale zalecane) mapy etykiet można dołączyć jako pliki powiązane typu TENSOR_VALUE_LABELS, zawierające po jednej etykiecie w wierszu. Zobacz przykładowy plik etykiet. Pierwszy taki element AssociatedFile (jeśli występuje) jest używany do wypełnienia pola

class_namew wynikach. Poledisplay_namejest wypełniane na podstawie pola AssociatedFile (jeśli istnieje), którego ustawienia regionalne są zgodne z polemdisplay_names_localepolaObjectDetectorOptionsużytego podczas tworzenia (domyślnie „en”, czyli język angielski). Jeśli żadne z nich nie są dostępne, wypełnione zostanie tylko poleindexw wynikach.Tensor wyników (kTfLiteFloat32)

tensor o rozmiarze

[1 x num_results], którego każda wartość reprezentuje wynik wykrytego obiektu.Liczba tensora wykrywania (kTfLiteFloat32)

liczba całkowita num_results jako tensor o rozmiarze

[1].