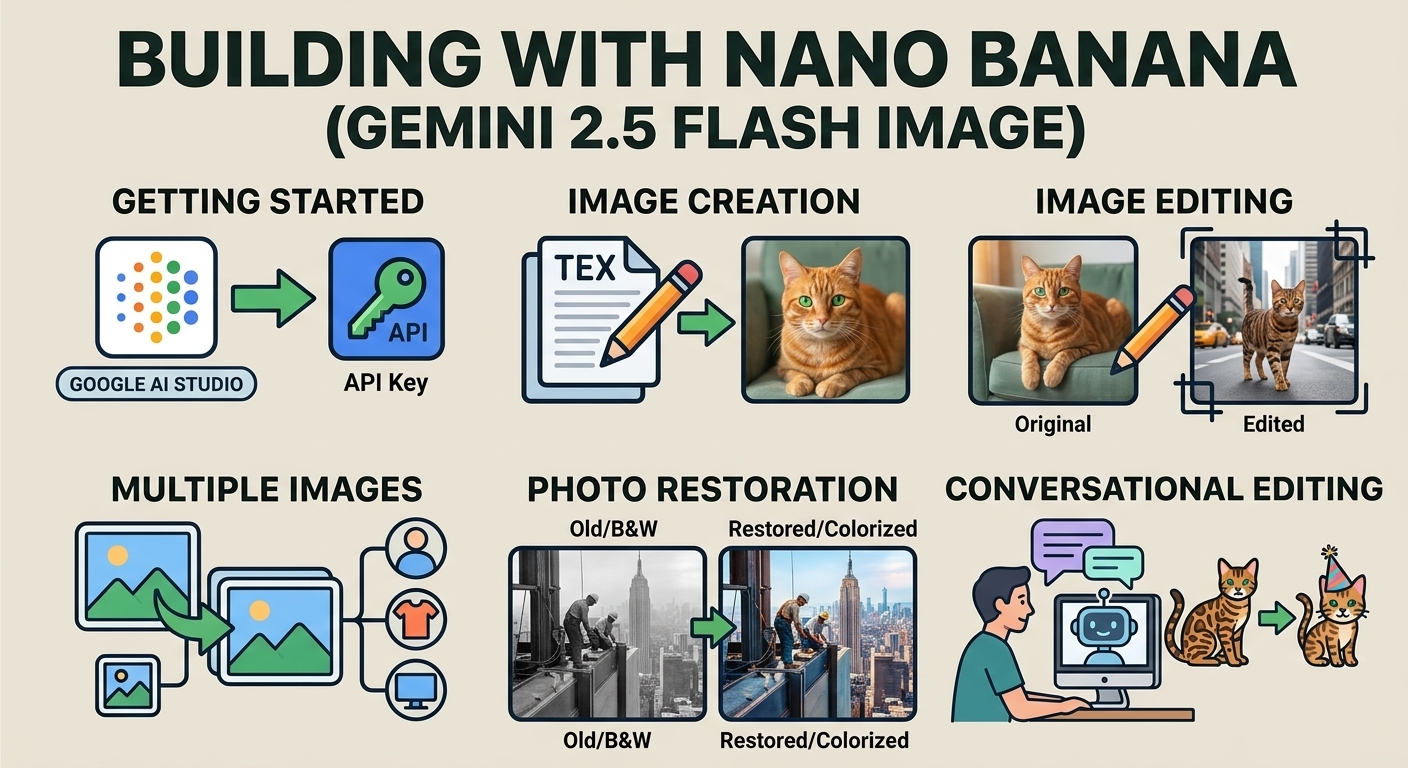

Geração de imagens com o Nano Banana

- Teste um app do Nano Banana 2

- Ou crie o seu com comandos:

-

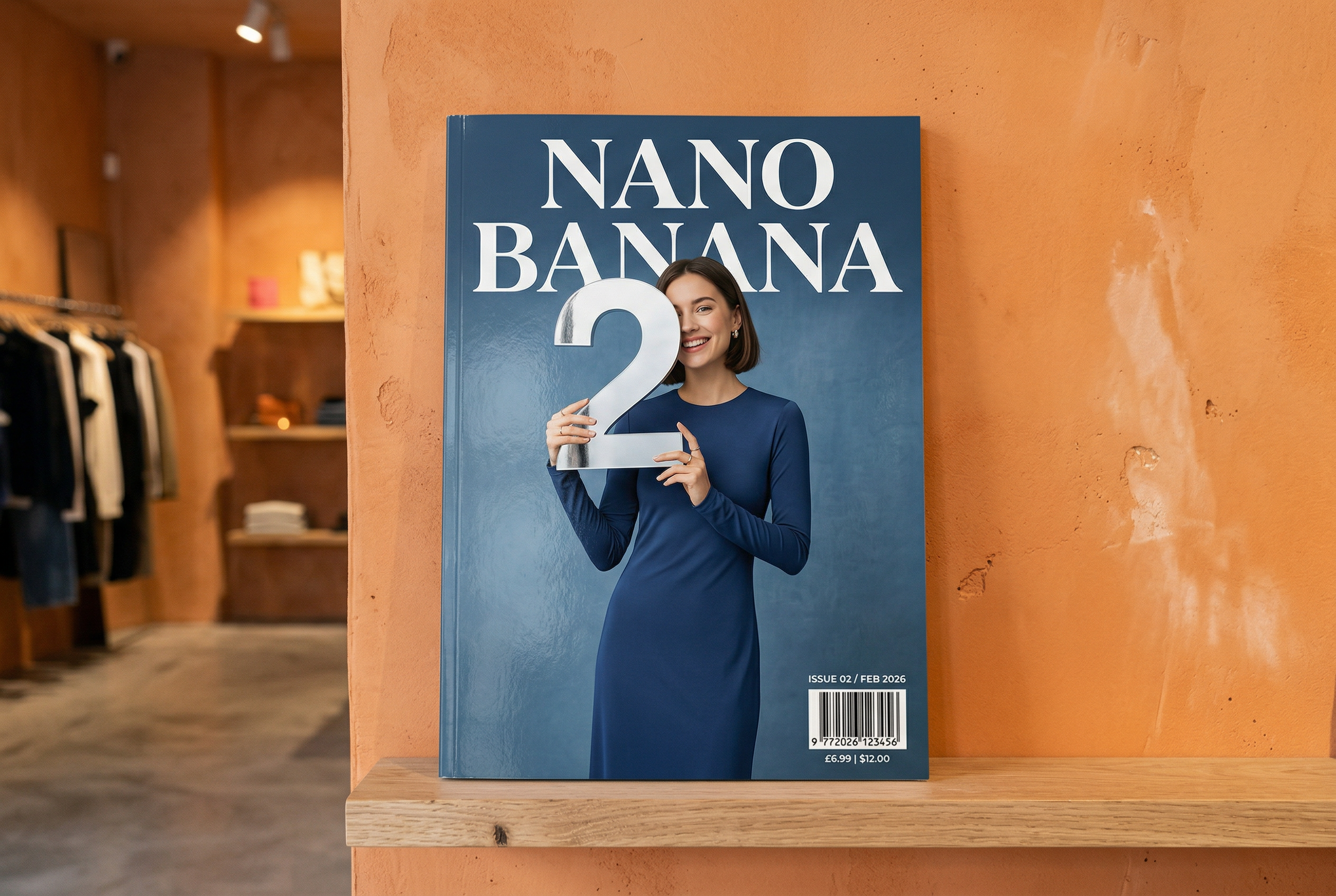

Gerado pelo Nano Banana 2 Comando: "Uma foto da capa brilhante de uma revista. A capa azul minimalista tem as palavras Nano Banana em negrito e grandes. O texto está em uma fonte serifada e preenche a visualização. Nenhum outro texto. Na frente do texto, há um retrato de uma pessoa com um vestido elegante e minimalista. Ela está segurando o número 2, que é o ponto focal.

Coloque o número de referência e a data "Fev 2026" no canto junto com um código de barras. A revista está em uma prateleira contra uma parede laranja rebocada, dentro de uma loja de design.Criar fotos profissionais de produtos no AI Studio -

Gerado pelo Nano Banana Pro Comando: "Apresente uma cena de desenho animado 3D em miniatura isométrica clara, vista de cima para baixo com 45° de inclinação, de Londres, com os marcos e elementos arquitetônicos mais icônicos. Use texturas suaves e refinadas com materiais PBR realistas e iluminação e sombras suaves e realistas. Integre as condições climáticas atuais diretamente ao ambiente da cidade para criar uma atmosfera imersiva. Use uma composição limpa e minimalista com um fundo macio e de cor sólida. Na parte superior central, coloque o título "Londres" em texto grande e em negrito, um ícone de clima em destaque abaixo dele e, em seguida, a data (texto pequeno) e a temperatura (texto médio). Todo o texto precisa estar centralizado com espaçamento consistente e pode se sobrepor sutilmente aos topos dos edifícios".Saiba mais sobre o embasamento de pesquisa e teste no AI Studio -

Gerado pelo Nano Banana 2 Comando: "Use a pesquisa por imagens para encontrar imagens precisas de um pássaro quetzal resplandecente. Crie um plano de fundo 3:2 lindo dessa ave, com um gradiente natural de cima para baixo e composição minimalista."Use a ancoragem da Pesquisa de imagens do Google com o Nano Banana 2. Teste no AI Studio -

Gerado pelo Nano Banana Pro Comando: "Coloque este logotipo em um anúncio sofisticado de um perfume com aroma de banana. O logotipo está perfeitamente integrado à garrafa".Teste a preservação de detalhes de alta fidelidade do Nano Banana no AI Studio -

Gerado pelo Nano Banana Pro Comando: "Uma foto de uma cena cotidiana em um café movimentado que serve café da manhã. Em primeiro plano, um homem de anime com cabelo azul, uma das pessoas é um esboço a lápis, outra é uma pessoa de animação com massa de modelar"Teste diferentes estilos artísticos com o Nano Banana no AI Studio -

Gerado pelo Nano Banana Pro Comando: "Use a pesquisa para saber como foi recebido o lançamento do Gemini 3 Flash. Use essas informações para escrever um pequeno artigo sobre o assunto (com títulos). Retorne uma foto do artigo como ele apareceu em uma revista brilhante focada em design. É uma foto de uma única página dobrada, mostrando o artigo sobre o Gemini 3 Flash. Uma foto principal. Título em serifada." -

Gerado pelo Nano Banana Pro Comando: "Um ícone representando um cachorro fofo. O fundo é branco. Faça os ícones em um estilo 3D colorido e tátil. Sem texto."Crie ícones, adesivos e recursos com o Nano Banana no AI Studio -

Gerado pelo Nano Banana 2 Comando: "Crie uma foto perfeitamente isométrica. Não é uma miniatura, é uma foto que foi tirada e ficou perfeitamente isométrica. É uma foto de um lindo jardim moderno. Há uma grande piscina em forma de 2 e as palavras: Nano Banana 2."Teste a geração de imagens fotorrealistas no AI Studio

Nano Banana é o nome dos recursos nativos de geração de imagens do Gemini. O Gemini pode gerar e processar imagens de forma conversacional com texto, imagens ou uma combinação dos dois. Isso permite criar, editar e fazer iterações em recursos visuais com controle incomparável.

Nano Banana se refere a três modelos distintos disponíveis na API Gemini:

- Nano Banana 2: o modelo Gemini 3.1 Flash Image (

gemini-3.1-flash-image). Esse modelo serve como a contraparte de alta eficiência do Gemini 3.1 Pro Image, otimizado para velocidade e casos de uso de desenvolvedores de alto volume. - Nano Banana Pro: o modelo Imagens no Gemini 3.1 Pro (

gemini-3-pro-image). Ele foi projetado para produção profissional de recursos, usando raciocínio avançado ("Pensamento") para seguir instruções complexas e renderizar texto de alta fidelidade. - Nano Banana: o modelo Gemini 2.5 Flash Image (

gemini-2.5-flash-image) foi projetado para velocidade e eficiência, otimizado para tarefas de alto volume e baixa latência.

Todas as imagens geradas incluem uma marca-d'água do SynthID.

Geração de imagens (conversão de texto em imagem)

Python

from google import genai

from google.genai import types

from PIL import Image

client = genai.Client()

prompt = ("Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme")

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=[prompt],

)

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save("generated_image.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const prompt =

"Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme";

const response = await ai.models.generateContent({

model: "gemini-3.1-flash-image",

contents: prompt,

});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("gemini-native-image.png", buffer);

console.log("Image saved as gemini-native-image.png");

}

}

}

main();

Go

package main

import (

"context"

"fmt"

"log"

"os"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

result, _ := client.Models.GenerateContent(

ctx,

"gemini-3.1-flash-image",

genai.Text("Create a picture of a nano banana dish in a " +

" fancy restaurant with a Gemini theme"),

)

for _, part := range result.Candidates[0].Content.Parts {

if part.Text != "" {

fmt.Println(part.Text)

} else if part.InlineData != nil {

imageBytes := part.InlineData.Data

outputFilename := "gemini_generated_image.png"

_ = os.WriteFile(outputFilename, imageBytes, 0644)

}

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.Part;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Paths;

public class TextToImage {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image",

"Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme",

config);

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("_01_generated_image.png"), blob.data().get());

}

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class TextToImage {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme" }

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("generated_image.png", imageBytes);

Console.WriteLine("Image saved as generated_image.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{

"parts": [

{"text": "Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme"}

]

}]

}'

Edição de imagens (texto e imagem para imagem)

Lembrete: confira se você tem os direitos necessários sobre as imagens que enviar. Não gere conteúdo que viole os direitos de terceiros, incluindo vídeos ou imagens que enganem, assediem ou prejudiquem pessoas. O uso deste serviço de IA generativa está sujeito à nossa Política de uso proibido.

Forneça uma imagem e use comandos de texto para adicionar, remover ou modificar elementos, mudar o estilo ou ajustar a gradação de cores.

O exemplo a seguir demonstra o upload de imagens codificadas em base64.

Para várias imagens, payloads maiores e tipos MIME compatíveis, consulte a página Entendimento de imagens.

Python

from google import genai

from google.genai import types

from PIL import Image

client = genai.Client()

prompt = (

"Create a picture of my cat eating a nano-banana in a "

"fancy restaurant under the Gemini constellation",

)

image = Image.open("/path/to/cat_image.png")

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=[prompt, image],

)

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save("generated_image.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const imagePath = "path/to/cat_image.png";

const imageData = fs.readFileSync(imagePath);

const base64Image = imageData.toString("base64");

const prompt = [

{ text: "Create a picture of my cat eating a nano-banana in a" +

"fancy restaurant under the Gemini constellation" },

{

inlineData: {

mimeType: "image/png",

data: base64Image,

},

},

];

const response = await ai.models.generateContent({

model: "gemini-3.1-flash-image",

contents: prompt,

});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("gemini-native-image.png", buffer);

console.log("Image saved as gemini-native-image.png");

}

}

}

main();

Go

package main

import (

"context"

"fmt"

"log"

"os"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

imagePath := "/path/to/cat_image.png"

imgData, _ := os.ReadFile(imagePath)

parts := []*genai.Part{

genai.NewPartFromText("Create a picture of my cat eating a nano-banana in a fancy restaurant under the Gemini constellation"),

&genai.Part{

InlineData: &genai.Blob{

MIMEType: "image/png",

Data: imgData,

},

},

}

contents := []*genai.Content{

genai.NewContentFromParts(parts, genai.RoleUser),

}

result, _ := client.Models.GenerateContent(

ctx,

"gemini-3.1-flash-image",

contents,

)

for _, part := range result.Candidates[0].Content.Parts {

if part.Text != "" {

fmt.Println(part.Text)

} else if part.InlineData != nil {

imageBytes := part.InlineData.Data

outputFilename := "gemini_generated_image.png"

_ = os.WriteFile(outputFilename, imageBytes, 0644)

}

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.Content;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.Part;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Path;

import java.nio.file.Paths;

public class TextAndImageToImage {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image",

Content.fromParts(

Part.fromText("""

Create a picture of my cat eating a nano-banana in

a fancy restaurant under the Gemini constellation

"""),

Part.fromBytes(

Files.readAllBytes(

Path.of("src/main/resources/cat.jpg")),

"image/jpeg")),

config);

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("gemini_generated_image.png"), blob.data().get());

}

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class TextAndImageToImage {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "Create a picture of my cat eating a nano-banana in a fancy restaurant under the Gemini constellation" },

new Part

{

FileData = new FileData { FileUri = "file:///path/to/cat_image.png" }

}

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("gemini_generated_image.png", imageBytes);

Console.WriteLine("Image saved as gemini_generated_image.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-d "{

\"contents\": [{

\"parts\":[

{\"text\": \"'Create a picture of my cat eating a nano-banana in a fancy restaurant under the Gemini constellation\"},

{

\"inline_data\": {

\"mime_type\":\"image/jpeg\",

\"data\": \"<BASE64_IMAGE_DATA>\"

}

}

]

}]

}"

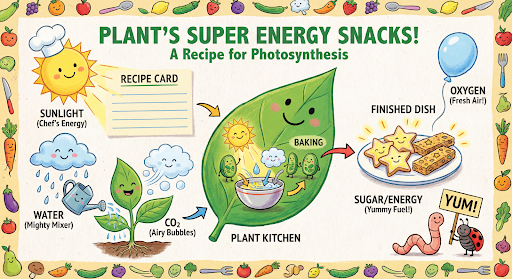

Edição de imagens em várias etapas

Continue gerando e editando imagens de forma conversacional. O chat ou a conversa em vários turnos é a maneira recomendada de iterar imagens. O exemplo a seguir mostra um comando para gerar um infográfico sobre a fotossíntese.

Python

from google import genai

from google.genai import types

client = genai.Client()

chat = client.chats.create(

model="gemini-3.1-flash-image",

config=types.GenerateContentConfig(

response_modalities=['TEXT', 'IMAGE'],

tools=[{"google_search": {}}]

)

)

message = "Create a vibrant infographic that explains photosynthesis as if it were a recipe for a plant's favorite food. Show the \"ingredients\" (sunlight, water, CO2) and the \"finished dish\" (sugar/energy). The style should be like a page from a colorful kids' cookbook, suitable for a 4th grader."

response = chat.send_message(message)

for part in response.parts:

if part.text is not None:

print(part.text)

elif image:= part.as_image():

image.save("photosynthesis.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

const ai = new GoogleGenAI({});

async function main() {

const chat = ai.chats.create({

model: "gemini-3.1-flash-image",

config: {

responseModalities: ['TEXT', 'IMAGE'],

tools: [{googleSearch: {}}],

},

});

}

await main();

const message = "Create a vibrant infographic that explains photosynthesis as if it were a recipe for a plant's favorite food. Show the \"ingredients\" (sunlight, water, CO2) and the \"finished dish\" (sugar/energy). The style should be like a page from a colorful kids' cookbook, suitable for a 4th grader."

let response = await chat.sendMessage({message});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("photosynthesis.png", buffer);

console.log("Image saved as photosynthesis.png");

}

}

Go

package main

import (

"context"

"fmt"

"log"

"os"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

defer client.Close()

model := client.GenerativeModel("gemini-3.1-flash-image")

model.GenerationConfig = &pb.GenerationConfig{

ResponseModalities: []pb.ResponseModality{genai.Text, genai.Image},

}

chat := model.StartChat()

message := "Create a vibrant infographic that explains photosynthesis as if it were a recipe for a plant's favorite food. Show the \"ingredients\" (sunlight, water, CO2) and the \"finished dish\" (sugar/energy). The style should be like a page from a colorful kids' cookbook, suitable for a 4th grader."

resp, err := chat.SendMessage(ctx, genai.Text(message))

if err != nil {

log.Fatal(err)

}

for _, part := range resp.Candidates[0].Content.Parts {

if txt, ok := part.(genai.Text); ok {

fmt.Printf("%s", string(txt))

} else if img, ok := part.(genai.ImageData); ok {

err := os.WriteFile("photosynthesis.png", img.Data, 0644)

if err != nil {

log.Fatal(err)

}

}

}

}

Java

import com.google.genai.Chat;

import com.google.genai.Client;

import com.google.genai.types.Content;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.GoogleSearch;

import com.google.genai.types.ImageConfig;

import com.google.genai.types.Part;

import com.google.genai.types.RetrievalConfig;

import com.google.genai.types.Tool;

import com.google.genai.types.ToolConfig;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Path;

import java.nio.file.Paths;

public class MultiturnImageEditing {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.tools(Tool.builder()

.googleSearch(GoogleSearch.builder().build())

.build())

.build();

Chat chat = client.chats.create("gemini-3.1-flash-image", config);

GenerateContentResponse response = chat.sendMessage("""

Create a vibrant infographic that explains photosynthesis

as if it were a recipe for a plant's favorite food.

Show the "ingredients" (sunlight, water, CO2)

and the "finished dish" (sugar/energy).

The style should be like a page from a colorful

kids' cookbook, suitable for a 4th grader.

""");

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("photosynthesis.png"), blob.data().get());

}

}

}

// ...

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class MultiturnImageEditing {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "Create a vibrant infographic that explains photosynthesis as if it were a recipe for a plant's favorite food. Show the \"ingredients\" (sunlight, water, CO2) and the \"finished dish\" (sugar/energy). The style should be like a page from a colorful kids' cookbook, suitable for a 4th grader." }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "TEXT", "IMAGE" },

Tools = new List<Tool> { new Tool { GoogleSearch = new GoogleSearch() } }

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("photosynthesis.png", imageBytes);

Console.WriteLine("Image saved as photosynthesis.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{

"role": "user",

"parts": [

{"text": "Create a vibrant infographic that explains photosynthesis as if it were a recipe for a plants favorite food. Show the \"ingredients\" (sunlight, water, CO2) and the \"finished dish\" (sugar/energy). The style should be like a page from a colorful kids cookbook, suitable for a 4th grader."}

]

}],

"generationConfig": {

"responseModalities": ["TEXT", "IMAGE"]

}

}'

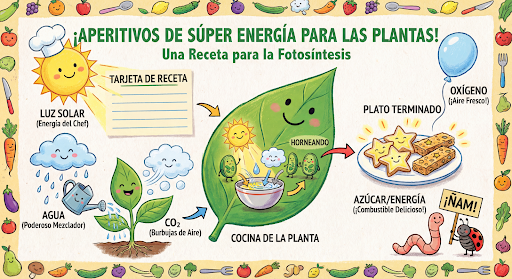

Em seguida, use o mesmo chat para mudar o idioma do gráfico para espanhol.

Python

message = "Update this infographic to be in Spanish. Do not change any other elements of the image."

aspect_ratio = "16:9" # "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9"

resolution = "2K" # "512", "1K", "2K", "4K"

response = chat.send_message(message,

config=types.GenerateContentConfig(

response_format={"image": {aspect_ratio: aspect_ratio, image_size: resolution}},

))

for part in response.parts:

if part.text is not None:

print(part.text)

elif image:= part.as_image():

image.save("photosynthesis_spanish.png")

JavaScript

const message = 'Update this infographic to be in Spanish. Do not change any other elements of the image.';

const aspectRatio = '16:9';

const resolution = '2K';

let response = await chat.sendMessage({

message,

config: {

responseModalities: ['TEXT', 'IMAGE'],

responseFormat: {

image: {

aspectRatio: aspectRatio,

imageSize: resolution,

}

},

tools: [{googleSearch: {}}],

},

});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("photosynthesis2.png", buffer);

console.log("Image saved as photosynthesis2.png");

}

}

Go

message = "Update this infographic to be in Spanish. Do not change any other elements of the image."

aspect_ratio = "16:9" // "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9"

resolution = "2K" // "512", "1K", "2K", "4K"

model.GenerationConfig.ImageConfig = &pb.ImageConfig{

AspectRatio: aspect_ratio,

ImageSize: resolution,

}

resp, err = chat.SendMessage(ctx, genai.Text(message))

if err != nil {

log.Fatal(err)

}

for _, part := range resp.Candidates[0].Content.Parts {

if txt, ok := part.(genai.Text); ok {

fmt.Printf("%s", string(txt))

} else if img, ok := part.(genai.ImageData); ok {

err := os.WriteFile("photosynthesis_spanish.png", img.Data, 0644)

if err != nil {

log.Fatal(err)

}

}

}

Java

String aspectRatio = "16:9"; // "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9"

String resolution = "2K"; // "512", "1K", "2K", "4K"

config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.imageConfig(ImageConfig.builder()

.aspectRatio(aspectRatio)

.imageSize(resolution)

.build())

.build();

response = chat.sendMessage(

"Update this infographic to be in Spanish. " +

"Do not change any other elements of the image.",

config);

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("photosynthesis_spanish.png"), blob.data().get());

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class MultiturnImageEditingSpanish {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "Update this infographic to be in Spanish. Do not change any other elements of the image." }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "TEXT", "IMAGE" },

ImageConfig = new ImageConfig

{

AspectRatio = "16:9",

ImageSize = "2K"

}

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("photosynthesis_spanish.png", imageBytes);

Console.WriteLine("Image saved as photosynthesis_spanish.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-d '{

"contents": [

{

"role": "user",

"parts": [{"text": "Create a vibrant infographic that explains photosynthesis..."}]

},

{

"role": "model",

"parts": [{"inline_data": {"mime_type": "image/png", "data": "<PREVIOUS_IMAGE_DATA>"}}]

},

{

"role": "user",

"parts": [{"text": "Update this infographic to be in Spanish. Do not change any other elements of the image."}]

}

],

"tools": [{"google_search": {}}],

"generationConfig": {

"responseModalities": ["TEXT", "IMAGE"],

"responseFormat": {

"image": {

"aspectRatio": "16:9",

"imageSize": "2K"

}

}

}

}'

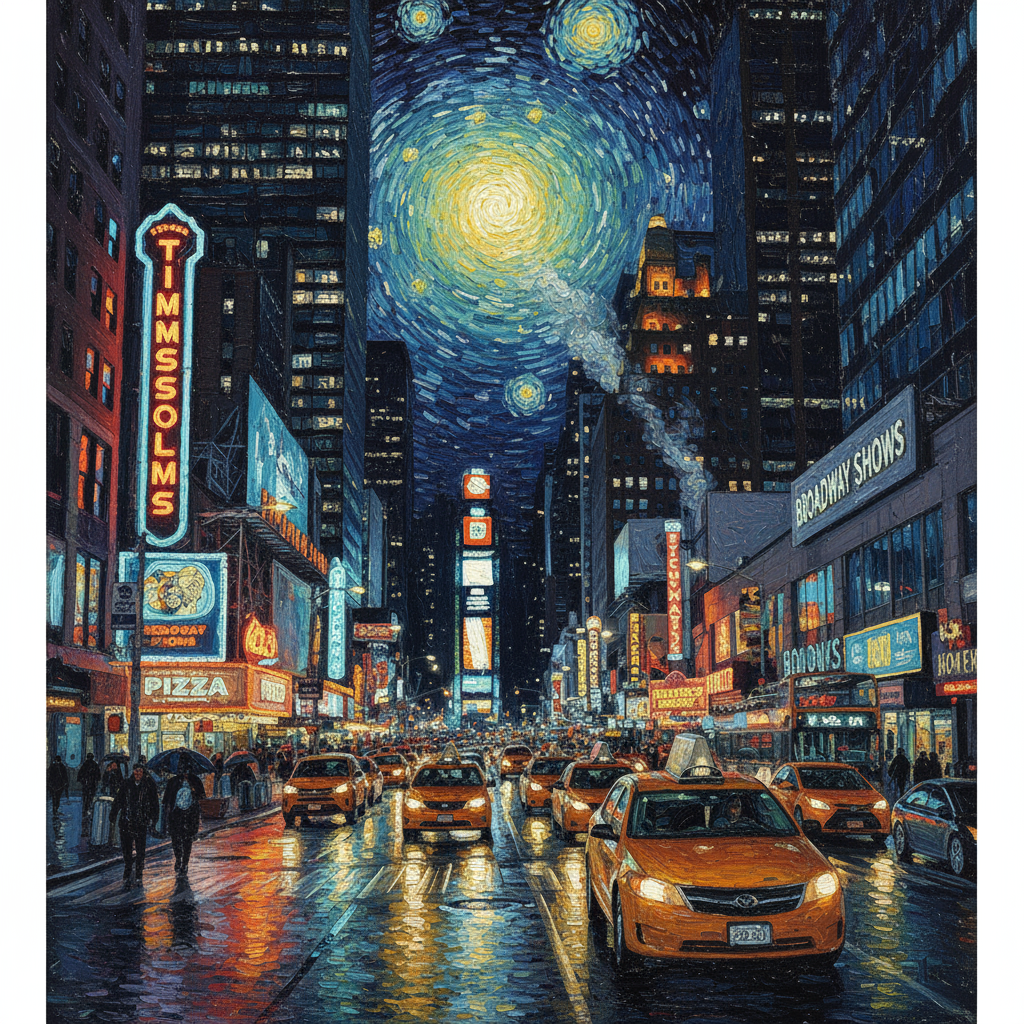

Novidade com os modelos de imagem do Gemini 3

O Gemini 3 oferece modelos de edição e geração de imagens de última geração. O Gemini 3.1 Flash Image é otimizado para velocidade e casos de uso de alto volume, e o Gemini 3 Pro Image é otimizado para produção de recursos profissionais. Criados para lidar com os fluxos de trabalho mais desafiadores usando raciocínio avançado, eles são excelentes em tarefas complexas de criação e modificação com várias etapas.

- Saída de alta resolução: recursos de geração integrados para visuais de 1K, 2K e 4K.

- O Gemini 3.1 Flash Image adiciona a resolução menor de 512 (0,5K).

- Renderização avançada de texto: capaz de gerar texto legível e estilizado para infográficos, menus, diagramas e recursos de marketing.

- Embasamento com a Pesquisa Google: o modelo pode usar a Pesquisa Google como uma ferramenta para verificar fatos e gerar imagens com base em dados em tempo real (por exemplo, mapas de clima atuais, gráficos de ações, eventos recentes).

- O Gemini 3.1 Flash Image adiciona a integração do embasamento com a Pesquisa Google para imagens e a Pesquisa na Web.

- Modo de raciocínio: o modelo usa um processo de "raciocínio" para analisar comandos complexos. Ele gera "imagens de pensamento" provisórias (visíveis no back-end, mas sem cobrança) para refinar a composição antes de produzir a saída final de alta qualidade.

- Até 14 imagens de referência: agora você pode misturar até 14 imagens de referência para produzir a imagem final.

- Novas proporções: o Gemini 3.1 Flash Image adiciona as proporções 1:4, 4:1, 1:8 e 8:1.

Usar até 14 imagens de referência

Com os modelos de imagem do Gemini 3, você pode misturar até 14 imagens de referência. Essas 14 imagens podem incluir o seguinte:

| Imagem do Gemini 3.1 Flash | Gemini 3.1 Pro Image |

|---|---|

| Até 10 imagens de objetos com alta fidelidade para incluir na imagem final | Até seis imagens de objetos com alta fidelidade para incluir na imagem final |

| Até quatro imagens de personagens para manter a consistência | Até cinco imagens de personagens para manter a consistência |

Python

from google import genai

from google.genai import types

from PIL import Image

prompt = "An office group photo of these people, they are making funny faces."

aspect_ratio = "5:4" # "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9"

resolution = "2K" # "512", "1K", "2K", "4K"

client = genai.Client()

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=[

prompt,

Image.open('person1.png'),

Image.open('person2.png'),

Image.open('person3.png'),

Image.open('person4.png'),

Image.open('person5.png'),

],

config=types.GenerateContentConfig(

response_modalities=['TEXT', 'IMAGE'],

response_format={"image": {aspect_ratio: aspect_ratio, image_size: resolution}},

)

)

for part in response.parts:

if part.text is not None:

print(part.text)

elif image:= part.as_image():

image.save("office.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const prompt =

'An office group photo of these people, they are making funny faces.';

const aspectRatio = '5:4';

const resolution = '2K';

const contents = [

{ text: prompt },

{

inlineData: {

mimeType: "image/jpeg",

data: base64ImageFile1,

},

},

{

inlineData: {

mimeType: "image/jpeg",

data: base64ImageFile2,

},

},

{

inlineData: {

mimeType: "image/jpeg",

data: base64ImageFile3,

},

},

{

inlineData: {

mimeType: "image/jpeg",

data: base64ImageFile4,

},

},

{

inlineData: {

mimeType: "image/jpeg",

data: base64ImageFile5,

},

}

];

const response = await ai.models.generateContent({

model: 'gemini-3.1-flash-image',

contents: contents,

config: {

responseModalities: ['TEXT', 'IMAGE'],

responseFormat: {

image: {

aspectRatio: aspectRatio,

imageSize: resolution,

}

},

},

});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("image.png", buffer);

console.log("Image saved as image.png");

}

}

}

main();

Go

package main

import (

"context"

"fmt"

"log"

"os"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

defer client.Close()

model := client.GenerativeModel("gemini-3.1-flash-image")

model.GenerationConfig = &pb.GenerationConfig{

ResponseModalities: []pb.ResponseModality{genai.Text, genai.Image},

ImageConfig: &pb.ImageConfig{

AspectRatio: "5:4",

ImageSize: "2K",

},

}

img1, err := os.ReadFile("person1.png")

if err != nil { log.Fatal(err) }

img2, err := os.ReadFile("person2.png")

if err != nil { log.Fatal(err) }

img3, err := os.ReadFile("person3.png")

if err != nil { log.Fatal(err) }

img4, err := os.ReadFile("person4.png")

if err != nil { log.Fatal(err) }

img5, err := os.ReadFile("person5.png")

if err != nil { log.Fatal(err) }

parts := []genai.Part{

genai.Text("An office group photo of these people, they are making funny faces."),

genai.ImageData{MIMEType: "image/png", Data: img1},

genai.ImageData{MIMEType: "image/png", Data: img2},

genai.ImageData{MIMEType: "image/png", Data: img3},

genai.ImageData{MIMEType: "image/png", Data: img4},

genai.ImageData{MIMEType: "image/png", Data: img5},

}

resp, err := model.GenerateContent(ctx, parts...)

if err != nil {

log.Fatal(err)

}

for _, part := range resp.Candidates[0].Content.Parts {

if txt, ok := part.(genai.Text); ok {

fmt.Printf("%s", string(txt))

} else if img, ok := part.(genai.ImageData); ok {

err := os.WriteFile("office.png", img.Data, 0644)

if err != nil {

log.Fatal(err)

}

}

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.Content;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.ImageConfig;

import com.google.genai.types.Part;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Path;

import java.nio.file.Paths;

public class GroupPhoto {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.imageConfig(ImageConfig.builder()

.aspectRatio("5:4")

.imageSize("2K")

.build())

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image",

Content.fromParts(

Part.fromText("An office group photo of these people, they are making funny faces."),

Part.fromBytes(Files.readAllBytes(Path.of("person1.png")), "image/png"),

Part.fromBytes(Files.readAllBytes(Path.of("person2.png")), "image/png"),

Part.fromBytes(Files.readAllBytes(Path.of("person3.png")), "image/png"),

Part.fromBytes(Files.readAllBytes(Path.of("person4.png")), "image/png"),

Part.fromBytes(Files.readAllBytes(Path.of("person5.png")), "image/png")

), config);

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("office.png"), blob.data().get());

}

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class GroupPhoto {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "An office group photo of these people, they are making funny faces." },

new Part { FileData = new FileData { FileUri = "file:///person1.png" } },

new Part { FileData = new FileData { FileUri = "file:///person2.png" } },

new Part { FileData = new FileData { FileUri = "file:///person3.png" } },

new Part { FileData = new FileData { FileUri = "file:///person4.png" } },

new Part { FileData = new FileData { FileUri = "file:///person5.png" } }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "TEXT", "IMAGE" },

ImageConfig = new ImageConfig

{

AspectRatio = "5:4",

ImageSize = "2K"

}

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("office.png", imageBytes);

Console.WriteLine("Image saved as office.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-d "{

\"contents\": [{

\"parts\":[

{\"text\": \"An office group photo of these people, they are making funny faces.\"},

{\"inline_data\": {\"mime_type\":\"image/png\", \"data\": \"<BASE64_DATA_IMG_1>\"}},

{\"inline_data\": {\"mime_type\":\"image/png\", \"data\": \"<BASE64_DATA_IMG_2>\"}},

{\"inline_data\": {\"mime_type\":\"image/png\", \"data\": \"<BASE64_DATA_IMG_3>\"}},

{\"inline_data\": {\"mime_type\":\"image/png\", \"data\": \"<BASE64_DATA_IMG_4>\"}},

{\"inline_data\": {\"mime_type\":\"image/png\", \"data\": \"<BASE64_DATA_IMG_5>\"}}

]

}],

\"generationConfig\": {

\"responseModalities\": [\"TEXT\", \"IMAGE\"],

\"responseFormat\": {

\"image\": {

\"aspectRatio\": \"5:4\",

\"imageSize\": \"2K\"

}

}

}

}"

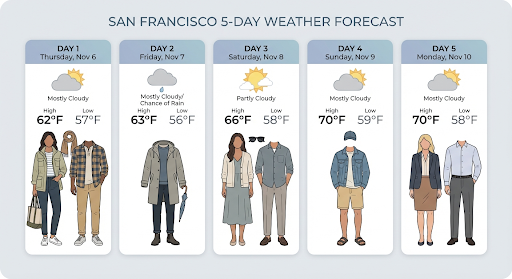

Embasamento com a Pesquisa Google

Use a ferramenta da Pesquisa Google para gerar imagens com base em informações em tempo real, como previsões do tempo, gráficos de ações ou eventos recentes.

Observe que, ao usar o embasamento com a Pesquisa Google para geração de imagens, os resultados da pesquisa baseados em imagens não são transmitidos ao modelo de geração e são excluídos da resposta. Consulte Embasamento com a Pesquisa Google para imagens.

Python

from google import genai

prompt = "Visualize the current weather forecast for the next 5 days in San Francisco as a clean, modern weather chart. Add a visual on what I should wear each day"

aspect_ratio = "16:9" # "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9"

client = genai.Client()

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=prompt,

config=types.GenerateContentConfig(

response_modalities=['Text', 'Image'],

response_format={"image": {aspect_ratio: aspect_ratio,}},

tools=[{"google_search": {}}]

)

)

for part in response.parts:

if part.text is not None:

print(part.text)

elif image:= part.as_image():

image.save("weather.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const prompt = 'Visualize the current weather forecast for the next 5 days in San Francisco as a clean, modern weather chart. Add a visual on what I should wear each day';

const aspectRatio = '16:9';

const resolution = '2K';

const response = await ai.models.generateContent({

model: 'gemini-3.1-flash-image',

contents: prompt,

config: {

responseModalities: ['TEXT', 'IMAGE'],

responseFormat: {

image: {

aspectRatio: aspectRatio,

imageSize: resolution,

}

},

tools: [{ googleSearch: {} }]

},

});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("image.png", buffer);

console.log("Image saved as image.png");

}

}

}

main();

Java

import com.google.genai.Client;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.GoogleSearch;

import com.google.genai.types.ImageConfig;

import com.google.genai.types.Part;

import com.google.genai.types.Tool;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Paths;

public class SearchGrounding {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.imageConfig(ImageConfig.builder()

.aspectRatio("16:9")

.build())

.tools(Tool.builder()

.googleSearch(GoogleSearch.builder().build())

.build())

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image", """

Visualize the current weather forecast for the next 5 days

in San Francisco as a clean, modern weather chart.

Add a visual on what I should wear each day

""",

config);

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("weather.png"), blob.data().get());

}

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class SearchGrounding {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "Visualize the current weather forecast for the next 5 days in San Francisco as a clean, modern weather chart. Add a visual on what I should wear each day" }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "TEXT", "IMAGE" },

ImageConfig = new ImageConfig

{

AspectRatio = "16:9"

},

Tools = new List<Tool> { new Tool { GoogleSearch = new GoogleSearch() } }

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("weather.png", imageBytes);

Console.WriteLine("Image saved as weather.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{"parts": [{"text": "Visualize the current weather forecast for the next 5 days in San Francisco as a clean, modern weather chart. Add a visual on what I should wear each day"}]}],

"tools": [{"google_search": {}}],

"generationConfig": {

"responseModalities": ["TEXT", "IMAGE"],

"responseFormat": {

"image": {"aspectRatio": "16:9"}

}

}

}'

A resposta inclui groundingMetadata, que contém os seguintes campos obrigatórios:

searchEntryPoint: contém o HTML e o CSS para renderizar as sugestões de pesquisa necessárias.groundingChunks: retorna as três principais fontes da Web usadas para embasar a imagem gerada.

Embasamento com a Pesquisa Google Imagens (3.1 Flash)

O embasamento com a Pesquisa Google para imagens permite que os modelos usem imagens da Web recuperadas pela Pesquisa Google como contexto visual para a geração de imagens. A Pesquisa de imagens é um novo tipo de pesquisa na ferramenta de embasamento com a Pesquisa Google, que funciona junto com a Pesquisa na Web padrão.

Para ativar a Pesquisa de imagens, configure a ferramenta googleSearch na solicitação de API

e especifique imageSearch no objeto searchTypes. A pesquisa por imagens pode ser usada de forma independente ou com a pesquisa na Web.

Observação: o embasamento com a Pesquisa Google para imagens não pode ser usado para pesquisar pessoas.

Python

from google import genai

prompt = "A detailed painting of a Timareta butterfly resting on a flower"

client = genai.Client()

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=prompt,

config=types.GenerateContentConfig(

response_modalities=["IMAGE"],

tools=[

types.Tool(google_search=types.GoogleSearch(

search_types=types.SearchTypes(

web_search=types.WebSearch(),

image_search=types.ImageSearch()

)

))

]

)

)

# Display grounding sources if available

if response.candidates and response.candidates[0].grounding_metadata and response.candidates[0].grounding_metadata.search_entry_point:

display(HTML(response.candidates[0].grounding_metadata.search_entry_point.rendered_content))

JavaScript

import { GoogleGenAI } from "@google/genai";

async function main() {

const ai = new GoogleGenAI({});

const prompt = "A detailed painting of a Timareta butterfly resting on a flower";

const response = await ai.models.generateContent({

model: "gemini-3.1-flash-image",

contents: prompt,

config: {

responseModalities: ["IMAGE"],

tools: [

{

googleSearch: {

searchTypes: {

webSearch: {},

imageSearch: {}

}

}

}

]

}

});

// Display grounding sources if available

if (response.candidates && response.candidates[0].groundingMetadata && response.candidates[0].groundingMetadata.searchEntryPoint) {

console.log(response.candidates[0].groundingMetadata.searchEntryPoint.renderedContent);

}

}

main();

Go

package main

import (

"context"

"fmt"

"log"

"google.golang.org/genai"

pb "google.golang.org/genai/schema"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

defer client.Close()

model := client.GenerativeModel("gemini-3.1-flash-image")

model.Tools = []*pb.Tool{

{

GoogleSearch: &pb.GoogleSearch{

SearchTypes: &pb.SearchTypes{

WebSearch: &pb.WebSearch{},

ImageSearch: &pb.ImageSearch{},

},

},

},

}

model.GenerationConfig = &pb.GenerationConfig{

ResponseModalities: []pb.ResponseModality{genai.Image},

}

prompt := "A detailed painting of a Timareta butterfly resting on a flower"

resp, err := model.GenerateContent(ctx, genai.Text(prompt))

if err != nil {

log.Fatal(err)

}

if resp.Candidates[0].GroundingMetadata != nil && resp.Candidates[0].GroundingMetadata.SearchEntryPoint != nil {

fmt.Println(resp.Candidates[0].GroundingMetadata.SearchEntryPoint.RenderedContent)

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.GoogleSearch;

import com.google.genai.types.ImageSearch;

import com.google.genai.types.SearchTypes;

import com.google.genai.types.Tool;

import com.google.genai.types.WebSearch;

import java.io.IOException;

public class ImageSearchGrounding {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("IMAGE")

.tools(Tool.builder()

.googleSearch(GoogleSearch.builder()

.searchTypes(SearchTypes.builder()

.webSearch(WebSearch.builder().build())

.imageSearch(ImageSearch.builder().build())

.build())

.build())

.build())

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image",

"A detailed painting of a Timareta butterfly resting on a flower",

config);

if (response.candidates().isPresent() && !response.candidates().get().isEmpty()) {

var candidate = response.candidates().get().get(0);

if (candidate.groundingMetadata().isPresent() && candidate.groundingMetadata().get().searchEntryPoint().isPresent()) {

System.out.println(candidate.groundingMetadata().get().searchEntryPoint().get().renderedContent().orElse(""));

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.Threading.Tasks;

public class ImageSearchGrounding {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "A detailed painting of a Timareta butterfly resting on a flower" }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "IMAGE" },

Tools = new List<Tool>

{

new Tool

{

GoogleSearch = new GoogleSearch

{

SearchTypes = new SearchTypes

{

WebSearch = new WebSearch(),

ImageSearch = new ImageSearch()

}

}

}

}

}

);

foreach (var candidate in response.Candidates) {

if (candidate.GroundingMetadata != null && candidate.GroundingMetadata.SearchEntryPoint != null) {

Console.WriteLine(candidate.GroundingMetadata.SearchEntryPoint.RenderedContent);

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{"parts": [{"text": "A detailed painting of a Timareta butterfly resting on a flower"}]}],

"tools": [{"google_search": {"searchTypes": {"webSearch": {}, "imageSearch": {}}}}],

"generationConfig": {

"responseModalities": ["IMAGE"]

}

}'

Requisitos de exibição

Ao usar a Pesquisa de imagens no Embasamento com a Pesquisa Google, você precisa obedecer às seguintes condições:

- Atribuição da fonte: você precisa fornecer um link para a página da Web que contém a imagem de origem (a "página que contém", não o arquivo de imagem em si) de uma maneira que o usuário reconheça como um link.

- Navegação direta: se você também optar por mostrar as imagens de origem, será necessário fornecer um caminho direto de um único clique das imagens de origem para a página da Web de origem que as contém. Qualquer outra implementação que atrase ou abstraia o acesso do usuário final à página da Web de origem, incluindo, entre outros, qualquer caminho de vários cliques ou o uso de um visualizador de imagens intermediário, não é permitida.

Resposta

Para respostas embasadas usando a pesquisa por imagens, a API fornece atribuição e metadados claros para vincular a saída a fontes verificadas. Os principais campos do objeto groundingMetadata incluem:

imageSearchQueries: as consultas específicas usadas pelo modelo para contexto visual (Pesquisa por imagens).groundingChunks: contém informações de origem para os resultados recuperados. Para fontes de imagens, eles serão retornados como URLs de redirecionamento usando um novo tipo de fragmento de imagem. Esse trecho inclui:uri: o URL da página da Web para atribuição (a página de destino).image_uri: o URL direto da imagem.

groundingSupports: fornece mapeamentos específicos que vinculam o conteúdo gerado à fonte de citação relevante nos trechos.searchEntryPoint: inclui o ícone "Pesquisa Google" com HTML e CSS compatíveis para renderizar as sugestões de pesquisa.

Geração de vídeo para imagem (3.1 Flash)

A geração de vídeo para imagem permite criar novas imagens usando o contexto de um vídeo como referência multimodal. Isso é útil para criar miniaturas de vídeo de alta qualidade, pôsteres cinematográficos, infográficos de resumo ou novas artes inspiradas em uma cena de vídeo.

Durante a geração, o modelo analisa os frames do vídeo no contexto (até o limite de tokens de entrada do modelo,que é de 131.072 tokens) para extrair temas visuais e eventos principais. Em seguida, ele usa essas informações com seu comando de texto para sintetizar a imagem de saída.

Você pode transmitir URLs públicos do YouTube diretamente na solicitação de API ou fazer upload de arquivos de vídeo locais usando a API Files.

Python

from google import genai

from google.genai import types

client = genai.Client()

# Pass a public YouTube video URL as part of the contents

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=[

types.Part(

file_data=types.FileData(file_uri="https://www.youtube.com/watch?v=UTdfxFyOQTI"),

video_metadata=types.VideoMetadata(fps=0.5)

),

"Can you create an infographics that explains what this video is about?"

]

)

# Save the generated image part

for part in response.parts:

if part.inline_data is not None:

image = part.as_image()

image.save("video_poster.png")

print("Image saved as video_poster.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const response = await ai.models.generateContent({

model: "gemini-3.1-flash-image",

contents: [

{

fileData: {

fileUri: "https://www.youtube.com/watch?v=UTdfxFyOQTI",

},

videoMetadata: {

fps: 0.5

}

},

{ text: "Can you create an infographics that explains what this video is about?" }

]

});

for (const part of response.candidates[0].content.parts) {

if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("video_poster.png", buffer);

console.log("Image saved as video_poster.png");

}

}

}

main();

Go

package main

import (

"context"

"log"

"os"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

videoPart := genai.NewPartFromURI("https://www.youtube.com/watch?v=UTdfxFyOQTI", "video/mp4")

videoPart.VideoMetadata = &genai.VideoMetadata{FPS: genai.Ptr(0.5)}

parts := []*genai.Part{

videoPart,

genai.NewPartFromText("Can you create an infographics that explains what this video is about?"),

}

contents := []*genai.Content{

genai.NewContentFromParts(parts, genai.RoleUser),

}

result, err := client.Models.GenerateContent(

ctx,

"gemini-3.1-flash-image",

contents,

nil,

)

if err != nil {

log.Fatal(err)

}

for _, part := range result.Candidates[0].Content.Parts {

if part.InlineData != nil {

imageBytes := part.InlineData.Data

_ = os.WriteFile("video_poster.png", imageBytes, 0644)

log.Println("Image saved as video_poster.png")

}

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.Content;

import com.google.genai.types.FileData;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.Part;

import com.google.genai.types.VideoMetadata;

import com.google.common.collect.ImmutableList;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Paths;

public class VideoToImage {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

Part videoPart = Part.builder()

.fileData(FileData.builder()

.fileUri("https://www.youtube.com/watch?v=UTdfxFyOQTI")

.build())

.videoMetadata(VideoMetadata.builder()

.fps(0.5)

.build())

.build();

Part textPart = Part.builder()

.text("Can you create an infographics that explains what this video is about?")

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image",

Content.builder()

.role("user")

.parts(ImmutableList.of(videoPart, textPart))

.build());

for (Part part : response.parts()) {

if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("video_poster.png"), blob.data().get());

System.out.println("Image saved as video_poster.png");

}

}

}

}

}

}

C#

using Google.GenAI;

using Google.GenAI.Types;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class VideoToImage {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part

{

FileData = new FileData { FileUri = "https://www.youtube.com/watch?v=UTdfxFyOQTI" },

VideoMetadata = new VideoMetadata { Fps = 0.5 }

},

new Part { Text = "Can you create an infographics that explains what this video is about?" }

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("video_poster.png", imageBytes);

Console.WriteLine("Image saved as video_poster.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{

"parts": [

{

"file_data": {

"file_uri": "https://www.youtube.com/watch?v=UTdfxFyOQTI"

},

"video_metadata": {

"fps": 0.5

}

},

{"text": "Can you create an infographics that explains what this video is about?"}

]

}]

}'

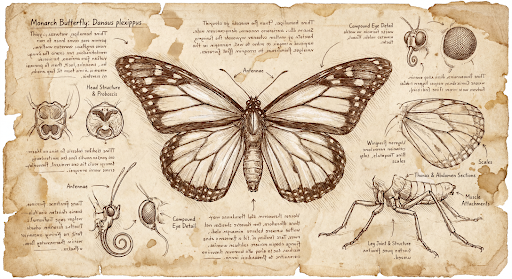

Gerar imagens com resolução de até 4K

Os modelos de imagem do Gemini 3 geram 1.000 imagens por padrão, mas também podem gerar imagens de 2K, 4K e 512 (0,5K) (somente o Gemini 3.1 Flash Image). Para gerar recursos de resolução mais alta, especifique o image_size no generation_config.

Use um "K" maiúsculo (por exemplo, 1K, 2K, 4K). O valor 512 não usa um sufixo "K". Parâmetros em letras minúsculas (por exemplo, 1k) serão rejeitados.

Python

from google import genai

from google.genai import types

prompt = "Da Vinci style anatomical sketch of a dissected Monarch butterfly. Detailed drawings of the head, wings, and legs on textured parchment with notes in English."

aspect_ratio = "1:1" # "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9"

resolution = "1K" # "512", "1K", "2K", "4K"

client = genai.Client()

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents=prompt,

config=types.GenerateContentConfig(

response_modalities=['TEXT', 'IMAGE'],

response_format={"image": {aspect_ratio: aspect_ratio, image_size: resolution}},

)

)

for part in response.parts:

if part.text is not None:

print(part.text)

elif image:= part.as_image():

image.save("butterfly.png")

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const prompt =

'Da Vinci style anatomical sketch of a dissected Monarch butterfly. Detailed drawings of the head, wings, and legs on textured parchment with notes in English.';

const aspectRatio = '1:1';

const resolution = '1K';

const response = await ai.models.generateContent({

model: 'gemini-3.1-flash-image',

contents: prompt,

config: {

responseModalities: ['TEXT', 'IMAGE'],

responseFormat: {

image: {

aspectRatio: aspectRatio,

imageSize: resolution,

}

},

},

});

for (const part of response.candidates[0].content.parts) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("image.png", buffer);

console.log("Image saved as image.png");

}

}

}

main();

Go

package main

import (

"context"

"fmt"

"log"

"os"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

defer client.Close()

model := client.GenerativeModel("gemini-3.1-flash-image")

model.GenerationConfig = &pb.GenerationConfig{

ResponseModalities: []pb.ResponseModality{genai.Text, genai.Image},

ImageConfig: &pb.ImageConfig{

AspectRatio: "1:1",

ImageSize: "1K",

},

}

prompt := "Da Vinci style anatomical sketch of a dissected Monarch butterfly. Detailed drawings of the head, wings, and legs on textured parchment with notes in English."

resp, err := model.GenerateContent(ctx, genai.Text(prompt))

if err != nil {

log.Fatal(err)

}

for _, part := range resp.Candidates[0].Content.Parts {

if txt, ok := part.(genai.Text); ok {

fmt.Printf("%s", string(txt))

} else if img, ok := part.(genai.ImageData); ok {

err := os.WriteFile("butterfly.png", img.Data, 0644)

if err != nil {

log.Fatal(err)

}

}

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.GoogleSearch;

import com.google.genai.types.ImageConfig;

import com.google.genai.types.Part;

import com.google.genai.types.Tool;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Paths;

public class HiRes {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("TEXT", "IMAGE")

.imageConfig(ImageConfig.builder()

.aspectRatio("16:9")

.imageSize("4K")

.build())

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image", """

Da Vinci style anatomical sketch of a dissected Monarch butterfly.

Detailed drawings of the head, wings, and legs on textured

parchment with notes in English.

""",

config);

for (Part part : response.parts()) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("butterfly.png"), blob.data().get());

}

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class HiRes {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "Da Vinci style anatomical sketch of a dissected Monarch butterfly. Detailed drawings of the head, wings, and legs on textured parchment with notes in English." }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "TEXT", "IMAGE" },

ImageConfig = new ImageConfig

{

AspectRatio = "1:1",

ImageSize = "1K"

}

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("butterfly.png", imageBytes);

Console.WriteLine("Image saved as butterfly.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{"parts": [{"text": "Da Vinci style anatomical sketch of a dissected Monarch butterfly. Detailed drawings of the head, wings, and legs on textured parchment with notes in English."}]}],

"tools": [{"google_search": {}}],

"generationConfig": {

"responseModalities": ["TEXT", "IMAGE"],

"responseFormat": {

"image": {"aspectRatio": "1:1", "imageSize": "1K"}

}

}

}'

Confira um exemplo de imagem gerada com esse comando:

Processo de raciocínio

Os modelos de imagem do Gemini 3 são modelos de raciocínio que usam um processo de inferência ("Raciocínio") para comandos complexos. Esse recurso é ativado por padrão e não pode ser desativado na API. Para saber mais sobre o processo de pensamento, consulte o guia Pensamento do Gemini.

O modelo gera até duas imagens provisórias para testar a composição e a lógica. A última imagem em "Pensando" também é a imagem renderizada final.

Você pode conferir as ideias que levaram à produção da imagem final.

Python

for part in response.parts:

if part.thought:

if part.text:

print(part.text)

elif image:= part.as_image():

image.show()

JavaScript

for (const part of response.candidates[0].content.parts) {

if (part.thought) {

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, 'base64');

fs.writeFileSync('image.png', buffer);

console.log('Image saved as image.png');

}

}

}

Java

for (Part part : response.parts()) {

if (part.thought().orElse(false)) {

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("image.png"), blob.data().get());

System.out.println("Image saved as image.png");

}

}

}

}

C#

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Thought) {

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("image.png", imageBytes);

Console.WriteLine("Image saved as image.png");

}

}

}

}

Como controlar os níveis de pensamento

Com o Gemini 3.1 Flash Image, você controla a quantidade de raciocínio que o modelo usa para equilibrar qualidade e latência. O thinkingLevel padrão é minimal, e os níveis compatíveis são minimal e high. Definir o thinkingLevel como minimal oferece respostas com a menor latência. Observe que o raciocínio mínimo não significa que o modelo não usa nenhum raciocínio.

Você pode adicionar o booleano includeThoughts para determinar se os pensamentos gerados pelo modelo são retornados na resposta ou permanecem ocultos.

Python

from google import genai

response = client.models.generate_content(

model="gemini-3.1-flash-image",

contents="A futuristic city built inside a giant glass bottle floating in space",

config=types.GenerateContentConfig(

response_modalities=["IMAGE"],

thinking_config=types.ThinkingConfig(

thinking_level="High",

include_thoughts=True

),

)

)

for part in response.parts:

if part.thought: # Skip outputting thoughts

continue

if part.text:

display(Markdown(part.text))

elif image:= part.as_image():

image.show()

JavaScript

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

async function main() {

const ai = new GoogleGenAI({});

const response = await ai.models.generateContent({

model: "gemini-3.1-flash-image",

contents: "A futuristic city built inside a giant glass bottle floating in space",

config: {

responseModalities: ["IMAGE"],

thinkingConfig: {

thinkingLevel: "High",

includeThoughts: true

},

},

});

for (const part of response.candidates[0].content.parts) {

if (part.thought) { // Skip outputting thoughts

continue;

}

if (part.text) {

console.log(part.text);

} else if (part.inlineData) {

const imageData = part.inlineData.data;

const buffer = Buffer.from(imageData, "base64");

fs.writeFileSync("image.png", buffer);

console.log("Image saved as image.png");

}

}

}

main();

Go

package main

import (

"context"

"fmt"

"log"

"os"

"google.golang.org/genai"

pb "google.golang.org/genai/schema"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

defer client.Close()

model := client.GenerativeModel("gemini-3.1-flash-image")

model.GenerationConfig = &pb.GenerationConfig{

ResponseModalities: []pb.ResponseModality{genai.Image},

ThinkingConfig: &pb.ThinkingConfig{

ThinkingLevel: "High",

IncludeThoughts: true,

},

}

prompt := "A futuristic city built inside a giant glass bottle floating in space"

resp, err := model.GenerateContent(ctx, genai.Text(prompt))

if err != nil {

log.Fatal(err)

}

for _, part := range resp.Candidates[0].Content.Parts {

if part.Thought { // Skip outputting thoughts

continue

}

if txt, ok := part.(genai.Text); ok {

fmt.Printf("%s", string(txt))

} else if img, ok := part.(genai.ImageData); ok {

err := os.WriteFile("image.png", img.Data, 0644)

if err != nil {

log.Fatal(err)

}

}

}

}

Java

import com.google.genai.Client;

import com.google.genai.types.GenerateContentConfig;

import com.google.genai.types.GenerateContentResponse;

import com.google.genai.types.Part;

import com.google.genai.types.ThinkingConfig;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Paths;

public class ThinkingLevels {

public static void main(String[] args) throws IOException {

try (Client client = new Client()) {

GenerateContentConfig config = GenerateContentConfig.builder()

.responseModalities("IMAGE")

.thinkingConfig(ThinkingConfig.builder()

.thinkingLevel("High")

.includeThoughts(true)

.build())

.build();

GenerateContentResponse response = client.models.generateContent(

"gemini-3.1-flash-image",

"A futuristic city built inside a giant glass bottle floating in space",

config);

for (Part part : response.parts()) {

if (part.thought().orElse(false)) {

// Skip outputting thoughts

continue;

}

if (part.text().isPresent()) {

System.out.println(part.text().get());

} else if (part.inlineData().isPresent()) {

var blob = part.inlineData().get();

if (blob.data().isPresent()) {

Files.write(Paths.get("image.png"), blob.data().get());

System.out.println("Image saved as image.png");

}

}

}

}

}

}

C#

using Google.GenAI;

using System;

using System.Collections.Generic;

using System.IO;

using System.Threading.Tasks;

public class ThinkingLevels {

public static async Task Main(string[] args) {

var client = new Client();

var response = await client.Models.GenerateContentAsync(

model: "gemini-3.1-flash-image",

contents: new List<Part>

{

new Part { Text = "A futuristic city built inside a giant glass bottle floating in space" }

},

config: new GenerateContentConfig

{

ResponseModalities = new List<string> { "IMAGE" },

ThinkingConfig = new ThinkingConfig

{

ThinkingLevel = "High",

IncludeThoughts = true

}

}

);

foreach (var candidate in response.Candidates) {

foreach (var part in candidate.Content.Parts) {

if (part.Thought) {

// Skip outputting thoughts

continue;

}

if (part.Text != null) {

Console.WriteLine(part.Text);

} else if (part.InlineData != null) {

var imageBytes = Convert.FromBase64String(part.InlineData.Data);

await File.WriteAllBytesAsync("image.png", imageBytes);

Console.WriteLine("Image saved as image.png");

}

}

}

}

}

REST

curl -s -X POST \

"https://generativelanguage.googleapis.com/v1/models/gemini-3.1-flash-image:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"contents": [{"parts": [{"text": "A futuristic city built inside a giant glass bottle floating in space"}]}],

"generationConfig": {

"responseModalities": ["IMAGE"],

"thinkingConfig": {

"thinkingLevel": "High",

"includeThoughts": true

}

}

}'

Os tokens de raciocínio são faturados, independente de includeThoughts estar definido como true ou false, já que o processo de raciocínio sempre acontece por padrão, mesmo que você não o veja.

Assinaturas de pensamento