Live API memungkinkan interaksi suara dan visi real-time dengan latensi rendah bersama Gemini. Fitur ini memproses aliran audio, gambar, dan teks yang berkelanjutan untuk menghasilkan respons lisan yang langsung dan mirip manusia, sehingga menciptakan pengalaman percakapan yang alami bagi pengguna Anda.

Kasus penggunaan

Live API dapat digunakan untuk membangun agen suara real-time untuk berbagai industri, termasuk:

- E-commerce dan retail: Asisten belanja yang menawarkan rekomendasi yang dipersonalisasi dan agen dukungan yang menyelesaikan masalah pelanggan.

- Game: Karakter non-pemain (NPC) interaktif, asisten bantuan dalam game, dan terjemahan real-time konten dalam game.

- Antarmuka generasi berikutnya: Pengalaman yang mendukung suara dan video dalam robotika, kacamata pintar, dan kendaraan.

- Layanan kesehatan: Pendamping kesehatan untuk dukungan dan edukasi pasien.

- Layanan keuangan: Penasihat AI untuk manajemen kekayaan dan panduan investasi.

- Pendidikan: Mentor AI dan pendamping pelajar yang memberikan instruksi dan masukan yang dipersonalisasi.

- Terjemahan dan pelokalan: Terjemahan real-time dan latensi rendah untuk percakapan lisan, sehingga memungkinkan komunikasi multibahasa yang lancar.

Fitur utama

Live API menawarkan serangkaian fitur komprehensif untuk membangun agen suara yang andal:

- Dukungan multibahasa: Berkomunikasi dalam 70 bahasa yang didukung.

- Barge-in: Pengguna dapat mengganggu model kapan saja untuk interaksi responsif.

- Penggunaan alat: Mengintegrasikan alat seperti panggilan fungsi dan Google Penelusuran untuk interaksi dinamis.

- Transkripsi audio: Menyediakan transkrip teks untuk input pengguna dan output model.

- Audio proaktif: Memungkinkan Anda mengontrol kapan model merespons dan dalam konteks apa.

- Dialog afektif: Menyesuaikan gaya dan nada respons agar sesuai dengan ekspresi input pengguna.

- Terjemahan Langsung: Terjemahan suara-ke-suara real-time dalam lebih dari 70 bahasa.

Spesifikasi teknis

Tabel berikut menguraikan spesifikasi teknis untuk Live API:

| Kategori | Detail |

|---|---|

| Modalitas input | Audio (audio PCM 16-bit mentah, 16 kHz, little-endian), gambar (JPEG <= 1 FPS), teks |

| Modalitas output | Audio (audio PCM 16-bit mentah, 24 kHz, little-endian) |

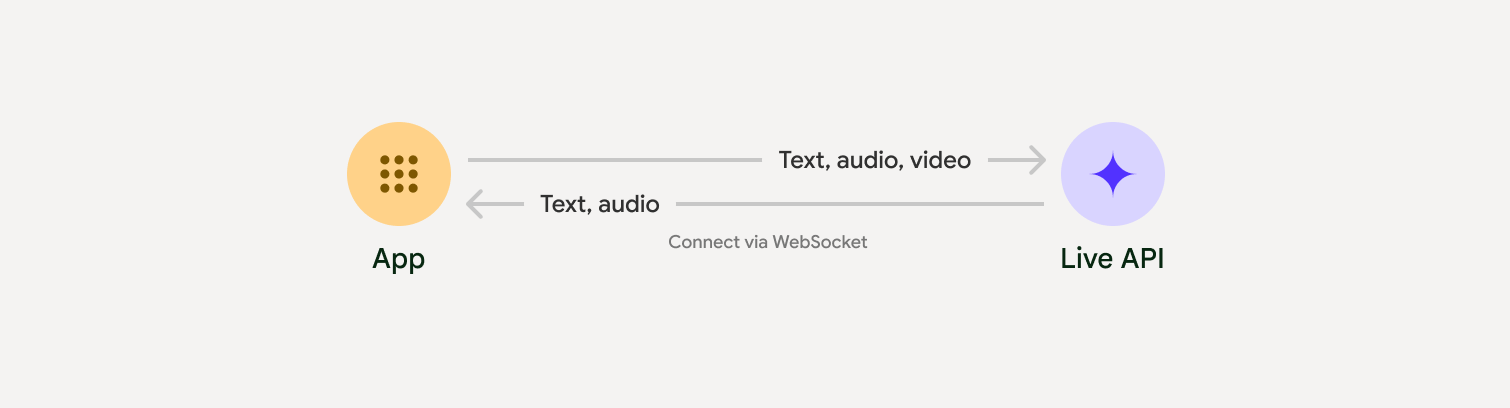

| Protokol | Koneksi WebSocket stateful (WSS) |

Memilih pendekatan implementasi

Saat berintegrasi dengan Live API, Anda harus memilih salah satu pendekatan implementasi berikut:

- Server-ke-server: Backend Anda terhubung ke Live API menggunakan WebSockets. Biasanya, klien Anda mengirim data streaming (audio, video, teks) ke server Anda, yang kemudian meneruskannya ke Live API.

- Klien-ke-server: Kode frontend Anda terhubung langsung ke Live API menggunakan WebSockets untuk men-streaming data, sehingga melewati backend Anda.

Mulai

Pilih panduan yang sesuai dengan lingkungan pengembangan Anda:

Tutorial GenAI SDK

Hubungkan ke Gemini Live API menggunakan GenAI SDK untuk membangun aplikasi multimodal real-time dengan backend Python.

Tutorial WebSocket

Hubungkan ke Gemini Live API menggunakan WebSockets untuk membangun aplikasi multimodal real-time dengan frontend JavaScript dan token sementara.

Tutorial ADK

Buat agen dan gunakan Streaming Agent Development Kit (ADK) untuk mengaktifkan komunikasi suara dan video.

Integrasi partner

Untuk menyederhanakan pengembangan aplikasi audio dan video real-time, Anda dapat menggunakan integrasi pihak ketiga yang mendukung Gemini Live API melalui WebRTC atau WebSockets.

LiveKit

Gunakan Gemini Live API dengan Agen LiveKit.

Pipecat dari Daily

Buat chatbot AI real-time menggunakan Gemini Live dan Pipecat.

Fishjam dari Software Mansion

Buat aplikasi streaming video dan audio live dengan Fishjam.

Agen Vision dari Stream

Buat aplikasi AI suara dan video real-time dengan Agen Vision.

Voximplant

Hubungkan panggilan masuk dan keluar ke Live API dengan Voximplant.

Agora

Buat aplikasi AI percakapan real-time dengan Agora.

Firebase AI SDK

Mulai menggunakan Gemini Live API dengan Firebase AI Logic.