Live API ช่วยให้โต้ตอบด้วยเสียงและภาพกับ Gemini ได้แบบเรียลไทม์ที่มีเวลาในการตอบสนองต่ำ โดยจะประมวลผลสตรีมเสียง รูปภาพ และข้อความอย่างต่อเนื่องเพื่อส่งมอบคำตอบที่พูดได้ทันทีและเหมือนมนุษย์ ซึ่งจะสร้างประสบการณ์การสนทนาที่เป็นธรรมชาติสำหรับผู้ใช้

กรณีการใช้งาน

คุณใช้ Live API เพื่อสร้างเอเจนต์เสียงแบบเรียลไทม์สำหรับอุตสาหกรรมต่างๆ ได้ ซึ่งรวมถึงอุตสาหกรรมต่อไปนี้

- อีคอมเมิร์ซและการค้าปลีก: ผู้ช่วยช็อปปิ้งที่ให้คำแนะนำที่ปรับเปลี่ยนในแบบของคุณ และตัวแทนฝ่ายสนับสนุนที่แก้ไขปัญหาของลูกค้า

- เกม: ตัวละครที่ไม่ใช่ผู้เล่น (NPC) แบบอินเทอร์แอกทีฟ ผู้ช่วยในเกม และผู้ช่วยแปลเนื้อหาในเกมแบบเรียลไทม์

- อินเทอร์เฟซรุ่นถัดไป: ประสบการณ์ที่เปิดใช้เสียงและวิดีโอในหุ่นยนต์ แว่นตาอัจฉริยะ และยานพาหนะ

- การดูแลสุขอนามัย: เพื่อนร่วมทางด้านสุขภาพสำหรับการสนับสนุนและการให้ความรู้แก่ผู้ป่วย

- บริการทางการเงิน: ที่ปรึกษา AI สำหรับการจัดการความมั่งคั่งและคำแนะนำด้านการลงทุน

- การศึกษา: ที่ปรึกษาและเพื่อนร่วมเรียนรู้ AI ที่ให้คำแนะนำและความคิดเห็นที่ปรับเปลี่ยนในแบบของคุณ

ฟีเจอร์หลัก

Live API มีชุดฟีเจอร์ที่ครอบคลุมสำหรับการสร้าง เอเจนต์เสียงที่แข็งแกร่ง ดังนี้

- การสนับสนุนหลายภาษา: สนทนาในภาษาที่รองรับ 70 ภาษา

- การแทรกพูด ผู้ใช้สามารถขัดจังหวะโมเดลได้ทุกเมื่อเพื่อการโต้ตอบที่ตอบสนอง

- การใช้เครื่องมือ: ผสานรวมเครื่องมือต่างๆ เช่น การเรียกใช้ฟังก์ชันและ Google Search เพื่อการโต้ตอบแบบไดนามิก

- การถอดเสียงเป็นคำ: แสดงข้อความถอดเสียงทั้งข้อมูลจากผู้ใช้และเอาต์พุตโมเดล

- เสียงเชิงรุก: ช่วยให้คุณควบคุมได้ว่าโมเดลจะตอบเมื่อใดและในบริบทใด

- การโต้ตอบที่สะท้อนถึงความรู้สึก ปรับรูปแบบและระดับภาษาของคำตอบให้ตรงกับการแสดงออกของผู้ใช้

ข้อกำหนดทางเทคนิค

ตารางต่อไปนี้แสดงข้อกำหนดทางเทคนิคสำหรับ Live API

| หมวดหมู่ | รายละเอียด |

|---|---|

| รูปแบบอินพุต | เสียง (เสียง PCM แบบ 16 บิตดิบ, 16kHz, little-endian), รูปภาพ (JPEG <= 1FPS), ข้อความ |

| รูปแบบเอาต์พุต | เสียง (เสียง PCM 16 บิตแบบดิบ, 24kHz, Little-Endian) |

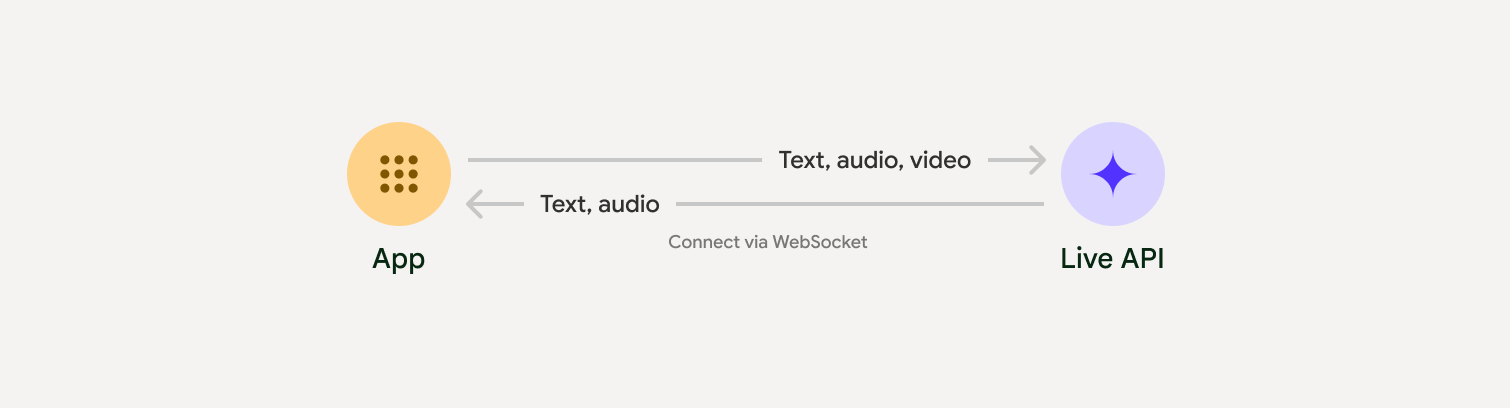

| โปรโตคอล | การเชื่อมต่อ WebSocket แบบมีสถานะ (WSS) |

เลือกวิธีการติดตั้งใช้งาน

เมื่อผสานรวมกับ Live API คุณจะต้องเลือกแนวทางการติดตั้งใช้งานอย่างใดอย่างหนึ่งต่อไปนี้

- เซิร์ฟเวอร์ต่อเซิร์ฟเวอร์: แบ็กเอนด์จะเชื่อมต่อกับ Live API โดยใช้ WebSockets โดยปกติแล้ว ไคลเอ็นต์จะส่งข้อมูลสตรีม (เสียง วิดีโอ ข้อความ) ไปยังเซิร์ฟเวอร์ของคุณ ซึ่งจะส่งต่อข้อมูลไปยัง Live API

- ไคลเอ็นต์ถึงเซิร์ฟเวอร์: โค้ดส่วนหน้าจะเชื่อมต่อกับ Live API โดยตรง โดยใช้ WebSockets เพื่อสตรีมข้อมูลโดยข้ามแบ็กเอนด์

เริ่มต้นใช้งาน

เลือกคู่มือที่ตรงกับสภาพแวดล้อมในการพัฒนาซอฟต์แวร์ของคุณ

บทแนะนำเกี่ยวกับ GenAI SDK

เชื่อมต่อกับ Gemini Live API โดยใช้ GenAI SDK เพื่อสร้างแอปพลิเคชันมัลติโมดัลแบบเรียลไทม์ด้วยแบ็กเอนด์ Python

บทแนะนำ WebSocket

เชื่อมต่อกับ Gemini Live API โดยใช้ WebSockets เพื่อสร้างแอปพลิเคชันแบบเรียลไทม์หลายรูปแบบด้วยฟรอนท์เอนด์ JavaScript และโทเค็นชั่วคราว

บทแนะนำ ADK

สร้างเอเจนต์และใช้ Agent Development Kit (ADK) Streaming เพื่อเปิดใช้การสื่อสารด้วยเสียงและวิดีโอ

การผสานรวมพาร์ทเนอร์

หากต้องการเพิ่มประสิทธิภาพการพัฒนาแอปเสียงและวิดีโอแบบเรียลไทม์ คุณสามารถใช้ การผสานรวมของบุคคลที่สามที่รองรับ Gemini Live API ผ่าน WebRTC หรือ WebSockets

LiveKit

ใช้ Gemini Live API กับ LiveKit Agent

Pipecat โดย Daily

สร้างแชทบอท AI แบบเรียลไทม์โดยใช้ Gemini Live และ Pipecat

Fishjam โดย Software Mansion

สร้างแอปพลิเคชันสตรีมมิงวิดีโอสดและเสียงด้วย Fishjam

Vision Agent ตามสตรีม

สร้างแอปพลิเคชัน AI สำหรับเสียงและวิดีโอแบบเรียลไทม์ด้วย Vision Agent

Voximplant

เชื่อมต่อการโทรขาเข้าและขาออกกับ Live API ด้วย Voximplant

Agora

สร้างแอปพลิเคชัน AI แบบสนทนาแบบเรียลไทม์ด้วย Agora

Firebase AI SDK

เริ่มต้นใช้งาน Gemini Live API โดยใช้ Firebase AI Logic