Live API 支持与 Gemini 进行低延迟、实时的语音和视觉交互。它能够处理连续的音频、图片和文本流,以提供即时、自然逼真的语音回答,从而为用户创造自然的对话体验。

使用场景

Live API 可用于为各种行业构建实时语音代理,包括:

- 电子商务和零售:提供个性化推荐的购物助理,以及解决客户问题的支持人员。

- 游戏:互动式非玩家角色 (NPC)、游戏内帮助助理和游戏内内容的实时翻译。

- 新一代界面:在机器人、智能眼镜和车辆中提供语音和视频功能。

- 医疗保健:用于患者支持和教育的健康助手。

- 金融服务:用于财富管理和投资指导的 AI 顾问。

- 教育:提供个性化指导和反馈的 AI 导师和学习伙伴。

主要特性

Live API 提供了一套全面的功能,用于构建强大的语音代理:

- 多语言支持:支持用 70 种语言进行对话。

- 打断功能:用户可以随时中断模型,以便进行响应式互动。

- 工具使用:集成函数调用和 Google 搜索等工具,实现动态交互。

- 音频转写:提供用户输入和模型输出的文本转写内容。

- 主动音频:可让您控制模型何时响应以及在哪些情境下响应。

- 共情对话:根据用户输入内容的情绪表达调整回答风格和语气。

技术规范

下表列出了 Live API 的技术规范:

| 类别 | 详细信息 |

|---|---|

| 输入模态 | 音频(原始 16 位 PCM 音频,16kHz,小端序)、图片(JPEG <= 1FPS)、文本 |

| 输出模态 | 音频(原始 16 位 PCM 音频,24kHz,小端序) |

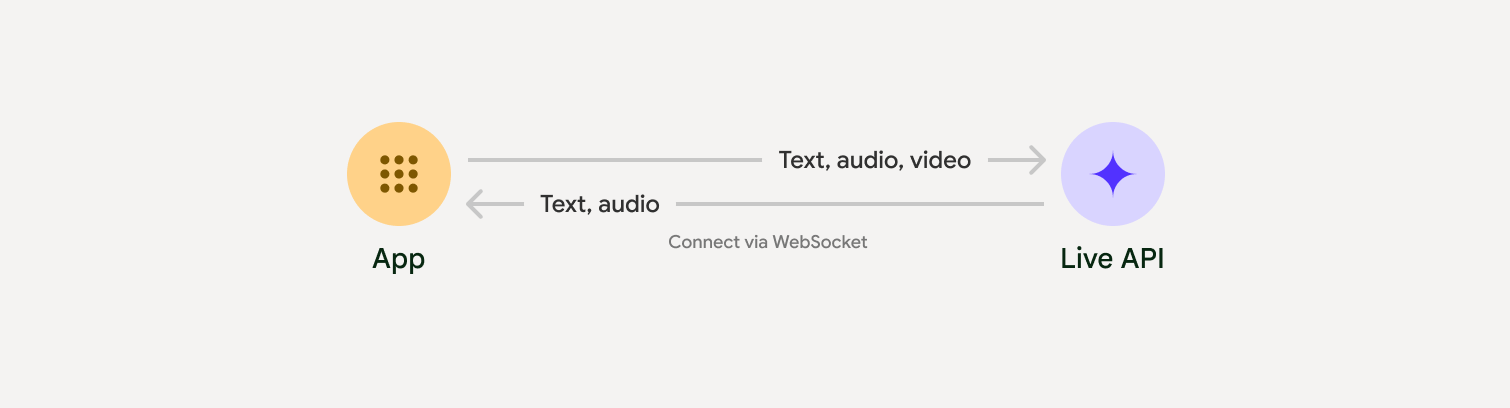

| 协议 | 有状态 WebSocket 连接 (WSS) |

选择一种实现方法

与 Live API 集成时,您需要选择以下实现方法之一:

- 服务器到服务器:您的后端使用 WebSockets 连接到 Live API。通常,您的客户端会将流数据(音频、视频、文本)发送到您的服务器,然后您的服务器会将这些数据转发到 Live API。

- 客户端到服务器:您的前端代码使用 WebSockets 直接连接到 Live API 以流式传输数据,从而绕过后端。

开始使用

选择与您的开发环境相符的指南:

合作伙伴集成

为了简化实时音频和视频应用的开发,您可以使用通过 WebRTC 或 WebSockets 支持 Gemini Live API 的第三方集成。

LiveKit

将 Gemini Live API 与 LiveKit 智能体搭配使用。

Pipecat by Daily

使用 Gemini Live 和 Pipecat 创建实时 AI 聊天机器人。

Software Mansion 的 Fishjam

使用 Fishjam 创建实时视频和音频流式传输应用。

Stream 的 Vision Agent

使用 Vision Agent 构建实时语音和视频 AI 应用。

Voximplant

通过 Voximplant 将入站和出站通话连接到 Live API。

Agora

使用 Agora 构建实时对话式 AI 应用。

Firebase AI SDK

使用 Firebase AI Logic 开始使用 Gemini Live API。