Live API cho phép tương tác bằng giọng nói và hình ảnh theo thời gian thực với độ trễ thấp với Gemini. API này xử lý các luồng âm thanh, hình ảnh và văn bản liên tục để đưa ra các câu trả lời bằng giọng nói tức thì, giống như con người, tạo ra trải nghiệm trò chuyện tự nhiên cho người dùng.

Trường hợp sử dụng

Bạn có thể dùng Live API để xây dựng các tác nhân giọng nói theo thời gian thực cho nhiều ngành, bao gồm:

- Thương mại điện tử và bán lẻ: Trợ lý mua sắm đưa ra các đề xuất được cá nhân hoá và các tác nhân hỗ trợ giải quyết vấn đề cho khách hàng.

- Trò chơi: Các nhân vật không phải người chơi (NPC) tương tác, trợ lý trợ giúp trong trò chơi và bản dịch theo thời gian thực của nội dung trong trò chơi.

- Giao diện thế hệ tiếp theo: Trải nghiệm hỗ trợ giọng nói và video trong lĩnh vực robot, kính thông minh và xe.

- Chăm sóc sức khoẻ: Trợ lý sức khoẻ hỗ trợ và giáo dục bệnh nhân.

- Dịch vụ tài chính: Cố vấn AI để quản lý tài sản và hướng dẫn đầu tư.

- Giáo dục: Người hướng dẫn AI và trợ lý học tập cung cấp hướng dẫn và ý kiến phản hồi được cá nhân hoá.

Các tính năng chính

Live API cung cấp một bộ tính năng toàn diện để xây dựng các tác nhân giọng nói mạnh mẽ:

- Hỗ trợ đa ngôn ngữ: Trò chuyện bằng 70 ngôn ngữ được hỗ trợ.

- Barge-in: Người dùng có thể ngắt lời mô hình bất cứ lúc nào để tương tác phản hồi.

- Sử dụng công cụ: Tích hợp các công cụ như gọi hàm và Google Tìm kiếm để tương tác linh hoạt.

- Bản chép lời âm thanh: Cung cấp bản chép lời dạng văn bản của cả hoạt động đầu vào của người dùng và đầu ra của mô hình.

- Âm thanh chủ động: Cho phép bạn kiểm soát thời điểm mô hình phản hồi và trong những ngữ cảnh nào.

- Đối thoại cảm xúc: Điều chỉnh kiểu và giọng điệu phản hồi cho phù hợp với biểu cảm đầu vào của người dùng.

Quy cách kỹ thuật

Bảng sau đây trình bày quy cách kỹ thuật của Live API:

| Danh mục | Thông tin chi tiết |

|---|---|

| Phương thức đầu vào | Âm thanh (âm thanh PCM 16 bit thô, 16 kHz, little-endian), hình ảnh (JPEG <= 1 FPS), văn bản |

| Phương thức đầu ra | Âm thanh (âm thanh PCM 16 bit thô, 24 kHz, little-endian) |

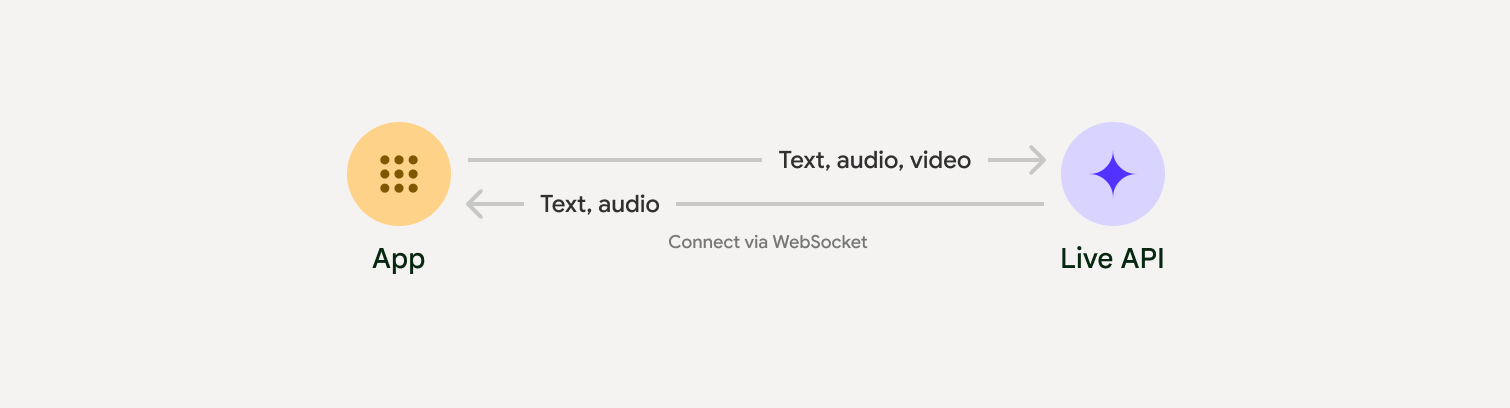

| Giao thức | Kết nối WebSocket có trạng thái (WSS) |

Chọn phương pháp triển khai

Khi tích hợp với Live API, bạn cần chọn một trong các phương pháp triển khai sau:

- Máy chủ đến máy chủ: Phần phụ trợ của bạn kết nối với Live API bằng WebSockets. Thông thường, ứng dụng gửi dữ liệu luồng (âm thanh, video, văn bản) đến máy chủ của bạn, sau đó chuyển tiếp dữ liệu đó đến Live API.

- Ứng dụng đến máy chủ: Mã giao diện người dùng kết nối trực tiếp với Live API sử dụng WebSockets để truyền trực tuyến dữ liệu, bỏ qua phần phụ trợ.

Bắt đầu

Chọn hướng dẫn phù hợp với môi trường phát triển của bạn:

Hướng dẫn về GenAI SDK

Kết nối với Gemini Live API bằng GenAI SDK để xây dựng một ứng dụng đa phương thức theo thời gian thực với phần phụ trợ Python.

Hướng dẫn về WebSocket

Kết nối với Gemini Live API bằng WebSocket để xây dựng một ứng dụng đa phương thức theo thời gian thực với giao diện người dùng JavaScript và mã thông báo tạm thời.

Hướng dẫn về ADK

Tạo một tác nhân và sử dụng tính năng Truyền trực tuyến của Bộ công cụ phát triển tác nhân (ADK) để bật tính năng giao tiếp bằng giọng nói và video.

Nền tảng tích hợp của đối tác

Để đơn giản hoá việc phát triển các ứng dụng âm thanh và video theo thời gian thực, bạn có thể sử dụng một nền tảng tích hợp của bên thứ ba hỗ trợ Gemini Live API qua WebRTC hoặc WebSocket.

LiveKit

Sử dụng Gemini Live API với các tác nhân LiveKit.

Pipecat của Daily

Tạo một chatbot AI theo thời gian thực bằng Gemini Live và Pipecat.

Fishjam của Software Mansion

Tạo các ứng dụng truyền trực tuyến video trực tiếp và âm thanh bằng Fishjam.

Tác nhân hình ảnh của Stream

Xây dựng các ứng dụng AI bằng giọng nói và video theo thời gian thực bằng Tác nhân hình ảnh.

Voximplant

Kết nối các cuộc gọi đến và đi với Live API bằng Voximplant.

Agora

Xây dựng các ứng dụng AI đàm thoại theo thời gian thực bằng Agora.

Firebase AI SDK

Bắt đầu sử dụng Gemini Live API bằng Firebase AI Logic.