Interfejs Gemini API udostępnia ustawienia bezpieczeństwa, które możesz dostosować na etapie prototypowania, aby określić, czy aplikacja wymaga bardziej czy mniej restrykcyjnej konfiguracji bezpieczeństwa. Możesz dostosować te ustawienia w 4 kategoriach filtrów, aby ograniczyć lub zezwolić na określone typy treści.

Z tego przewodnika dowiesz się, jak interfejs Gemini API obsługuje ustawienia bezpieczeństwa i filtrowanie oraz jak możesz zmienić ustawienia bezpieczeństwa aplikacji.

Filtry bezpieczeństwa

Dostosowywane filtry bezpieczeństwa Gemini API obejmują te kategorie:

| Kategoria | Opis |

|---|---|

| Nękanie | Negatywne lub szkodliwe komentarze dotyczące tożsamości innej osoby bądź cech chronionych |

| Szerzenie nienawiści | Treści, które są niegrzeczne, lekceważące lub wulgarne. |

| Treści o charakterze jednoznacznie seksualnym | Zawierają odniesienia do aktów seksualnych lub inne treści obsceniczne. |

| Treści niebezpieczne | Promują, ułatwiają lub zachęcają do szkodliwych działań. |

Te kategorie są zdefiniowane w HarmCategory. Za pomocą tych filtrów możesz dostosować, co jest odpowiednie w Twoim przypadku użycia. Jeśli na przykład tworzysz dialogi w grze wideo, możesz zezwolić na więcej treści ocenionych jako niebezpieczne ze względu na charakter gry.

Oprócz dostosowywanych filtrów bezpieczeństwa interfejs Gemini API ma wbudowane zabezpieczenia przed podstawowymi szkodami, takimi jak treści zagrażające bezpieczeństwu dzieci. Te typy szkód są zawsze blokowane i nie można ich dostosować.

Poziom filtrowania treści pod kątem bezpieczeństwa

Interfejs Gemini API klasyfikuje poziom prawdopodobieństwa, że treści są niebezpieczne, jako HIGH, MEDIUM, LOW lub NEGLIGIBLE.

Interfejs Gemini API blokuje treści na podstawie prawdopodobieństwa, że są one niebezpieczne, a nie na podstawie ich szkodliwości. Warto o tym pamiętać, ponieważ niektóre treści mogą mieć niskie prawdopodobieństwo, że są niebezpieczne, ale ich szkodliwość może być wysoka. Porównaj na przykład te zdania:

- Robot mnie uderzył.

- Robot mnie pociął.

Pierwsze zdanie może skutkować wyższym prawdopodobieństwem, że jest niebezpieczne, ale drugie zdanie może być bardziej szkodliwe pod względem przemocy. Dlatego ważne jest, aby dokładnie przetestować i rozważyć, jaki poziom blokowania jest potrzebny do obsługi kluczowych przypadków użycia, przy jednoczesnym zminimalizowaniu szkód dla użytkowników.

Filtrowanie pod kątem bezpieczeństwa na podstawie żądania

Ustawienia bezpieczeństwa możesz dostosować w przypadku każdego żądania wysyłanego do interfejsu API. Gdy wysyłasz żądanie, treści są analizowane i przypisywana jest im ocena bezpieczeństwa. Ocena bezpieczeństwa obejmuje kategorię i prawdopodobieństwo klasyfikacji szkody. Jeśli na przykład treści zostały zablokowane, ponieważ system stwierdził wysokie prawdopodobieństwo wystąpienia treści nękających, ocena bezpieczeństwa będzie zawierać kategorię HARASSMENT i prawdopodobieństwo szkody ustawione na HIGH.

Ze względu na wbudowane zabezpieczenia modelu dodatkowe filtry są domyślnie wyłączone. Jeśli zdecydujesz się je włączyć, możesz skonfigurować system tak, aby blokował treści na podstawie prawdopodobieństwa, że są one niebezpieczne. Domyślne działanie modelu obejmuje większość przypadków użycia, dlatego te ustawienia należy dostosowywać tylko wtedy, gdy jest to na dłuższą metę niezbędne w danej aplikacji.

W tabeli poniżej opisujemy ustawienia blokowania, które możesz dostosować w każdej kategorii. Jeśli na przykład ustawisz w kategorii Szerzenie nienawiści ustawienie blokowania na Blokuj niektóre, zablokowane zostaną wszystkie treści, które z dużym prawdopodobieństwem są treściami szerzącymi nienawiść. Wszystkie treści o niższym prawdopodobieństwie zostaną dopuszczone.

| Próg (Google AI Studio) | Próg (interfejs API) | Opis |

|---|---|---|

| Wył. | OFF |

Wyłącz filtr bezpieczeństwa |

| Nie blokuj niczego | BLOCK_NONE |

Zawsze wyświetlaj treści niezależnie od prawdopodobieństwa wystąpienia treści niebezpiecznych |

| Blokuj niektóre | BLOCK_ONLY_HIGH |

Blokuj, gdy prawdopodobieństwo wystąpienia treści niebezpiecznych jest wysokie |

| Blokuj część | BLOCK_MEDIUM_AND_ABOVE |

Blokuj, gdy prawdopodobieństwo wystąpienia treści niebezpiecznych jest średnie lub wysokie |

| Blokuj większość | BLOCK_LOW_AND_ABOVE |

Blokuj, gdy prawdopodobieństwo wystąpienia treści niebezpiecznych jest niskie, średnie lub wysokie |

| Nie dotyczy | HARM_BLOCK_THRESHOLD_UNSPECIFIED |

Próg nie jest określony, blokuj przy użyciu domyślnego progu |

Jeśli próg nie jest ustawiony, domyślny próg blokowania jest wyłączony w przypadku modeli Gemini 2.5 i 3.

Te ustawienia możesz skonfigurować w przypadku każdego żądania wysyłanego do usługi generatywnej.

Więcej informacji znajdziesz w dokumentacji interfejsu API HarmBlockThreshold.

Opinie dotyczące bezpieczeństwa

generateContent

zwraca

GenerateContentResponse, który

zawiera opinie dotyczące bezpieczeństwa.

Opinie dotyczące promptów są zawarte w

promptFeedback. Jeśli ustawiony jest parametr promptFeedback.blockReason, oznacza to, że treść promptu została zablokowana.

Opinie dotyczące kandydatów na odpowiedzi są zawarte w

Candidate.finishReason i

Candidate.safetyRatings. Jeśli treść odpowiedzi została zablokowana, a finishReason to SAFETY, możesz sprawdzić safetyRatings, aby uzyskać więcej informacji. Zablokowane treści nie są zwracane.

Dostosowywanie ustawień bezpieczeństwa

Z tej sekcji dowiesz się, jak dostosować ustawienia bezpieczeństwa w Google AI Studio i w kodzie.

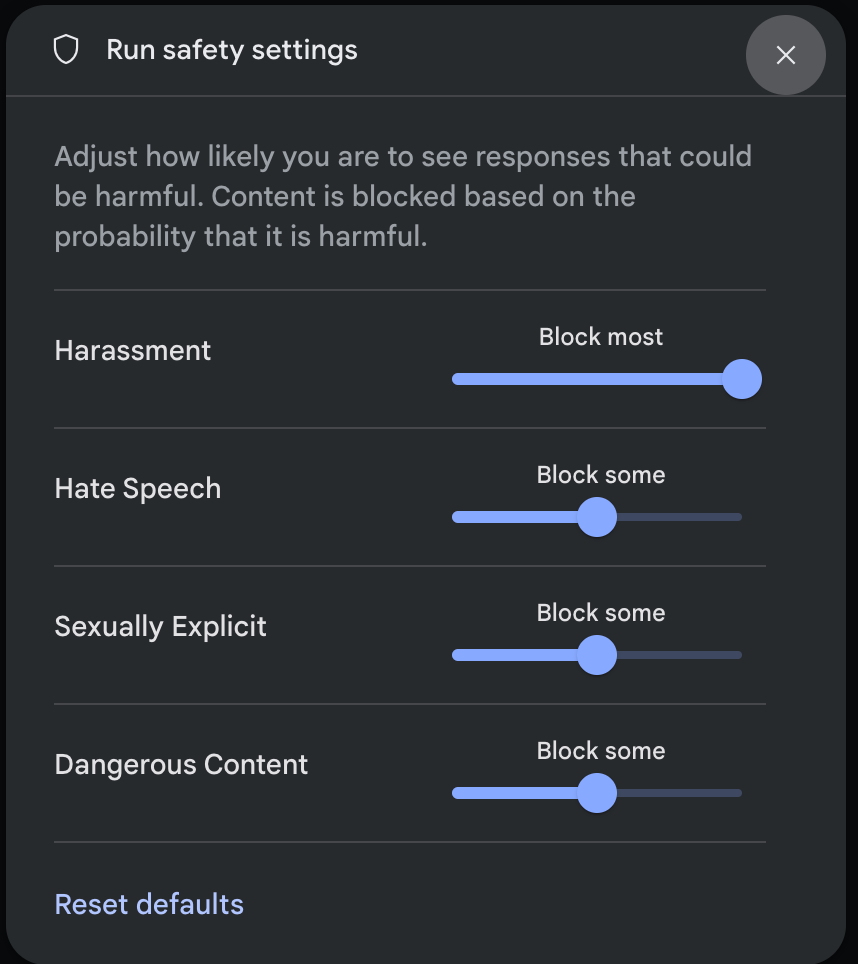

Google AI Studio

Ustawienia bezpieczeństwa możesz dostosować w Google AI Studio.

W panelu Ustawienia uruchamiania kliknij Ustawienia bezpieczeństwa w sekcji Ustawienia zaawansowane , aby otworzyć okno Ustawienia bezpieczeństwa uruchamiania. W tym oknie możesz użyć suwaków, aby dostosować poziom filtrowania treści w każdej kategorii bezpieczeństwa:

Gdy wyślesz żądanie (np. zadając modelowi pytanie), a jego treść zostanie zablokowana, pojawi się komunikat Treść zablokowana. Aby zobaczyć więcej szczegółów, najedź wskaźnikiem na tekst Treść zablokowana , aby zobaczyć kategorię i prawdopodobieństwo klasyfikacji szkody.

Przykłady kodu

Poniższy fragment kodu pokazuje, jak ustawić ustawienia bezpieczeństwa w wywołaniu GenerateContent. Ustawia on próg dla kategorii szerzenia nienawiści (HARM_CATEGORY_HATE_SPEECH). Ustawienie tej kategorii na BLOCK_LOW_AND_ABOVE blokuje wszystkie treści, które z niskim lub wyższym prawdopodobieństwem są treściami szerzącymi nienawiść. Aby zrozumieć ustawienia progu, przeczytaj sekcję Filtrowanie pod kątem bezpieczeństwa

na podstawie żądania.

Python

from google import genai

from google.genai import types

client = genai.Client()

response = client.models.generate_content(

model="gemini-3-flash-preview",

contents="Some potentially unsafe prompt",

config=types.GenerateContentConfig(

safety_settings=[

types.SafetySetting(

category=types.HarmCategory.HARM_CATEGORY_HATE_SPEECH,

threshold=types.HarmBlockThreshold.BLOCK_LOW_AND_ABOVE,

),

]

)

)

print(response.text)

Go

package main

import (

"context"

"fmt"

"log"

"google.golang.org/genai"

)

func main() {

ctx := context.Background()

client, err := genai.NewClient(ctx, nil)

if err != nil {

log.Fatal(err)

}

config := &genai.GenerateContentConfig{

SafetySettings: []*genai.SafetySetting{

{

Category: "HARM_CATEGORY_HATE_SPEECH",

Threshold: "BLOCK_LOW_AND_ABOVE",

},

},

}

response, err := client.Models.GenerateContent(

ctx,

"gemini-3-flash-preview",

genai.Text("Some potentially unsafe prompt."),

config,

)

if err != nil {

log.Fatal(err)

}

fmt.Println(response.Text())

}

JavaScript

import { GoogleGenAI } from "@google/genai";

const ai = new GoogleGenAI({});

const safetySettings = [

{

category: "HARM_CATEGORY_HATE_SPEECH",

threshold: "BLOCK_LOW_AND_ABOVE",

},

];

async function main() {

const response = await ai.models.generateContent({

model: "gemini-3-flash-preview",

contents: "Some potentially unsafe prompt.",

config: {

safetySettings: safetySettings,

},

});

console.log(response.text);

}

await main();

Java

SafetySetting hateSpeechSafety = new SafetySetting(HarmCategory.HATE_SPEECH,

BlockThreshold.LOW_AND_ABOVE);

GenerativeModel gm = new GenerativeModel(

"gemini-3-flash-preview",

BuildConfig.apiKey,

null, // generation config is optional

Arrays.asList(hateSpeechSafety)

);

GenerativeModelFutures model = GenerativeModelFutures.from(gm);

REST

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-flash-preview:generateContent" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H "Content-Type: application/json" \

-X POST \

-d '{

"safetySettings": [

{"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_LOW_AND_ABOVE"}

],

"contents": [{

"parts":[{

"text": "'\''Some potentially unsafe prompt.'\''"

}]

}]

}'

Dalsze kroki

- Więcej informacji o pełnym interfejsie API znajdziesz w dokumentacji API.

- Zapoznaj się z wytycznymi dotyczącymi bezpieczeństwa, aby uzyskać ogólne informacje o kwestiach związanych z bezpieczeństwem podczas tworzenia aplikacji z użyciem dużych modeli językowych.

- Dowiedz się więcej o ocenie prawdopodobieństwa w porównaniu z szkodliwością od zespołu Jigsaw team

- Dowiedz się więcej o produktach, które przyczyniają się do tworzenia rozwiązań w zakresie bezpieczeństwa, takich jak Perspective API. * Za pomocą tych ustawień bezpieczeństwa możesz utworzyć klasyfikator toksyczności. Na początek zapoznaj się z przykładem klasyfikacji.