Detyra Object Detector ju lejon të zbuloni praninë dhe vendndodhjen e klasave të shumta të objekteve. Për shembull, një detektor objektesh mund të lokalizojë qentë brenda një imazhi. Këto udhëzime ju tregojnë se si të përdorni detyrën e Detektorit të Objekteve në iOS. Shembulli i kodit i përshkruar në këto udhëzime është i disponueshëm në GitHub .

Ju mund ta shihni këtë detyrë në veprim duke parë këtë demonstrim në ueb . Për më shumë informacion rreth aftësive, modeleve dhe opsioneve të konfigurimit të kësaj detyre, shihni Përmbledhjen .

Shembull kodi

Kodi i shembullit të MediaPipe Tasks është një zbatim bazë i një aplikacioni Object Detector për iOS. Shembulli përdor kamerën në një pajisje fizike iOS për të zbuluar vazhdimisht objekte, dhe gjithashtu mund të përdorë imazhe dhe video nga galeria e pajisjes për të zbuluar në mënyrë statike objektet.

Mund ta përdorni aplikacionin si pikënisje për aplikacionin tuaj iOS ose t'i referoheni kur modifikoni një aplikacion ekzistues. Shembulli i kodit të Detektorit të Objekteve gjendet në GitHub .

Shkarkoni kodin

Udhëzimet e mëposhtme ju tregojnë se si të krijoni një kopje lokale të kodit shembull duke përdorur mjetin e linjës së komandës git .

Për të shkarkuar kodin shembull:

Klononi depon e git duke përdorur komandën e mëposhtme:

git clone https://github.com/google-ai-edge/mediapipe-samplesOpsionale, konfiguroni shembullin tuaj të git për të përdorur arka të rrallë, në mënyrë që të keni vetëm skedarët për shembullin e aplikacionit Object Detector:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/object_detection/ios/

Pas krijimit të një versioni lokal të kodit shembull, mund të instaloni bibliotekën e detyrave MediaPipe, të hapni projektin duke përdorur Xcode dhe të ekzekutoni aplikacionin. Për udhëzime, shihni Udhëzuesin e konfigurimit për iOS .

Komponentët kryesorë

Skedarët e mëposhtëm përmbajnë kodin vendimtar për shembullin e aplikacionit Object Detector:

- ObjectDetectorService.swift : Inicializon detektorin, trajton zgjedhjen e modelit dhe ekzekuton konkluzionet në të dhënat hyrëse.

- CameraViewController.swift : Zbaton ndërfaqen e përdoruesit për modalitetin e hyrjes së furnizimit të drejtpërdrejtë të kamerës dhe vizualizon rezultatet e zbulimit.

- MediaLibraryViewController.swift : Zbaton ndërfaqen e përdoruesit për modalitetin e futjes së skedarëve të imazheve dhe videove dhe vizualizon rezultatet e zbulimit.

Konfigurimi

Ky seksion përshkruan hapat kryesorë për konfigurimin e mjedisit tuaj të zhvillimit dhe projekteve të kodit për të përdorur Detektorin e Objekteve. Për informacion të përgjithshëm mbi konfigurimin e mjedisit tuaj të zhvillimit për përdorimin e detyrave të MediaPipe, duke përfshirë kërkesat e versionit të platformës, shihni udhëzuesin e konfigurimit për iOS .

varësitë

Object Detector përdor bibliotekën MediaPipeTasksVision , e cila duhet të instalohet duke përdorur CocoaPods. Biblioteka është e pajtueshme me të dy aplikacionet Swift dhe Objective-C dhe nuk kërkon ndonjë konfigurim shtesë specifik për gjuhën.

Për udhëzime për instalimin e CocoaPods në macOS, referojuni udhëzuesit të instalimit të CocoaPods . Për udhëzime se si të krijoni një Podfile me pods-et e nevojshme për aplikacionin tuaj, referojuni Përdorimit të CocoaPods .

Shtoni podin MediaPipeTasksVision në Podfile duke përdorur kodin e mëposhtëm:

target 'MyObjectDetectorApp' do

use_frameworks!

pod 'MediaPipeTasksVision'

end

Nëse aplikacioni juaj përfshin objektiva testimi të njësisë, referojuni Udhëzuesit të konfigurimit për iOS për informacion shtesë mbi konfigurimin e skedarit tuaj Podfile .

Model

Detyra MediaPipe Object Detector kërkon një model të trajnuar që është në përputhje me këtë detyrë. Për më shumë informacion rreth modeleve të trajnuara të disponueshme për Detektorin e Objekteve, shihni seksionin Modelet e përmbledhjes së detyrave.

Zgjidhni dhe shkarkoni një model dhe shtoni atë në drejtorinë e projektit tuaj duke përdorur Xcode. Për udhëzime se si të shtoni skedarë në projektin tuaj Xcode, referojuni Menaxhimi i skedarëve dhe dosjeve në projektin tuaj Xcode .

Përdorni veçorinë BaseOptions.modelAssetPath për të specifikuar shtegun drejt modelit në paketën tuaj të aplikacionit. Për një shembull kodi, shihni seksionin tjetër.

Krijo detyrën

Ju mund të krijoni detyrën e Detektorit të Objekteve duke thirrur një nga inicializuesit e tij. Inicializuesi i ObjectDetector(options:) vendos vlerat për opsionet e konfigurimit duke përfshirë modalitetin e ekzekutimit, vendndodhjen e emrave të shfaqur, numrin maksimal të rezultateve, pragun e besimit, listën e lejeve të kategorive dhe listën e refuzimit.

Nëse nuk keni nevojë për një Detektor Objektesh të inicializuar me opsione të personalizuara të konfigurimit, mund të përdorni iniciatorin ObjectDetector(modelPath:) për të krijuar një Detektor Objektesh me opsionet e paracaktuara. Për më shumë informacion rreth opsioneve të konfigurimit, shihni Përmbledhjen e konfigurimit .

Detyra Object Detector mbështet 3 lloje të dhënash hyrëse: imazhe statike, skedarë video dhe transmetime video të drejtpërdrejta. Si parazgjedhje, ObjectDetector(modelPath:) inicializon një detyrë për imazhet statike. Nëse dëshironi që detyra juaj të inicializohet për të përpunuar skedarë video ose transmetime video të drejtpërdrejta, përdorni ObjectDetector(options:) për të specifikuar modalitetin e ekzekutimit të videos ose transmetimit të drejtpërdrejtë. Modaliteti i transmetimit të drejtpërdrejtë kërkon gjithashtu opsionin shtesë të konfigurimit të objectDetectorLiveStreamDelegate , i cili i mundëson Detektorit të Objekteve t'i japë delegatit rezultatet e zbulimit në mënyrë asinkrone.

Zgjidhni skedën që korrespondon me modalitetin tuaj të ekzekutimit për të parë se si të krijoni detyrën dhe të ekzekutoni konkluzionet.

Swift

Imazhi

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .image options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

Video

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .video options.maxResults = 5 let objectDetector = try ObjectDetector(options: options)

transmetim i drejtpërdrejtë

import MediaPipeTasksVision // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. class ObjectDetectorResultProcessor: NSObject, ObjectDetectorLiveStreamDelegate { func objectDetector( _ objectDetector: ObjectDetector, didFinishDetection objectDetectionResult: ObjectDetectorResult?, timestampInMilliseconds: Int, error: Error?) { // Process the detection result or errors here. } } let modelPath = Bundle.main.path(forResource: "model", ofType: "tflite") let options = ObjectDetectorOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .liveStream options.maxResults = 5 // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. let processor = ObjectDetectorResultProcessor() options.objectDetectorLiveStreamDelegate = processor let objectDetector = try ObjectDetector(options: options)

Objektivi-C

Imazhi

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeImage; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

Video

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeVideo; options.maxResults = 5; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

transmetim i drejtpërdrejtë

@import MediaPipeTasksVision; // Class that conforms to the `ObjectDetectorLiveStreamDelegate` protocol and // implements the method that the object detector calls once it // finishes performing detection on each input frame. @interface APPObjectDetectorResultProcessor : NSObject@end @implementation MPPObjectDetectorResultProcessor - (void)objectDetector:(MPPObjectDetector *)objectDetector didFinishDetectionWithResult:(MPPObjectDetectorResult *)ObjectDetectorResult timestampInMilliseconds:(NSInteger)timestampInMilliseconds error:(NSError *)error { // Process the detection result or errors here. } @end NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"model" ofType:@"tflite"]; MPPObjectDetectorOptions *options = [[MPPObjectDetectorOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeLiveStream; options.maxResults = 5; // Assign an object of the class to the `objectDetectorLiveStreamDelegate` // property. APPObjectDetectorResultProcessor *processor = [APPObjectDetectorResultProcessor new]; options.objectDetectorLiveStreamDelegate = processor; MPPObjectDetector *objectDetector = [[MPPObjectDetector alloc] initWithOptions:options error:nil];

Opsionet e konfigurimit

Kjo detyrë ka opsionet e mëposhtme të konfigurimit për aplikacionet iOS:

| Emri i opsionit | Përshkrimi | Gama e vlerave | Vlera e paracaktuar |

|---|---|---|---|

runningMode | Vendos modalitetin e ekzekutimit për detyrën. Ekzistojnë tre mënyra: IMAGE: Modaliteti për hyrjet e një imazhi të vetëm. VIDEO: Modaliteti për kornizat e dekoduara të një videoje. LIVE_STREAM: Modaliteti për një transmetim të drejtpërdrejtë të të dhënave hyrëse, si p.sh. nga një aparat fotografik. Në këtë modalitet, resultListener duhet të thirret për të vendosur një dëgjues për të marrë rezultatet në mënyrë asinkrone. | { RunningMode.image, RunningMode.video, RunningMode.liveStream } | RunningMode.image |

displayNamesLocales | Vendos gjuhën e etiketave për t'u përdorur për emrat e shfaqur të dhëna në meta të dhënat e modelit të detyrës, nëse disponohet. Parazgjedhja është en për anglisht. Ju mund të shtoni etiketa të lokalizuara në meta të dhënat e një modeli të personalizuar duke përdorur API-në e shkrimtarit metadata TensorFlow Lite | Kodi lokal | sq |

maxResults | Vendos numrin maksimal opsional të rezultateve të zbulimit me pikët më të larta për t'u kthyer. | Çdo numër pozitiv | -1 (të gjitha rezultatet kthehen) |

scoreThreshold | Vendos pragun e rezultatit të parashikimit që tejkalon atë të dhënë në meta të dhënat e modelit (nëse ka). Rezultatet nën këtë vlerë refuzohen. | Çdo noton | Nuk është vendosur |

categoryAllowlist | Vendos listën opsionale të emrave të kategorive të lejuara. Nëse nuk janë bosh, rezultatet e zbulimit, emri i kategorisë së të cilave nuk është në këtë grup do të filtrohen. Emrat e kopjuar ose të panjohur të kategorive shpërfillen. Ky opsion është reciprokisht ekskluziv me categoryDenylist dhe duke përdorur të dyja rezulton në një gabim. | Çdo varg | Nuk është vendosur |

categoryDenylist | Vendos listën opsionale të emrave të kategorive që nuk lejohen. Nëse nuk janë bosh, rezultatet e zbulimit, emri i kategorisë së të cilave është në këtë grup do të filtrohen. Emrat e kopjuar ose të panjohur të kategorive shpërfillen. Ky opsion është reciprokisht ekskluziv me categoryAllowlist dhe duke përdorur të dyja rezultatet në një gabim. | Çdo varg | Nuk është vendosur |

Konfigurimi i transmetimit të drejtpërdrejtë

Kur modaliteti i ekzekutimit vendoset në transmetim të drejtpërdrejtë, Detektori i Objekteve kërkon opsionin shtesë të konfigurimit të objectDetectorLiveStreamDelegate , i cili i mundëson detektorit të japë rezultatet e zbulimit në mënyrë asinkrone. Delegati zbaton metodën objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:) , të cilën Detektori i Objekteve e thërret pas përpunimit të rezultatit të zbulimit për çdo kornizë.

| Emri i opsionit | Përshkrimi | Gama e vlerave | Vlera e paracaktuar |

|---|---|---|---|

objectDetectorLiveStreamDelegate | Aktivizon Detektorin e Objekteve të marrë rezultatet e zbulimit në mënyrë asinkrone në modalitetin e transmetimit të drejtpërdrejtë. Klasa instanca e së cilës është vendosur në këtë veti duhet të zbatojë metodën objectDetector(_:didFinishDetection:timestampInMilliseconds:error:) . | E pazbatueshme | Nuk është vendosur |

Përgatitni të dhënat

Ju duhet të konvertoni imazhin ose kornizën hyrëse në një objekt MPImage përpara se ta kaloni atë në Detektorin e Objekteve. MPImage mbështet lloje të ndryshme të formateve të imazhit iOS dhe mund t'i përdorë ato në çdo modalitet ekzekutimi për përfundime. Për më shumë informacion rreth MPImage , referojuni MPImage API .

Zgjidhni një format imazhi iOS bazuar në rastin tuaj të përdorimit dhe mënyrën e ekzekutimit që kërkon aplikacioni juaj. MPImage pranon formatet e imazhit UIImage , CVPixelBuffer dhe CMSampleBuffer iOS.

UIIimazh

Formati UIImage është i përshtatshëm për mënyrat e mëposhtme të funksionimit:

Imazhet: imazhet nga një grup aplikacioni, galeri përdoruesish ose sistem skedarësh të formatuar si imazhe

UIImagemund të konvertohen në një objektMPImage.Videot: përdorni AVAssetImageGenerator për të nxjerrë kornizat video në formatin CGImage , më pas i konvertoni ato në imazhe

UIImage.

Swift

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(uiImage: image)

Objektivi-C

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

Shembulli inicializon një MPImage me orientimin e paracaktuar UIImage.Orientation.Up . Mund të inicializoni një MPImage me ndonjë nga vlerat e mbështetura të UIImage.Orientation . Detektori i objekteve nuk mbështet orientime të pasqyruara si .upMirrored , .downMirrored , .leftMirrored , .rightMirrored .

Për më shumë informacion rreth UIImage , referojuni Dokumentacionit të Zhvilluesit të UIImage Apple .

CVPixelBuffer

Formati CVPixelBuffer është i përshtatshëm për aplikacionet që gjenerojnë korniza dhe përdorin kornizën iOS CoreImage për përpunim.

Formati CVPixelBuffer është i përshtatshëm për mënyrat e mëposhtme të funksionimit:

Imazhet: aplikacionet që gjenerojnë imazhe

CVPixelBufferpas disa përpunimit duke përdorur kornizënCoreImagetë iOS, mund të dërgohen në Detektorin e Objekteve në modalitetin e ekzekutimit të imazhit.Videot: kornizat video mund të konvertohen në formatin

CVPixelBufferpër përpunim dhe më pas të dërgohen në Detektorin e Objekteve në modalitetin e videos.transmetim i drejtpërdrejtë: aplikacionet që përdorin një kamerë iOS për të gjeneruar korniza mund të konvertohen në formatin

CVPixelBufferpër përpunim përpara se të dërgohen në Detektorin e Objekteve në modalitetin e transmetimit të drejtpërdrejtë.

Swift

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(pixelBuffer: pixelBuffer)

Objektivi-C

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

Për më shumë informacion rreth CVPixelBuffer , referojuni Dokumentacionit të Zhvilluesit të Apple CVPixelBuffer .

CMSampleBuffer

Formati CMSampleBuffer ruan mostrat e mediave të një lloji uniform të medias dhe është i përshtatshëm për modalitetin e ekzekutimit të transmetimit të drejtpërdrejtë. Kornizat e drejtpërdrejta nga kamerat iOS shpërndahen në mënyrë asinkrone në formatin CMSampleBuffer nga iOS AVCaptureVideoDataOutput .

Swift

// Obtain a CMSampleBuffer. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(sampleBuffer: sampleBuffer)

Objektivi-C

// Obtain a `CMSampleBuffer`. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithSampleBuffer:sampleBuffer error:nil];

Për më shumë informacion rreth CMSampleBuffer , referojuni Dokumentacionit të Zhvilluesit të Apple CMSampleBuffer .

Drejtoni detyrën

Për të ekzekutuar Detektorin e Objekteve, përdorni metodën detect() specifike për modalitetin e caktuar të funksionimit:

- Imazhi i palëvizshëm:

detect(image:) - Video:

detect(videoFrame:timestampInMilliseconds:) - transmetim i drejtpërdrejtë:

detectAsync(image:)

Shembujt e mëposhtëm të kodit tregojnë shembuj bazë se si të ekzekutoni Detektorin e Objekteve në këto mënyra të ndryshme funksionimi:

Swift

Imazhi

let objectDetector.detect(image:image)

Video

let objectDetector.detect(videoFrame:image)

transmetim i drejtpërdrejtë

let objectDetector.detectAsync(image:image)

Objektivi-C

Imazhi

MPPObjectDetectorResult *result = [objectDetector detectInImage:image error:nil];

Video

MPPObjectDetectorResult *result = [objectDetector detectInVideoFrame:image timestampInMilliseconds:timestamp error:nil];

transmetim i drejtpërdrejtë

BOOL success = [objectDetector detectAsyncInImage:image timestampInMilliseconds:timestamp error:nil];

Shembulli i kodit të Detektorit të Objekteve tregon implementimet e secilit prej këtyre mënyrave në më shumë detaje detect(image:) , detect(videoFrame:) dhe detectAsync(image:) . Kodi shembull i lejon përdoruesit të kalojë ndërmjet mënyrave të përpunimit që mund të mos kërkohen për rastin tuaj të përdorimit.

Vini re sa vijon:

Kur ekzekutoni në modalitetin e videos ose në modalitetin e transmetimit të drejtpërdrejtë, duhet të jepni gjithashtu vulën kohore të kornizës së hyrjes në detyrën "Detektori i objekteve".

Kur funksionon në modalitetin e imazhit ose të videos, detyra e Detektorit të Objekteve bllokon fillin aktual derisa të përfundojë përpunimin e imazhit ose kornizës hyrëse. Për të shmangur bllokimin e fillit aktual, ekzekutoni përpunimin në një fill në sfond duke përdorur kornizat iOS Dispatch ose NSOoperation .

Kur ekzekutohet në modalitetin e transmetimit të drejtpërdrejtë, detyra e Detektorit të Objekteve kthehet menjëherë dhe nuk bllokon lidhjen aktuale. Ai thërret metodën

objectDetector(_objectDetector:didFinishDetection:timestampInMilliseconds:error:)me rezultatin e zbulimit pas përpunimit të çdo kornize hyrëse. Detektori i objekteve thërret këtë metodë në mënyrë asinkrone në një radhë të dedikuar dërgimi serik. Për shfaqjen e rezultateve në ndërfaqen e përdoruesit, dërgoni rezultatet në radhën kryesore pas përpunimit të rezultateve. Nëse funksionidetectAsyncthirret kur detyra e Detektorit të Objekteve është e zënë me përpunimin e një kuadri tjetër, Detektori i Objekteve injoron kornizën e re hyrëse.

Trajtoni dhe shfaqni rezultatet

Pas ekzekutimit të konkluzionit, detyra Object Detector kthen një objekt ObjectDetectorResult i cili përshkruan objektet që ka gjetur në imazhin hyrës.

Më poshtë tregon një shembull të të dhënave dalëse nga kjo detyrë:

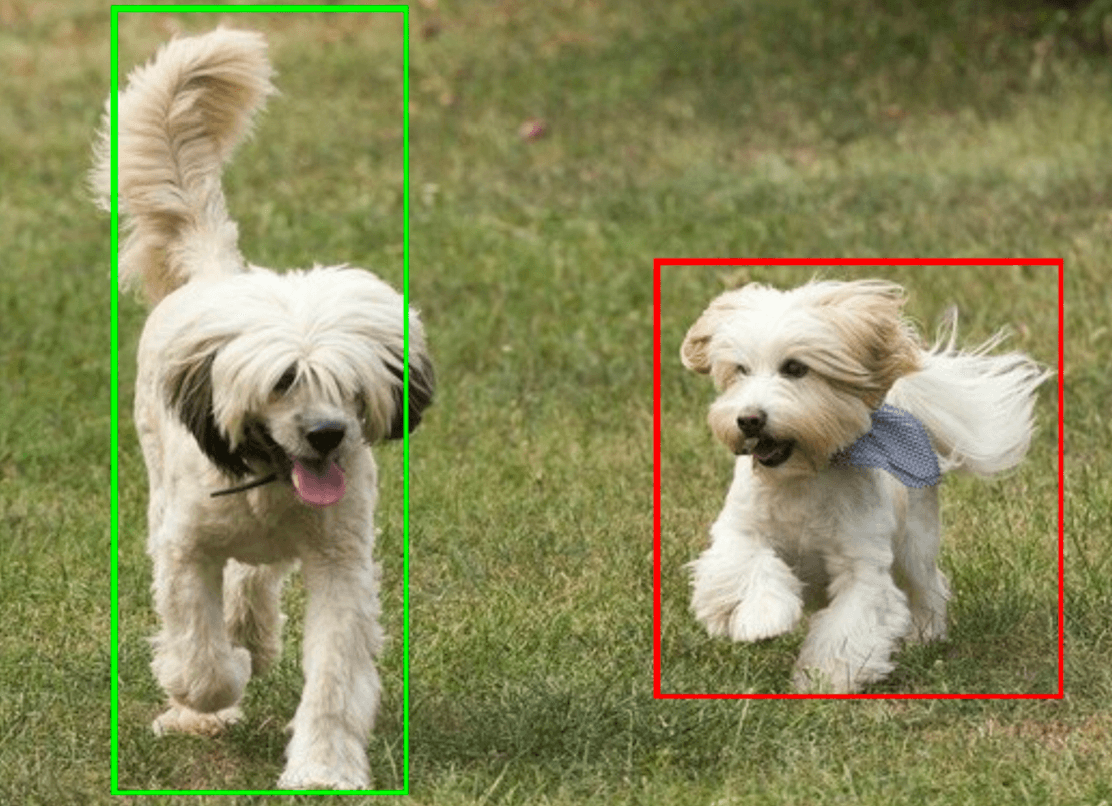

ObjectDetectorResult:

Detection #0:

Box: (x: 355, y: 133, w: 190, h: 206)

Categories:

index : 17

score : 0.73828

class name : dog

Detection #1:

Box: (x: 103, y: 15, w: 138, h: 369)

Categories:

index : 17

score : 0.73047

class name : dog

Imazhi i mëposhtëm tregon një vizualizim të daljes së detyrës:

Shembulli i kodit të detektorit të objekteve tregon se si të shfaqen rezultatet e zbulimit të kthyera nga detyra, shikoni shembullin e kodit për detaje.