Die Live API ermöglicht latenzarme Sprach- und Videointeraktionen mit Gemini in Echtzeit. Sie verarbeitet kontinuierliche Streams von Audio, Bildern und Text, um sofortige, menschenähnliche gesprochene Antworten zu liefern und so eine natürliche Unterhaltung für Ihre Nutzer zu ermöglichen.

Anwendungsfälle

Mit der Live API können Sprachagenten in Echtzeit für eine Vielzahl von Branchen entwickelt werden, darunter:

- E-Commerce und Einzelhandel:Einkaufsassistenten, die personalisierte Empfehlungen geben, und Supportagenten, die Kundenprobleme lösen.

- Gaming:Interaktive Non-Player Characters (NPCs), In-Game-Hilfeassistenten und Echtzeitübersetzung von In-Game-Inhalten.

- Schnittstellen der nächsten Generation:Sprach- und videofähige Erlebnisse in Robotik, Smart Glasses und Fahrzeugen.

- Gesundheitswesen:Gesundheitsbegleiter für die Unterstützung und Aufklärung von Patienten.

- Finanzdienstleistungen:KI-Berater für die Vermögensverwaltung und Anlageberatung.

- Bildung:KI-Mentoren und Lernbegleiter, die personalisierte Anleitungen und Feedback geben.

- Übersetzung und Lokalisierung:Latenzarme Echtzeitübersetzung von gesprochenen Unterhaltungen, die eine nahtlose mehrsprachige Kommunikation ermöglicht.

Wichtige Features

Die Live API bietet eine umfassende Reihe von Funktionen zum Erstellen robuster Sprachagenten:

- Mehrsprachiger Support: Unterhaltungen in 70 unterstützten Sprachen.

- Barge-in: Nutzer können das Modell jederzeit unterbrechen, um reaktionsschnelle Interaktionen zu ermöglichen.

- Tool-Nutzung: Tools wie Funktionsaufrufe und die Google Suche für dynamische Interaktionen einbinden.

- Audiotranskriptionen: Texttranskripte der Nutzereingabe und der Modellausgabe bereitstellen.

- Proaktives Audio: Sie können steuern, wann und in welchen Kontexten das Modell antwortet.

- Affektiver Dialog: Antwortstil und Tonfall an die Ausdrucksweise des Nutzers anpassen.

- Live-Übersetzung: Echtzeitübersetzung von Sprache zu Sprache in über 70 Sprachen.

Technische Spezifikationen

In der folgenden Tabelle sind die technischen Spezifikationen für die Live API aufgeführt:

| Kategorie | Details |

|---|---|

| Eingabemodalitäten | Audio (rohes 16-Bit-PCM-Audio, 16 kHz, Little-Endian), Bilder (JPEG <= 1 FPS), Text |

| Ausgabemodalitäten | Audio (rohes 16-Bit-PCM-Audio, 24 kHz, Little-Endian) |

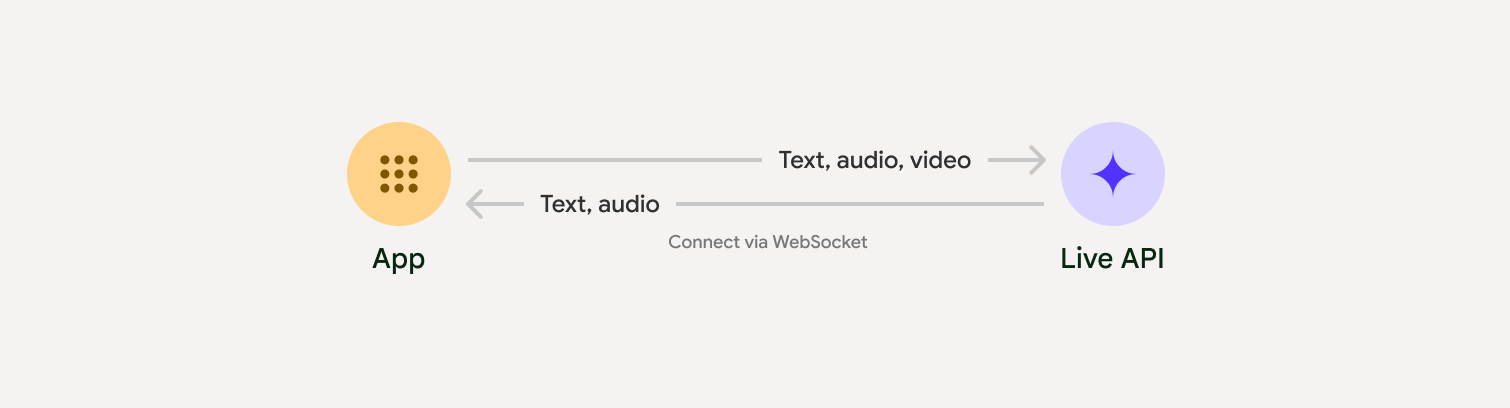

| Protokoll | Statusbehaftete WebSocket-Verbindung (WSS) |

Implementierungsansatz auswählen

Bei der Integration mit der Live API müssen Sie einen der folgenden Implementierungsansätze auswählen:

- Server-zu-Server: Ihr Back-End stellt über WebSockets eine Verbindung zur Live API her. In der Regel sendet Ihr Client Streamdaten (Audio, Video, Text) an Ihren Server, der sie dann an die Live API weiterleitet.

- WebSockets

Jetzt starten

Wählen Sie die Anleitung aus, die zu Ihrer Entwicklungsumgebung passt:

GenAI SDK-Tutorial

Stellen Sie mit dem GenAI SDK eine Verbindung zur Gemini Live API her, um eine multimodale Echtzeitanwendung mit einem Python-Back-End zu erstellen.

WebSocket-Tutorial

Stellen Sie mit WebSockets eine Verbindung zur Gemini Live API her, um eine multimodale Echtzeitanwendung mit einem JavaScript-Front-End und ephemeren Tokens zu erstellen.

ADK-Tutorial

Erstellen Sie einen Agenten und verwenden Sie das Agent Development Kit (ADK) Streaming, um die Sprach- und Videokommunikation zu aktivieren.

Einbindung in Partnerlösungen

Um die Entwicklung von Audio- und Video-Apps in Echtzeit zu optimieren, können Sie eine Drittanbieterintegration verwenden, die die Gemini Live API über WebRTC oder WebSockets unterstützt.

LiveKit

Gemini Live API mit LiveKit-Agenten verwenden

Pipecat von Daily

Echtzeit-KI-Chatbot mit Gemini Live und Pipecat erstellen

Fishjam von Software Mansion

Live-Video- und -Audiostreaming-Anwendungen mit Fishjam erstellen

Vision Agents von Stream

KI-Anwendungen für Audio und Video in Echtzeit mit Vision Agents erstellen

Voximplant

Eingehende und ausgehende Anrufe mit Voximplant mit der Live API verbinden

Agora

Konversationelle KI-Anwendungen in Echtzeit mit Agora erstellen

Firebase AI SDK

Mit der Gemini Live API mit Firebase AI Logic beginnen