মডেল পৃষ্ঠা: CodeGemma

সম্পদ এবং প্রযুক্তিগত ডকুমেন্টেশন:

ব্যবহারের শর্তাবলী: শর্তাবলী

লেখক: গুগল

মডেল তথ্য

মডেল সারাংশ

বর্ণনা

CodeGemma হল হালকা ওজনের খোলা কোড মডেলের একটি পরিবার যা Gemma-এর উপরে নির্মিত। CodeGemma মডেল হল টেক্সট-টু-টেক্সট এবং টেক্সট-টু-কোড ডিকোডার-শুধুমাত্র মডেল এবং এটি 7 বিলিয়ন পূর্ব-প্রশিক্ষিত বৈকল্পিক হিসাবে উপলব্ধ যা কোড সমাপ্তি এবং কোড তৈরির কাজগুলিতে বিশেষজ্ঞ, কোড চ্যাট এবং নির্দেশের জন্য একটি 7 বিলিয়ন প্যারামিটার নির্দেশ-সুরিত রূপ। নিম্নলিখিত এবং দ্রুত কোড সমাপ্তির জন্য একটি 2 বিলিয়ন প্যারামিটার পূর্বপ্রশিক্ষিত বৈকল্পিক।

ইনপুট এবং আউটপুট

ইনপুট: পূর্বপ্রশিক্ষিত মডেল ভেরিয়েন্টের জন্য: কোড উপসর্গ এবং ঐচ্ছিকভাবে কোড সমাপ্তি এবং প্রজন্মের পরিস্থিতি বা প্রাকৃতিক ভাষা পাঠ্য/প্রম্পটের জন্য প্রত্যয়। নির্দেশ-সুরিত মডেল বৈকল্পিকের জন্য: প্রাকৃতিক ভাষা পাঠ্য বা প্রম্পট।

আউটপুট: পূর্বপ্রশিক্ষিত মডেল ভেরিয়েন্টের জন্য: ফিল-ইন-দ্য-মিডল কোড সমাপ্তি, কোড এবং প্রাকৃতিক ভাষা। নির্দেশ-সুরিত মডেল বৈকল্পিক জন্য: কোড এবং প্রাকৃতিক ভাষা.

উদ্ধৃতি

@article{codegemma_2024,

title={CodeGemma: Open Code Models Based on Gemma},

url={https://goo.gle/codegemma},

author={ {CodeGemma Team} and Hartman, Ale Jakse and Hu, Andrea and Choquette-Choo, Christopher A. and Zhao, Heri and Fine, Jane and Hui,

Jeffrey and Shen, Jingyue and Kelley, Joe and Howland, Joshua and Bansal, Kshitij and Vilnis, Luke and Wirth, Mateo and Nguyen, Nam, and Michel, Paul and Choy, Peter and Joshi, Pratik and Kumar, Ravin and Hashmi, Sarmad and Agrawal, Shubham and Zuo, Siqi and Warkentin, Tris and Gong, Zhitao et al.},

year={2024}

}

মডেল ডেটা

প্রশিক্ষণ ডেটাসেট

Gemma কে বেস মডেল হিসাবে ব্যবহার করে, CodeGemma 2B এবং 7B পূর্বপ্রশিক্ষিত ভেরিয়েন্টগুলিকে ওপেন সোর্স গণিত ডেটাসেট এবং কৃত্রিমভাবে তৈরি কোড থেকে প্রাথমিকভাবে ইংরেজি ভাষার ডেটার অতিরিক্ত 500 থেকে 1000 বিলিয়ন টোকেনে প্রশিক্ষণ দেওয়া হয়।

প্রশিক্ষণ তথ্য প্রক্রিয়াকরণ

কোডজেমা প্রশিক্ষণের জন্য নিম্নলিখিত ডেটা প্রাক-প্রক্রিয়াকরণ কৌশল প্রয়োগ করা হয়েছিল:

- এফআইএম - পূর্বপ্রশিক্ষিত কোডজেমা মডেলগুলি ফিল-ইন-দ্য-মিডল (এফআইএম) কাজগুলিতে ফোকাস করে। মডেলগুলি PSM এবং SPM উভয় মোডের সাথে কাজ করার জন্য প্রশিক্ষিত। আমাদের FIM সেটিংস 50-50 PSM/SPM সহ 80% থেকে 90% FIM হার।

- নির্ভরতা গ্রাফ-ভিত্তিক প্যাকিং এবং ইউনিট পরীক্ষা-ভিত্তিক আভিধানিক প্যাকিং কৌশল: বাস্তব-বিশ্বের অ্যাপ্লিকেশনগুলির সাথে মডেল সারিবদ্ধকরণ উন্নত করতে, আমরা প্রতিটি সংগ্রহস্থলের মধ্যে সবচেয়ে প্রাসঙ্গিক উত্স ফাইলগুলিকে সংযোজন করার জন্য প্রকল্প/রিপোজিটরি স্তরে প্রশিক্ষণ উদাহরণগুলি গঠন করেছি। বিশেষত, আমরা দুটি হিউরিস্টিক কৌশল নিযুক্ত করেছি: নির্ভরতা গ্রাফ-ভিত্তিক প্যাকিং এবং ইউনিট পরীক্ষা-ভিত্তিক আভিধানিক প্যাকিং।

- আমরা নথিগুলিকে উপসর্গ, মধ্যম এবং প্রত্যয়গুলিতে বিভক্ত করার জন্য একটি অভিনব কৌশল তৈরি করেছি যাতে প্রত্যয়টি সম্পূর্ণরূপে এলোমেলো বিতরণের পরিবর্তে আরও সিনট্যাক্টিকভাবে প্রাকৃতিক বিন্দুতে শুরু হয়।

- নিরাপত্তা: একইভাবে Gemma-এর মতো, আমরা আমাদের নীতির সাথে সামঞ্জস্যপূর্ণ বিষয়বস্তুর গুণমান এবং নিরাপত্তার উপর ভিত্তি করে ব্যক্তিগত ডেটা ফিল্টারিং, CSAM ফিল্টারিং এবং অন্যান্য ফিল্টারিং সহ কঠোর নিরাপত্তা ফিল্টারিং স্থাপন করেছি।

বাস্তবায়ন তথ্য

প্রশিক্ষণের সময় ব্যবহৃত হার্ডওয়্যার এবং ফ্রেমওয়ার্ক

জেমার মতো , কোডজেমাকে JAX এবং ML পাথওয়ে ব্যবহার করে টেনসর প্রসেসিং ইউনিট (TPU) হার্ডওয়্যার (TPUv5e) এর সর্বশেষ প্রজন্মের প্রশিক্ষণ দেওয়া হয়েছিল।

মূল্যায়ন তথ্য

বেঞ্চমার্ক ফলাফল

মূল্যায়ন পদ্ধতি

- কোড সমাপ্তির বেঞ্চমার্ক: হিউম্যান ইভাল (এইচই) (একক লাইন এবং একাধিক লাইন ইনফিলিং)

- কোড জেনারেশন বেঞ্চমার্ক: HumanEval, MBPP , BabelCode (BC) [C++, C#, Go, Java, JavaScript, Kotlin, Python, Rust]

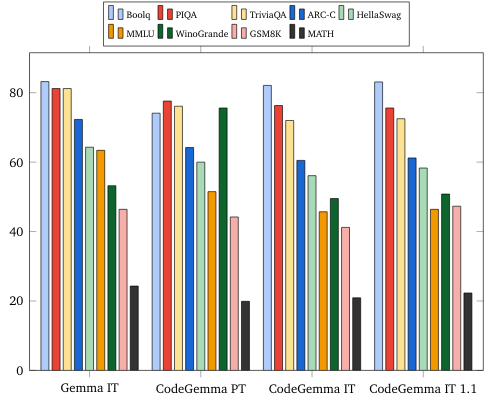

- প্রশ্নোত্তর: BoolQ , PIQA , TriviaQA৷

- প্রাকৃতিক ভাষা: ARC-চ্যালেঞ্জ , HellaSwag , MMLU , WinoGrande

- ম্যাথ রিজনিং: GSM8K , MATH

কোডিং বেঞ্চমার্ক ফলাফল

| বেঞ্চমার্ক | 2B | 2B (1.1) | 7B | 7B-IT | 7B-IT (1.1) |

|---|---|---|---|---|---|

| হিউম্যান ইভাল | 31.1 | 37.8 | 44.5 | 56.1 | ৬০.৪ |

| এমবিপিপি | 43.6 | 49.2 | 56.2 | 54.2 | 55.6 |

| হিউম্যান ইভাল একক লাইন | 78.4 | 79.3 | 76.1 | 68.3 | 77.4 |

| হিউম্যান ইভাল মাল্টি লাইন | 51.4 | 51.0 | 58.4 | 20.1 | 23.7 |

| BC HE C++ | 24.2 | 19.9 | 32.9 | 42.2 | 46.6 |

| BC HE C# | 10.6 | 26.1 | 22.4 | 26.7 | 54.7 |

| BC HE Go | 20.5 | 18.0 | 21.7 | 28.6 | 34.2 |

| বিসি এইচ জাভা | 29.2 | 29.8 | 41.0 | 48.4 | 50.3 |

| BC HE JavaScript | 21.7 | 28.0 | ৩৯.৮ | 46.0 | 48.4 |

| বিসি এইচই কোটলিন | 28.0 | 32.3 | ৩৯.৮ | 51.6 | 47.8 |

| BC HE পাইথন | 21.7 | 36.6 | 42.2 | 48.4 | 54.0 |

| BC HE মরিচা | 26.7 | 24.2 | 34.1 | 36.0 | 37.3 |

| BC MBPP C++ | 47.1 | 38.9 | 53.8 | 56.7 | 63.5 |

| BC MBPP C# | 28.7 | 45.3 | 32.5 | 41.2 | 62.0 |

| বিসি এমবিপিপি গো | 45.6 | 38.9 | 43.3 | 46.2 | 53.2 |

| বিসি এমবিপিপি জাভা | 41.8 | 49.7 | 50.3 | 57.3 | 62.9 |

| BC MBPP জাভাস্ক্রিপ্ট | 45.3 | 45.0 | 58.2 | 61.4 | 61.4 |

| বিসি এমবিপিপি কোটলিন | 46.8 | 49.7 | 54.7 | 59.9 | 62.6 |

| BC MBPP পাইথন | 38.6 | 52.9 | 59.1 | 62.0 | ৬০.২ |

| বিসি এমবিপিপি জং | 45.3 | 47.4 | 52.9 | 53.5 | 52.3 |

প্রাকৃতিক ভাষার মানদণ্ড (7B মডেলে)

নৈতিকতা এবং নিরাপত্তা

নৈতিকতা এবং নিরাপত্তা মূল্যায়ন

মূল্যায়ন পদ্ধতি

আমাদের মূল্যায়ন পদ্ধতির মধ্যে রয়েছে কাঠামোগত মূল্যায়ন এবং প্রাসঙ্গিক বিষয়বস্তুর নীতির অভ্যন্তরীণ রেড-টিমিং টেস্টিং। রেড-টিমিং বেশ কয়েকটি ভিন্ন দল দ্বারা পরিচালিত হয়েছিল, প্রতিটিরই ভিন্ন লক্ষ্য এবং মানবিক মূল্যায়ন মেট্রিক্স। এই মডেলগুলিকে নৈতিকতা এবং নিরাপত্তার সাথে প্রাসঙ্গিক বিভিন্ন বিভাগের বিরুদ্ধে মূল্যায়ন করা হয়েছিল, যার মধ্যে রয়েছে:

কন্টেন্ট নিরাপত্তা এবং প্রতিনিধিত্বমূলক ক্ষতি কভার প্রম্পট উপর মানুষের মূল্যায়ন. মূল্যায়ন পদ্ধতির আরো বিস্তারিত জানার জন্য জেমা মডেল কার্ডটি দেখুন।

সাইবার-অপরাধ ক্ষমতার সুনির্দিষ্ট পরীক্ষা, স্বায়ত্তশাসিত হ্যাকিং ক্ষমতা পরীক্ষা করার উপর ফোকাস করা এবং সম্ভাব্য ক্ষতি সীমিত নিশ্চিত করা।

মূল্যায়ন ফলাফল

নৈতিকতা এবং নিরাপত্তা মূল্যায়নের ফলাফলগুলি শিশু সুরক্ষা, বিষয়বস্তু সুরক্ষা, প্রতিনিধিত্বমূলক ক্ষতি, মুখস্থ করা, বড় আকারের ক্ষতির মতো বিভাগগুলির জন্য অভ্যন্তরীণ নীতিগুলি পূরণের জন্য গ্রহণযোগ্য থ্রেশহোল্ডের মধ্যে রয়েছে৷ আরও বিস্তারিত জানার জন্য জেমা মডেল কার্ড দেখুন।

মডেল ব্যবহার এবং সীমাবদ্ধতা

পরিচিত সীমাবদ্ধতা

লার্জ ল্যাঙ্গুয়েজ মডেলের (LLMs) তাদের প্রশিক্ষণের তথ্য এবং প্রযুক্তির অন্তর্নিহিত সীমাবদ্ধতার উপর ভিত্তি করে সীমাবদ্ধতা রয়েছে। এলএলএম-এর সীমাবদ্ধতা সম্পর্কে আরও বিশদ বিবরণের জন্য জেমা মডেল কার্ডটি দেখুন।

নৈতিক বিবেচনা এবং ঝুঁকি

বৃহৎ ভাষা মডেলের (LLMs) বিকাশ বেশ কিছু নৈতিক উদ্বেগ উত্থাপন করে। এই মডেলগুলির বিকাশে আমরা সাবধানে একাধিক দিক বিবেচনা করেছি।

মডেলের বিশদ বিবরণের জন্য অনুগ্রহ করে জেমা মডেল কার্ডে একই আলোচনা পড়ুন।

উদ্দেশ্য ব্যবহার

আবেদন

কোড জেমা মডেলের অ্যাপ্লিকেশনের বিস্তৃত পরিসর রয়েছে, যা IT এবং PT মডেলের মধ্যে পরিবর্তিত হয়। নিম্নলিখিত সম্ভাব্য ব্যবহারের তালিকা ব্যাপক নয়। এই তালিকার উদ্দেশ্য হল সম্ভাব্য ব্যবহারের ক্ষেত্রে প্রাসঙ্গিক তথ্য প্রদান করা যা মডেল নির্মাতারা মডেল প্রশিক্ষণ এবং বিকাশের অংশ হিসাবে বিবেচিত।

- কোড সমাপ্তি: PT মডেলগুলি একটি IDE এক্সটেনশনের সাথে কোড সম্পূর্ণ করতে ব্যবহার করা যেতে পারে

- কোড জেনারেশন: আইটি মডেল আইডিই এক্সটেনশন সহ বা ছাড়া কোড তৈরি করতে ব্যবহার করা যেতে পারে

- কোড কথোপকথন: আইটি মডেল কথোপকথন ইন্টারফেসগুলিকে শক্তি দিতে পারে যা কোড নিয়ে আলোচনা করে

- কোড শিক্ষা: আইটি মডেল ইন্টারেক্টিভ কোড শেখার অভিজ্ঞতা সমর্থন করে, সিনট্যাক্স সংশোধনে সহায়তা করে বা কোডিং অনুশীলন প্রদান করে

সুবিধা

প্রকাশের সময়, মডেলের এই পরিবারটি একই আকারের মডেলগুলির তুলনায় দায়ী এআই বিকাশের জন্য গ্রাউন্ড আপ থেকে ডিজাইন করা উচ্চ-কর্মক্ষমতা ওপেন কোড-কেন্দ্রিক বৃহৎ ভাষা মডেল বাস্তবায়ন প্রদান করে।

এই নথিতে বর্ণিত কোডিং বেঞ্চমার্ক মূল্যায়ন মেট্রিক্স ব্যবহার করে, এই মডেলগুলি অন্যান্য, তুলনামূলক আকারের খোলা মডেল বিকল্পগুলির থেকে উচ্চতর কর্মক্ষমতা প্রদান করতে দেখায়৷