La API de Live permite interacciones de voz y visión en tiempo real con baja latencia con Gemini. Procesa flujos continuos de audio, imágenes y texto para brindar respuestas habladas inmediatas y similares a las humanas, lo que crea una experiencia conversacional natural para tus usuarios.

Casos de uso

La API de Live se puede usar para compilar agentes de voz en tiempo real para una variedad de industrias, incluidas las siguientes:

- Comercio electrónico y venta minorista: Asistentes de compras que ofrecen recomendaciones personalizadas y agentes de asistencia que resuelven los problemas de los clientes.

- Juegos: Personajes controlados por la máquina (NPC) interactivos, asistentes de ayuda en el juego y traducción en tiempo real del contenido del juego

- Interfaces de nueva generación: Experiencias habilitadas para voz y video en robótica, anteojos inteligentes y vehículos

- Cuidado de la salud: Compañeros de salud para la asistencia y educación de los pacientes

- Servicios financieros: Asesores de IA para la administración de patrimonio y la orientación sobre inversiones

- Educación: Mentores y compañeros de aprendizaje basados en IA que brindan instrucción y comentarios personalizados.

- Traducción y localización: Traducción en tiempo real y de baja latencia de conversaciones habladas, lo que permite una comunicación multilingüe fluida.

Características clave

La API de Live ofrece un conjunto integral de funciones para crear agentes de voz sólidos:

- Compatibilidad con varios idiomas: Conversa en 70 idiomas compatibles.

- Interrupción: Los usuarios pueden interrumpir el modelo en cualquier momento para tener interacciones responsivas.

- Uso de herramientas: Integra herramientas como llamadas a funciones y la Búsqueda de Google para interacciones dinámicas.

- Transcripciones de audio: Proporciona transcripciones de texto de la entrada del usuario y el resultado del modelo.

- Audio proactivo: Te permite controlar cuándo responde el modelo y en qué contextos.

- Diálogo afectivo: Adapta el estilo y el tono de la respuesta para que coincidan con la expresión de entrada del usuario.

- Traducción instantánea: Traducción de voz a voz en tiempo real en más de 70 idiomas

Especificaciones técnicas

En la siguiente tabla, se describen las especificaciones técnicas de la API de Live:

| Categoría | Detalles |

|---|---|

| Modalidades de entrada | Audio (audio PCM sin procesar de 16 bits, 16 kHz, little-endian), imágenes (JPEG <= 1 FPS), texto |

| Modalidades de salida | Audio (audio PCM sin procesar de 16 bits, 24 kHz, little-endian) |

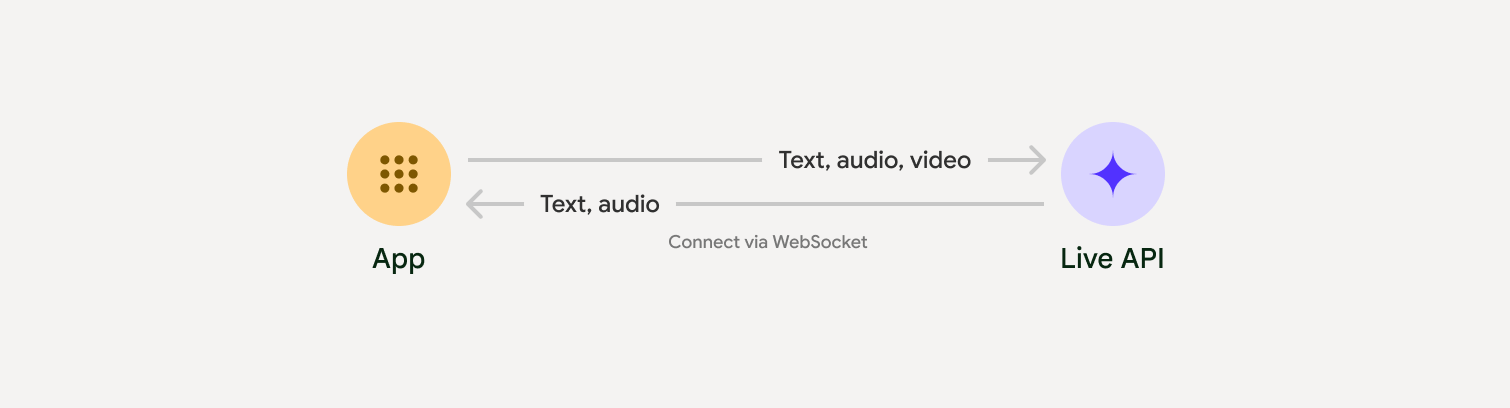

| Protocolo | Conexión de WebSocket con estado (WSS) |

Elige un enfoque de implementación

Cuando realices la integración con la API de Live, deberás elegir uno de los siguientes enfoques de implementación:

- Servidor a servidor: Tu backend se conecta a la API de Live con WebSockets. Por lo general, tu cliente envía datos de transmisión (audio, video, texto) a tu servidor, que luego los reenvía a la API de Live.

- Cliente a servidor: Tu código de frontend se conecta directamente a la API de Live con WebSockets para transmitir datos, lo que omite tu backend.

Comenzar

Selecciona la guía que coincida con tu entorno de desarrollo:

Instructivo del SDK de IA generativa

Conéctate a la API de Gemini Live con el SDK de GenAI para compilar una aplicación multimodal en tiempo real con un backend de Python.

Tutorial de WebSocket

Conéctate a la API de Gemini Live con WebSockets para crear una aplicación multimodal en tiempo real con un frontend de JavaScript y tokens efímeros.

Instructivo de ADK

Crea un agente y usa la transmisión del Kit de desarrollo de agentes (ADK) para habilitar la comunicación por voz y video.

Integraciones a socios

Para optimizar el desarrollo de apps de audio y video en tiempo real, puedes usar una integración de terceros que admita la API de Gemini Live a través de WebRTC o WebSockets.

LiveKit

Usa la API de Gemini Live con los agentes de LiveKit.

Pipecat de Daily

Crea un chatbot de IA en tiempo real con Gemini Live y Pipecat.

Fishjam de Software Mansion

Crea aplicaciones de transmisión de audio y video en vivo con Fishjam.

Agentes de Vision por transmisión

Crea aplicaciones de IA de voz y video en tiempo real con Vision Agents.

Voximplant

Conecta llamadas entrantes y salientes a la API de Live con Voximplant.

Agora

Crea aplicaciones de IA conversacional en tiempo real con Agora.

SDK de Firebase AI

Comienza a usar la API de Gemini Live con Firebase AI Logic.