API Live обеспечивает взаимодействие с Gemini в режиме реального времени с помощью голосовых и видеосвязей с низкой задержкой. Он обрабатывает непрерывные потоки аудио, изображений и текста, обеспечивая мгновенные, похожие на человеческие, голосовые ответы, создавая естественный диалог для ваших пользователей.

Варианты использования

Live API можно использовать для создания голосовых агентов, работающих в режиме реального времени, для различных отраслей, включая:

- Электронная коммерция и розничная торговля: Консультанты по покупкам, предлагающие персонализированные рекомендации, и агенты поддержки, решающие проблемы клиентов.

- Игры: интерактивные неигровые персонажи (NPC), внутриигровые помощники и перевод внутриигрового контента в реальном времени.

- Интерфейсы нового поколения: голосовые и видеоинтерфейсы в робототехнике, умных очках и транспортных средствах.

- Здравоохранение: Помощники в сфере здравоохранения для поддержки и обучения пациентов.

- Финансовые услуги: ИИ-консультанты для управления активами и предоставления инвестиционных рекомендаций.

- Образование: Искусственный интеллект в качестве наставника и помощника для учащихся, предоставляющий персонализированные инструкции и обратную связь.

Основные характеристики

Live API предлагает полный набор функций для создания надежных голосовых агентов:

- Многоязычная поддержка : общение на 70 языках.

- Вмешательство : Пользователи могут в любой момент прервать работу модели для осуществления ответных действий.

- Использование инструментов : Интегрирует такие инструменты, как вызов функций и поиск Google, для динамического взаимодействия.

- Аудиозаписи : Предоставляет текстовые расшифровки как пользовательского ввода, так и выходных данных модели.

- Проактивное аудио : позволяет контролировать, когда модель реагирует и в каких контекстах.

- Эмоциональный диалог : адаптирует стиль и тон ответа в соответствии с выражением мыслей пользователя.

Технические характеристики

В таблице ниже приведены технические характеристики Live API:

| Категория | Подробности |

|---|---|

| Входные модальности | Аудио (необработанный 16-битный PCM-аудио, 16 кГц, little-endian), изображения (JPEG <= 1 кадр/с), текст |

| Выходные модальности | Аудио (необработанный 16-битный PCM-аудио, 24 кГц, little-endian) |

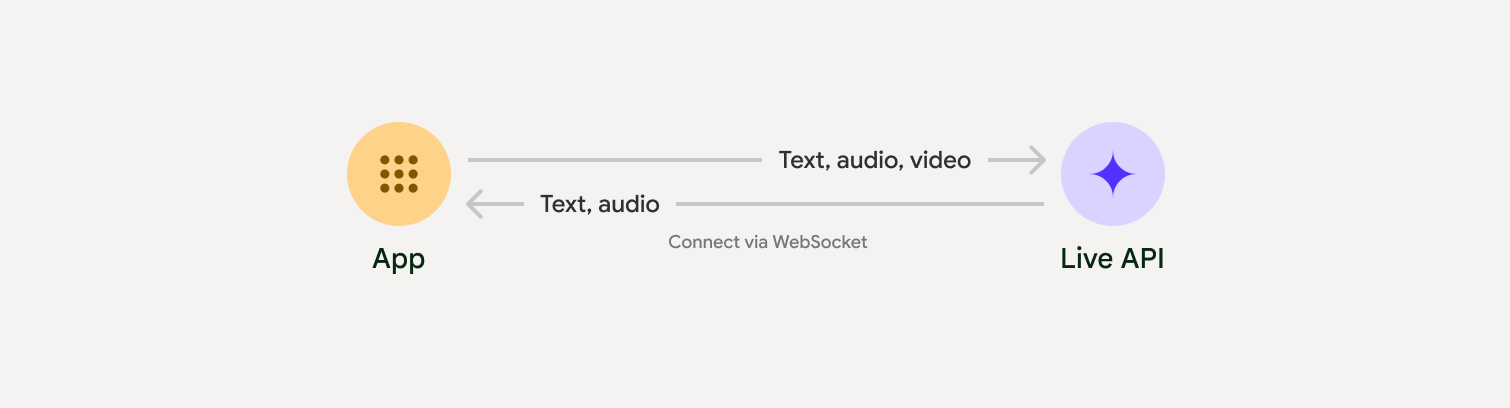

| Протокол | Соединение WebSocket с сохранением состояния (WSS) |

Выберите подход к реализации.

При интеграции с Live API вам потребуется выбрать один из следующих подходов к реализации:

- Подключение «сервер-сервер» : ваш бэкэнд подключается к Live API с помощью WebSockets . Как правило, ваш клиент отправляет потоковые данные (аудио, видео, текст) на ваш сервер, который затем перенаправляет их в Live API.

- Клиент-сервер : Ваш фронтенд-код подключается напрямую к Live API, используя WebSockets для потоковой передачи данных, минуя бэкенд.

Начать

Выберите руководство, соответствующее вашей среде разработки:

Учебное пособие по GenAI SDK

Подключитесь к API Gemini Live с помощью SDK GenAI, чтобы создать многомодальное приложение в реальном времени с бэкэндом на Python.

Учебное пособие по WebSocket

Подключитесь к API Gemini Live с помощью WebSockets, чтобы создать многомодальное приложение в реальном времени с JavaScript-интерфейсом и временными токенами.

Учебное пособие по ADK

Создайте агента и используйте потоковую передачу данных из комплекта разработки агентов (ADK), чтобы включить голосовую и видеосвязь.

Интеграция с партнерами

Для упрощения разработки приложений для обработки аудио и видео в реальном времени можно использовать интеграцию со сторонним сервисом, поддерживающим API Gemini Live по протоколам WebRTC или WebSockets.

Используйте API Gemini Live с агентами LiveKit.

Pipecat от DailyСоздайте чат-бота с искусственным интеллектом в режиме реального времени, используя Gemini Live и Pipecat.

Fishjam от Software MansionСоздавайте приложения для потоковой передачи видео и аудио в реальном времени с помощью Fishjam.

Vision Agents по потокуСоздавайте приложения искусственного интеллекта для обработки голоса и видео в реальном времени с помощью Vision Agents.

ВоксимплантС помощью Voximplant вы можете подключать входящие и исходящие вызовы к Live API.

АгораСоздавайте диалоговые приложения искусственного интеллекта в реальном времени с помощью Agora.

Firebase AI SDKНачните работу с API Gemini Live, используя Firebase AI Logic.