লাইভ এপিআই জেমিনির সাথে স্বল্প-বিলম্বের, রিয়েল-টাইম ভয়েস এবং ভিজ্যুয়াল ইন্টারঅ্যাকশন সক্ষম করে। এটি অডিও, ছবি এবং টেক্সটের অবিচ্ছিন্ন প্রবাহকে প্রক্রিয়াজাত করে তাৎক্ষণিক, মানুষের মতো কথ্য প্রতিক্রিয়া প্রদান করে, যা আপনার ব্যবহারকারীদের জন্য একটি স্বাভাবিক কথোপকথনের অভিজ্ঞতা তৈরি করে।

ব্যবহারের ক্ষেত্র

লাইভ এপিআই ব্যবহার করে বিভিন্ন শিল্পের জন্য রিয়েল-টাইম ভয়েস এজেন্ট তৈরি করা যেতে পারে, যার মধ্যে রয়েছে:

- ই-কমার্স ও খুচরা ব্যবসা: কেনাকাটার সহায়ক যারা ব্যক্তিগতকৃত সুপারিশ প্রদান করে এবং সাপোর্ট এজেন্ট যারা গ্রাহকের সমস্যা সমাধান করে।

- গেমিং: ইন্টারেক্টিভ নন-প্লেয়ার ক্যারেক্টার (NPC), ইন-গেম সাহায্যকারী, এবং ইন-গেম কন্টেন্টের রিয়েল-টাইম অনুবাদ।

- পরবর্তী প্রজন্মের ইন্টারফেস: রোবটিক্স, স্মার্ট গ্লাস এবং যানবাহনে ভয়েস ও ভিডিও-সক্ষম অভিজ্ঞতা।

- স্বাস্থ্যসেবা: রোগীর সহায়তা ও শিক্ষার জন্য স্বাস্থ্য সহযোগী।

- আর্থিক পরিষেবা: সম্পদ ব্যবস্থাপনা ও বিনিয়োগ নির্দেশনার জন্য এআই উপদেষ্টা।

- শিক্ষা: এআই মেন্টর এবং লার্নার কম্প্যানিয়ন, যারা ব্যক্তিগতকৃত নির্দেশনা ও ফিডব্যাক প্রদান করে।

মূল বৈশিষ্ট্য

শক্তিশালী ভয়েস এজেন্ট তৈরির জন্য লাইভ এপিআই একগুচ্ছ ব্যাপক বৈশিষ্ট্য প্রদান করে:

- বহুভাষিক সমর্থন : ৭০টি সমর্থিত ভাষায় কথোপকথন করুন।

- বার্জ-ইন : ব্যবহারকারীরা যেকোনো সময় মডেলটির সাথে তাৎক্ষণিক মিথস্ক্রিয়ার জন্য এটিকে বাধা দিতে পারেন।

- টুলের ব্যবহার : গতিশীল মিথস্ক্রিয়ার জন্য ফাংশন কলিং এবং গুগল সার্চের মতো টুল সমন্বিত করে।

- অডিও ট্রান্সক্রিপশন : ব্যবহারকারীর ইনপুট এবং মডেল আউটপুট উভয়েরই টেক্সট ট্রান্সক্রিপ্ট প্রদান করে।

- প্রোঅ্যাক্টিভ অডিও : এর মাধ্যমে আপনি নিয়ন্ত্রণ করতে পারবেন মডেলটি কখন এবং কোন পরিস্থিতিতে সাড়া দেবে।

- আবেগপূর্ণ সংলাপ : ব্যবহারকারীর দেওয়া অভিব্যক্তির সাথে সামঞ্জস্য রেখে প্রতিক্রিয়ার ধরণ ও সুর পরিবর্তন করে।

প্রযুক্তিগত বিবরণ

নিম্নলিখিত সারণিতে লাইভ এপিআই-এর প্রযুক্তিগত বিবরণ তুলে ধরা হলো:

| বিভাগ | বিস্তারিত |

|---|---|

| ইনপুট পদ্ধতি | অডিও (র 16-বিট PCM অডিও, 16kHz, লিটল-এন্ডিয়ান), ছবি (JPEG <= 1FPS), টেক্সট |

| আউটপুট পদ্ধতি | অডিও (র 16-বিট PCM অডিও, 24kHz, লিটল-এন্ডিয়ান) |

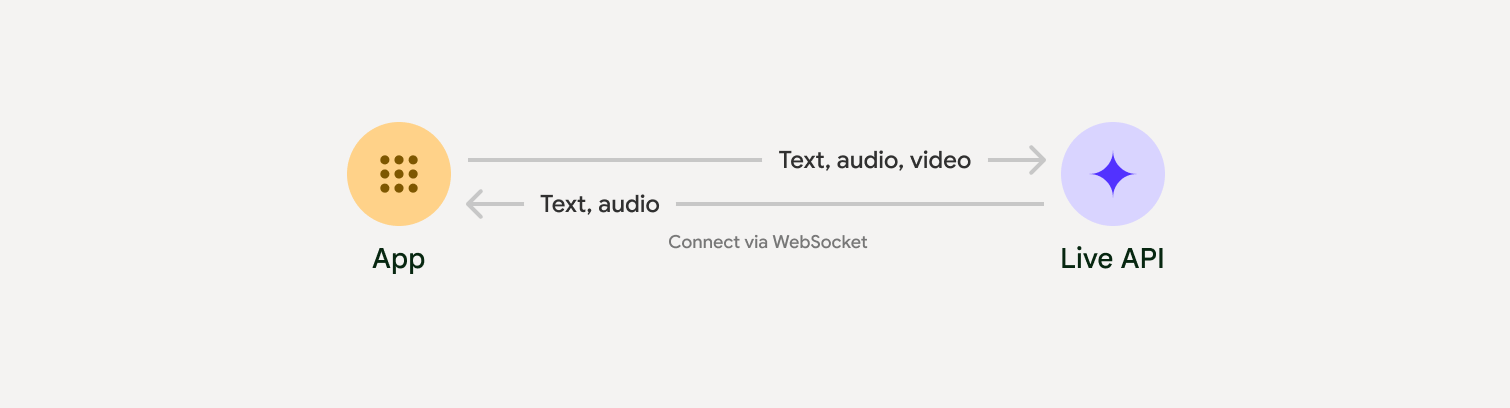

| প্রোটোকল | স্টেটফুল ওয়েবসকেট সংযোগ (WSS) |

একটি বাস্তবায়ন পদ্ধতি বেছে নিন

Live API-এর সাথে ইন্টিগ্রেট করার সময়, আপনাকে নিম্নলিখিত বাস্তবায়ন পদ্ধতিগুলোর মধ্যে একটি বেছে নিতে হবে:

- সার্ভার-টু-সার্ভার : আপনার ব্যাকএন্ড ওয়েবসকেট ব্যবহার করে লাইভ এপিআই-এর সাথে সংযুক্ত হয়। সাধারণত, আপনার ক্লায়েন্ট আপনার সার্ভারে স্ট্রিম ডেটা (অডিও, ভিডিও, টেক্সট) পাঠায়, যা পরে সেটিকে লাইভ এপিআই-তে ফরোয়ার্ড করে দেয়।

- ক্লায়েন্ট-টু-সার্ভার : আপনার ফ্রন্টএন্ড কোড আপনার ব্যাকএন্ডকে বাইপাস করে ওয়েবসকেট ব্যবহার করে সরাসরি লাইভ এপিআই-এর সাথে ডেটা স্ট্রিম করার জন্য সংযুক্ত হয়।

শুরু করুন

আপনার উন্নয়ন পরিবেশের সাথে মেলে এমন নির্দেশিকাটি নির্বাচন করুন:

GenAI SDK টিউটোরিয়াল

পাইথন ব্যাকএন্ডসহ একটি রিয়েল-টাইম মাল্টিমোডাল অ্যাপ্লিকেশন তৈরি করতে GenAI SDK ব্যবহার করে Gemini Live API-এর সাথে সংযোগ স্থাপন করুন।

ওয়েবসকেট টিউটোরিয়াল

জাভাস্ক্রিপ্ট ফ্রন্টএন্ড এবং ক্ষণস্থায়ী টোকেনসহ একটি রিয়েল-টাইম মাল্টিমোডাল অ্যাপ্লিকেশন তৈরি করতে ওয়েবসকেট ব্যবহার করে জেমিনি লাইভ এপিআই-এর সাথে সংযোগ স্থাপন করুন।

ADK টিউটোরিয়াল

একটি এজেন্ট তৈরি করুন এবং ভয়েস ও ভিডিও যোগাযোগ সক্ষম করতে এজেন্ট ডেভেলপমেন্ট কিট (ADK) স্ট্রিমিং ব্যবহার করুন।

অংশীদার ইন্টিগ্রেশন

রিয়েল-টাইম অডিও এবং ভিডিও অ্যাপের উন্নয়ন প্রক্রিয়াকে সহজ করতে, আপনি এমন একটি থার্ড-পার্টি ইন্টিগ্রেশন ব্যবহার করতে পারেন যা WebRTC বা WebSockets-এর মাধ্যমে Gemini Live API সমর্থন করে।

LiveKit এজেন্টদের সাথে Gemini Live API ব্যবহার করুন।

ডেইলির পাইপক্যাটGemini Live এবং Pipecat ব্যবহার করে একটি রিয়েল-টাইম এআই চ্যাটবট তৈরি করুন।

সফটওয়্যার ম্যানশনের ফিশজ্যামফিশজ্যাম দিয়ে লাইভ ভিডিও ও অডিও স্ট্রিমিং অ্যাপ্লিকেশন তৈরি করুন।

স্ট্রিম অনুসারে ভিশন এজেন্টভিশন এজেন্ট ব্যবহার করে রিয়েল-টাইম ভয়েস ও ভিডিও এআই অ্যাপ্লিকেশন তৈরি করুন।

ভক্সিমপ্ল্যান্টVoximplant-এর মাধ্যমে ইনবাউন্ড ও আউটবাউন্ড কলগুলোকে লাইভ এপিআই-এর সাথে সংযুক্ত করুন।

আগোরাAgora এর সাথে রিয়েল-টাইম কথোপকথনমূলক এআই অ্যাপ্লিকেশন তৈরি করুন।

ফায়ারবেস এআই এসডিকেFirebase AI Logic ব্যবহার করে Gemini Live API-এর সাথে কাজ শুরু করুন।