Google Colab में चलाएं Google Colab में चलाएं

|

GitHub पर सोर्स देखें GitHub पर सोर्स देखें

|

खास जानकारी

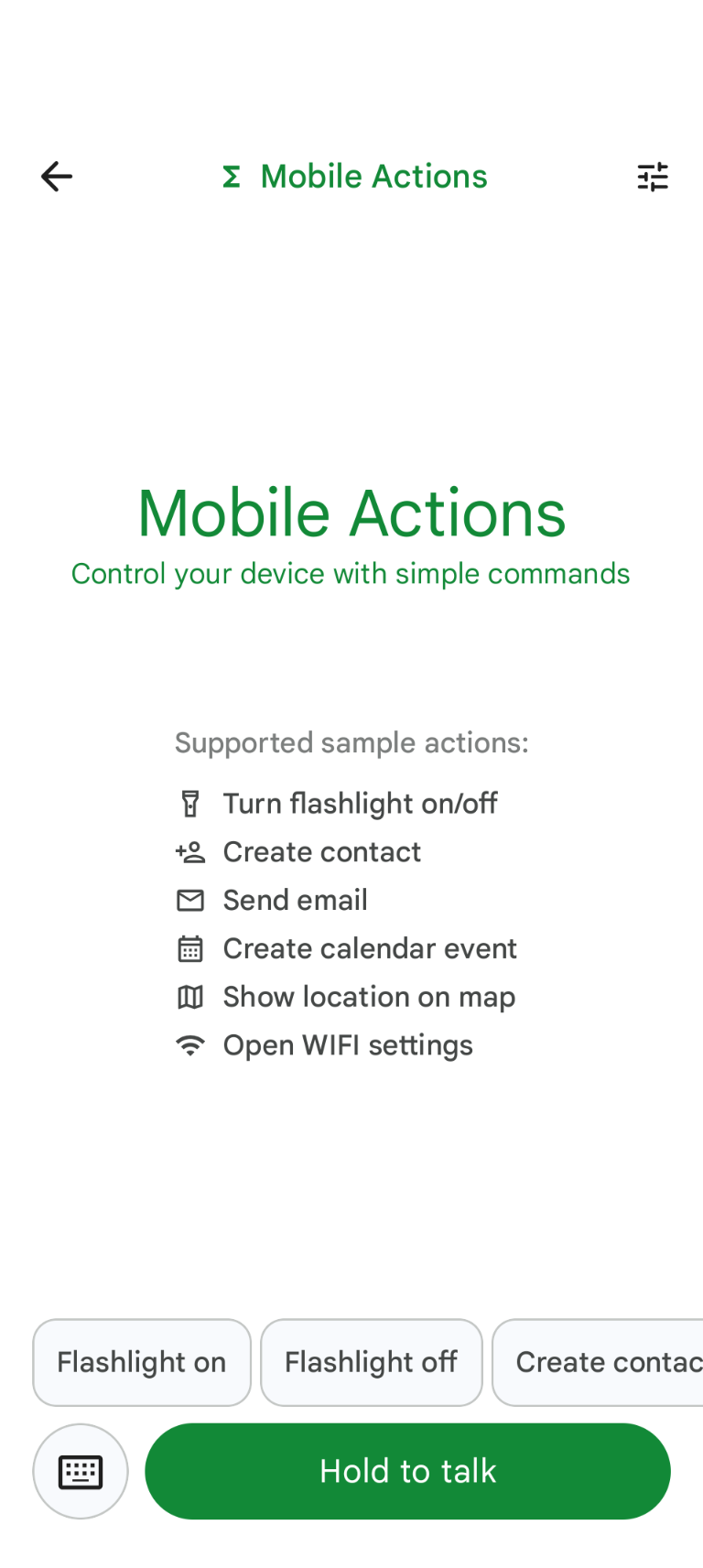

मोबाइल ऐक्शन एक डेमो ऐप्लिकेशन है. इसमें उपयोगकर्ता, बोलकर या लिखकर अपने डिवाइस पर कार्रवाइयां ट्रिगर कर सकते हैं. यह Assistant के साथ इंटरैक्शन करने की सुविधा को पूरी तरह से ऑफ़लाइन उपलब्ध कराता है. चाहे "कल दोपहर के खाने के लिए कैलेंडर इवेंट बनाओ", "जॉन को मेरे संपर्कों में जोड़ो" या "फ़्लैशलाइट चालू करो" हो, मॉडल नैचुरल लैंग्वेज को पार्स करता है और कमांड को पूरा करने के लिए सही ओएस टूल की पहचान करता है.

इस गाइड में, आपको इन कामों के बारे में जानकारी मिलेगी:

- मोबाइल ऐक्शन डेटासेट का इस्तेमाल करके, FunctionGemma 270M मॉडल को फ़ाइन-ट्यून करना

- Google AI Edge Gallery में, पसंद के मुताबिक बनाए गए मॉडल को डिप्लॉय करना

आपको मॉडल को फ़ाइन-ट्यून करने से लेकर डिवाइस पर डिप्लॉय करने तक की पूरी प्रोसेस के बारे में जानकारी मिलेगी.

पहला चरण: मोबाइल ऐक्शन के डेटासेट की मदद से, FunctionGemma को बेहतर बनाना

FunctionGemma, 27 करोड़ पैरामीटर वाला मॉडल है. यह Gemma 3 आर्किटेक्चर पर आधारित है. इसे खास तौर पर फ़ंक्शन कॉलिंग के लिए ट्रेन किया गया है. इससे यह आम बोलचाल की भाषा में किए गए अनुरोधों को फ़ंक्शन कॉल में बदल सकता है.

यह मॉडल छोटा है और मोबाइल फ़ोन पर आसानी से काम कर सकता है. हालांकि, इस साइज़ के मॉडल के लिए, इसे खास तौर पर किसी टास्क के लिए तैयार करने के लिए फ़ाइन-ट्यूनिंग की ज़रूरत होती है.

FunctionGemma को बेहतर बनाने के लिए, हम मोबाइल ऐक्शन के डेटासेट का इस्तेमाल करते हैं. यह डेटासेट, Hugging Face पर सार्वजनिक तौर पर उपलब्ध है. इस डेटासेट की हर एंट्री में यह जानकारी होती है:

- टूल (फ़ंक्शन) का वह सेट जिसका इस्तेमाल मॉडल कर सकता है:

- इससे फ़्लैशलाइट चालू होती है

- इससे फ़्लैशलाइट बंद हो जाती है

- यह फ़ोन की संपर्क सूची में संपर्क बनाता है

- ईमेल भेजता है

- मैप पर कोई जगह दिखाता है

- इससे वाई-फ़ाई की सेटिंग खुलती हैं

- यह एक नया कैलेंडर इवेंट बनाता है

- सिस्टम प्रॉम्प्ट, जिसमें कॉन्टेक्स्ट दिया गया हो. जैसे, मौजूदा तारीख और समय

- उपयोगकर्ता का प्रॉम्प्ट, जैसे कि

turn on the flashlight. - मॉडल से मिलने वाला अनुमानित जवाब. इसमें फ़ंक्शन कॉल भी शामिल हैं.

'मैप दिखाएं' फ़ंक्शन ऐसा दिखता है:

{

"function": {

"name": "show_map",

"description": "Shows a location on the map.",

"parameters": {

"type": "OBJECT",

"properties": {

"query": {

"type": "STRING",

"description": "The location to search for. May be the name of a place, a business, or an address."

}

},

"required": [

"query"

]

}

}

}

Colab नोटबुक में सभी ज़रूरी चरण शामिल हैं. जैसे:

- एनवायरमेंट सेट अप करना

- मोबाइल ऐक्शन डेटासेट को लोड करना और प्रीप्रोसेस करना

- Hugging Face TRL का इस्तेमाल करके मॉडल को फ़ाइन-ट्यून करना

- मॉडल को डिप्लॉय करने के लिए,

.litertlmफ़ॉर्मैट में बदलना

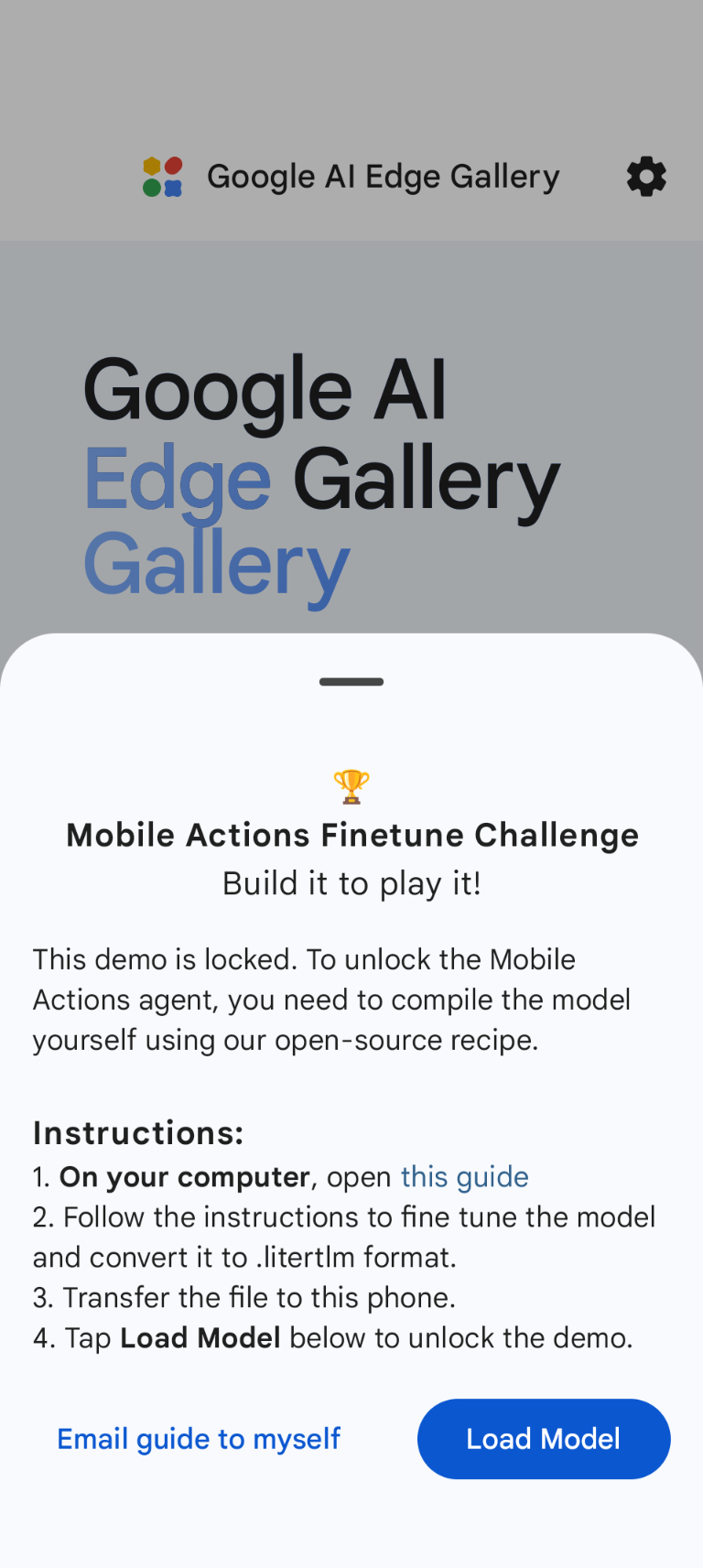

दूसरा चरण: Google AI Edge Gallery पर डिप्लॉय करना

ज़रूरी शर्त: आपके पास वही Google खाता होना चाहिए जिसका इस्तेमाल आपने पहले चरण में .litertlm फ़ाइल को सेव करने के लिए किया था. साथ ही, आपको अपने Android फ़ोन पर उसी खाते से साइन इन करना होगा.

फ़ाइन-ट्यूनिंग के बाद, हम मॉडल के वेट को .litertlm फ़ॉर्मैट में बदलते हैं और क्वांटाइज़ करते हैं.

मॉडल को Google AI Edge Gallery - Mobile Actions विकल्प में डिप्लॉय किया जा सकता है. इसके लिए, Load Model को चुनें और उसे Google Drive से चुनें. इसके अलावा, मॉडल को डिप्लॉय करने के लिए कोई दूसरा तरीका भी इस्तेमाल किया जा सकता है. Google AI Edge Gallery, Google Play Store पर उपलब्ध है.

अब, ऐप्लिकेशन में बोलकर निर्देश दिया जा सकता है या टाइप करके देखा जा सकता है कि फ़ाइन-ट्यून किया गया नया मॉडल, उपलब्ध फ़ंक्शन को कितनी अच्छी तरह से कॉल करता है.

अगले चरण

बधाई हो! अब आपको Hugging Face की मदद से मॉडल को बेहतर बनाने और LiteRT-LM की मदद से उसे डिवाइस पर डिप्लॉय करने का तरीका पता चल गया है.