Guia para desenvolvedores do Gemini 3

O Gemini 3 é nossa família de modelos mais inteligente até o momento, criada com base em um raciocínio de última geração. Ele foi projetado para dar vida a qualquer ideia, dominando fluxos de trabalho agênticos, programação autônoma e tarefas multimodais complexas. Este guia aborda os principais recursos da família de modelos Gemini 3 e como aproveitar ao máximo.

Conheça nossa coleção de apps do Gemini 3 para saber como o modelo lida com raciocínio avançado, programação autônoma e tarefas multimodais complexas.

Comece com algumas linhas de código:

Python

# This will only work for SDK newer than 2.0.0

from google import genai

client = genai.Client()

interaction = client.interactions.create(

model="gemini-3.1-pro-preview",

input="Find the race condition in this multi-threaded C++ snippet: [code here]",

)

print(interaction.steps[-1].content[0].text)

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI } from "@google/genai";

const client = new GoogleGenAI({});

async function run() {

const interaction = await client.interactions.create({

model: "gemini-3.1-pro-preview",

input: "Find the race condition in this multi-threaded C++ snippet: [code here]",

});

console.log(interaction.steps.at(-1).content[0].text);

}

run();

REST

# Specifies the API revision to avoid breaking changes when they become default

curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-H "Api-Revision: 2026-05-20" \

-d '{

"model": "gemini-3.1-pro-preview",

"input": "Find the race condition in this multi-threaded C++ snippet: [code here]"

}'

Conheça a série Gemini 3

O Gemini 3.1 Pro é ideal para tarefas complexas que exigem amplo conhecimento geral e raciocínio avançado em várias modalidades.

O Gemini 3 Flash é nosso modelo mais recente da série 3, com inteligência de nível Pro na velocidade e nos preços do Flash.

O Nano Banana Pro (também conhecido como Gemini 3 Pro Image) é nosso modelo de geração de imagens de mais alta qualidade, e o Nano Banana 2 (também conhecido como Gemini 3.1 Flash Image) é o equivalente de alto volume, alta eficiência e menor preço.

O Gemini 3.1 Flash-Lite é nosso modelo carro-chefe criado para eficiência de custo e tarefas de alto volume.

Todos os modelos do Gemini 3 estão em pré-lançamento.

| ID do modelo | Janela de contexto (entrada / saída) | Limite de conhecimento | Preços (entrada / saída)* |

|---|---|---|---|

| gemini-3.1-flash-lite-preview | 1M / 64k | Jan 2025 | US$ 0,25 (texto, imagem, vídeo), US$ 0,50 (áudio) / US$ 1,50 |

| gemini-3.1-flash-image-preview | 128k / 32k | Jan 2025 | US$ 0,25 (entrada de texto) / US$ 0,067 (saída de imagem)** |

| gemini-3.1-pro-preview | 1M / 64k | Jan 2025 | US$ 2 / US$ 12 (<200 mil tokens) US $4 / US$ 18 (>200 mil tokens) |

| gemini-3-flash-preview | 1M / 64k | Jan 2025 | US$ 0,50 / US$ 3 |

| gemini-3-pro-image-preview | 65 mil / 32 mil | Jan 2025 | US$ 2 (entrada de texto) / US$ 0,134 (saída de imagem)** |

* Os preços são por 1 milhão de tokens, a menos que indicado de outra forma. ** O preço das imagens varia de acordo com a resolução. Consulte a página de preços para mais detalhes.

Para limites detalhados, preços e mais informações, consulte a página de modelos.

Novos recursos da API no Gemini 3

O Gemini 3 apresenta novos parâmetros projetados para dar aos desenvolvedores mais controle sobre latência, custo e fidelidade multimodal.

Nível de raciocínio

Por padrão, os modelos da série Gemini 3 usam o raciocínio dinâmico para analisar comandos. Use o parâmetro thinking_level, que controla a profundidade máxima do processo de raciocínio interno do modelo antes de gerar uma resposta. O Gemini 3 trata esses níveis como permissões relativas para pensar, e não como garantias estritas de token.

Se thinking_level não for especificado, o Gemini 3 vai usar high como padrão. Para respostas mais rápidas e com menor latência quando não é necessário um raciocínio complexo, você pode restringir o nível de pensamento do modelo a low.

| Nível de raciocínio | Gemini 3.1 Pro | Gemini 3.1 Flash-Lite | Gemini 3 Flash | Descrição |

|---|---|---|---|---|

minimal |

incompatível | Compatível (padrão) | Compatível | Corresponde à configuração "sem pensar" para a maioria das consultas. O modelo pode pensar muito pouco para tarefas de programação complexas. Minimiza a latência para aplicativos de chat ou de alta capacidade de processamento. Observação, minimal não garante que o raciocínio esteja desativado. |

low |

Compatível | Compatível | Compatível | Minimiza a latência e o custo. Ideal para seguir instruções simples, conversar ou aplicativos de alta capacidade de processamento. |

medium |

Compatível | Compatível | Compatível | Pensamento equilibrado para a maioria das tarefas. |

high |

Compatível (padrão, dinâmico) | Compatível (dinâmico) | Compatível (padrão, dinâmico) | Maximiza a profundidade do raciocínio. O modelo pode levar muito mais tempo para chegar a um primeiro token de saída (sem pensar), mas a saída será mais bem fundamentada. |

Python

# This will only work for SDK newer than 2.0.0

from google import genai

client = genai.Client()

interaction = client.interactions.create(

model="gemini-3.1-pro-preview",

input="How does AI work?",

generation_config={"thinking_level": "low"},

)

print(interaction.steps[-1].content[0].text)

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI } from "@google/genai";

const client = new GoogleGenAI({});

const interaction = await client.interactions.create({

model: "gemini-3.1-pro-preview",

input: "How does AI work?",

generation_config: {

thinking_level: "low",

},

});

console.log(interaction.steps.at(-1).content[0].text);

REST

# Specifies the API revision to avoid breaking changes when they become default

curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-H "Api-Revision: 2026-05-20" \

-d '{

"model": "gemini-3.1-pro-preview",

"input": "How does AI work?",

"generation_config": {

"thinking_level": "low"

}

}'

Temperatura

Para todos os modelos do Gemini 3, recomendamos manter o parâmetro de temperatura no valor padrão de 1.0.

Embora os modelos anteriores se beneficiassem da temperatura de ajuste para controlar a criatividade versus o determinismo, as capacidades de raciocínio do Gemini 3 são otimizadas para a configuração padrão. Mudar a temperatura (definindo-a abaixo de 1,0) pode levar a um comportamento inesperado, como loops ou desempenho degradado, principalmente em tarefas matemáticas ou de raciocínio complexas.

Assinaturas de raciocínio

Os modelos do Gemini 3 usam assinaturas de pensamento para manter o contexto de raciocínio em todas as chamadas de API. Essas assinaturas são representações criptografadas do processo de raciocínio interno do modelo.

- Modo com estado (recomendado): ao usar a API Interactions no modo com estado (fornecendo

previous_interaction_id), o servidor gerencia automaticamente o histórico de conversas e as assinaturas de pensamento. - Modo sem estado: se você estiver gerenciando o histórico de conversas manualmente, inclua blocos de pensamento com as assinaturas deles em solicitações subsequentes para validar a autenticidade.

Para informações detalhadas, consulte a página Assinaturas de pensamento.

Respostas estruturadas com ferramentas

Os modelos do Gemini 3 permitem combinar saídas estruturadas com ferramentas integradas, incluindo embasamento com a Pesquisa Google, contexto de URL, execução de código e chamada de função.

Python

# This will only work for SDK newer than 2.0.0

from google import genai

from pydantic import BaseModel, Field

from typing import List

class MatchResult(BaseModel):

winner: str = Field(description="The name of the winner.")

final_match_score: str = Field(description="The final match score.")

scorers: List[str] = Field(description="The name of the scorer.")

client = genai.Client()

interaction = client.interactions.create(

model="gemini-3.1-pro-preview",

input="Search for all details for the latest Euro.",

tools=[

{"type": "google_search"},

{"type": "url_context"}

],

response_format={

"type": "text",

"mime_type": "application/json",

"schema": MatchResult.model_json_schema()

},

)

result = MatchResult.model_validate_json(interaction.steps[-1].content[0].text)

print(result)

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI } from "@google/genai";

import * as z from "zod";

const matchJsonSchema = {

type: "object",

properties: {

winner: { type: "string", description: "The name of the winner." },

final_match_score: { type: "string", description: "The final score." },

scorers: {

type: "array",

items: { type: "string" },

description: "The name of the scorer."

}

},

required: ["winner", "final_match_score", "scorers"]

};

const matchSchema = z.fromJSONSchema(matchJsonSchema);

const client = new GoogleGenAI({});

async function run() {

const interaction = await client.interactions.create({

model: "gemini-3.1-pro-preview",

input: "Search for all details for the latest Euro.",

tools: [

{ type: "google_search" },

{ type: "url_context" }

],

response_format: {

type: "text",

mime_type: "application/json",

schema: matchJsonSchema

},

});

const match = matchSchema.parse(JSON.parse(interaction.steps.at(-1).content[0].text));

console.log(match);

}

run();

REST

# Specifies the API revision to avoid breaking changes when they become default

curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-H "Api-Revision: 2026-05-20" \

-d '{

"model": "gemini-3.1-pro-preview",

"input": "Search for all details for the latest Euro.",

"tools": [

{"type": "google_search"},

{"type": "url_context"}

],

"response_format": {

"type": "text",

"mime_type": "application/json",

"schema": {

"type": "object",

"properties": {

"winner": {"type": "string", "description": "The name of the winner."},

"final_match_score": {"type": "string", "description": "The final score."},

"scorers": {

"type": "array",

"items": {"type": "string"},

"description": "The name of the scorer."

}

},

"required": ["winner", "final_match_score", "scorers"]

}

}

}'

Geração de imagens

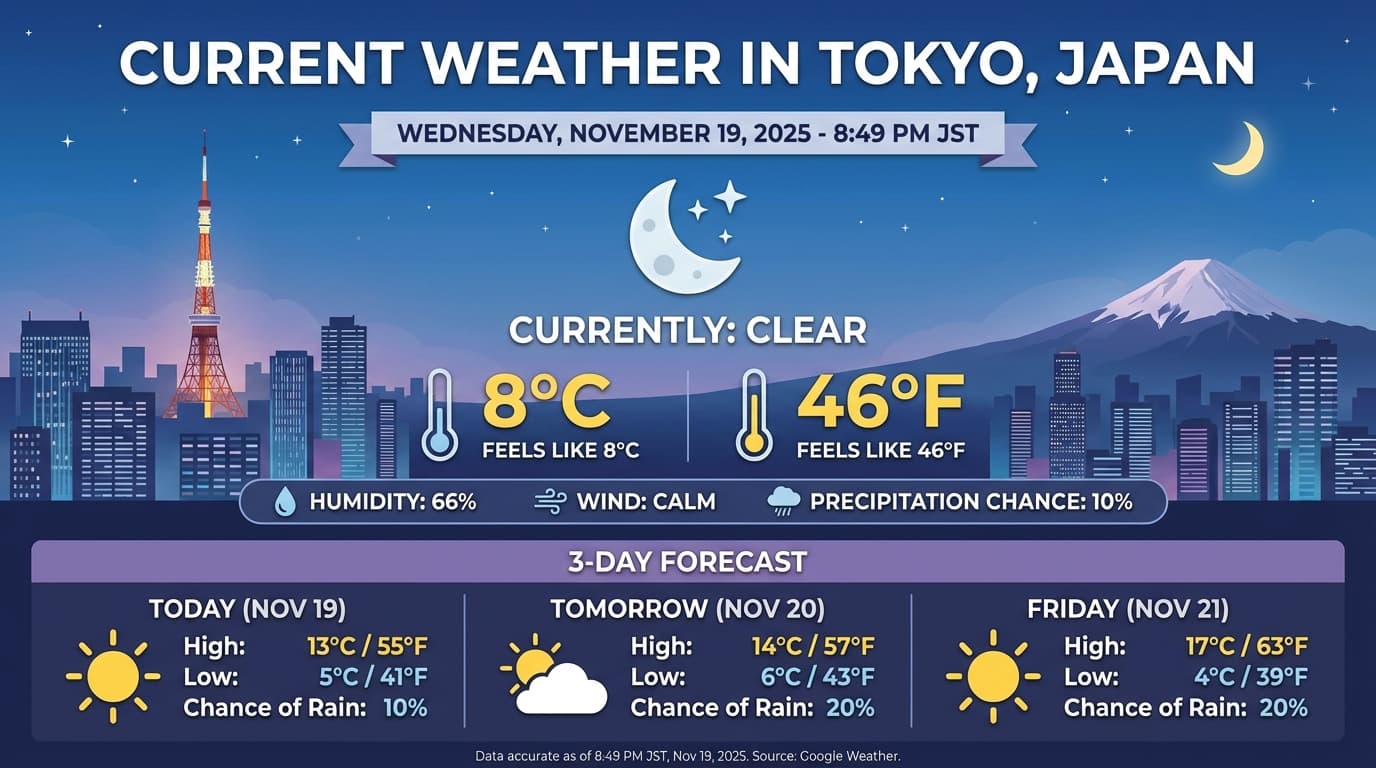

Com o Gemini 3.1 Flash Image e o Gemini 3 Pro Image, você pode gerar e editar imagens com comandos de texto. Ele usa o raciocínio para "pensar" em um comando e pode recuperar dados em tempo real, como previsões do tempo ou gráficos de ações, antes de usar a fundamentação da Pesquisa Google para gerar imagens de alta fidelidade.

Novos recursos e melhorias:

- Renderização de texto e 4K:gere textos e diagramas nítidos e legíveis com resoluções de até 2K e 4K.

- Geração embasada:use a ferramenta

google_searchpara verificar fatos e gerar imagens com base em informações do mundo real. O embasamento com a Pesquisa de Imagens do Google está disponível para o Gemini 3.1 Flash Image. - Edição conversacional:edite imagens em várias etapas apenas pedindo mudanças (por exemplo, "Mude o plano de fundo para um pôr do sol"). Esse fluxo de trabalho usa assinaturas de pensamento para preservar o contexto visual entre as interações.

Para detalhes completos sobre proporções, fluxos de trabalho de edição e opções de configuração, consulte o guia de geração de imagens.

Python

# This will only work for SDK newer than 2.0.0

from google import genai

import base64

client = genai.Client()

interaction = client.interactions.create(

model="gemini-3-pro-image-preview",

input="Generate an infographic of the current weather in Tokyo.",

tools=[{"type": "google_search"}],

response_format={

"type": "image",

"aspect_ratio": "16:9",

"image_size": "4K"

}

)

from PIL import Image

import io

image_blocks = [content_block for content_block in interaction.steps[-1].content if content_block.type == "image"]

if image_blocks:

image_data = base64.b64decode(image_blocks[0].data)

image = Image.open(io.BytesIO(image_data))

image.save('weather_tokyo.png')

image.show()

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI } from "@google/genai";

import * as fs from "node:fs";

const client = new GoogleGenAI({});

async function run() {

const interaction = await client.interactions.create({

model: "gemini-3-pro-image-preview",

input: "Generate a visualization of the current weather in Tokyo.",

tools: [{ type: "google_search" }],

response_format: {

type: "image",

aspect_ratio: "16:9",

image_size: "4K"

}

});

for (const contentBlock of interaction.steps.at(-1).content) {

if (contentBlock.type === "image") {

const buffer = Buffer.from(contentBlock.data, "base64");

fs.writeFileSync("weather_tokyo.png", buffer);

}

}

}

run();

REST

# Specifies the API revision to avoid breaking changes when they become default

curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-H "Api-Revision: 2026-05-20" \

-d '{

"model": "gemini-3-pro-image-preview",

"input": "Generate a visualization of the current weather in Tokyo.",

"tools": [{"type": "google_search"}],

"response_format": {

"type": "image",

"aspect_ratio": "16:9",

"image_size": "4K"

}

}'

Exemplo de resposta

Execução de código com imagens

O Gemini 3 Flash pode tratar a visão como uma investigação ativa, não apenas um olhar estático. Ao combinar o raciocínio com a execução de código, o modelo formula um plano, escreve e executa código Python para ampliar, cortar, anotar ou manipular imagens etapa por etapa para fundamentar visualmente as respostas.

Casos de uso:

- Zoom e inspeção:o modelo detecta implicitamente quando os detalhes estão muito pequenos (por exemplo, ao ler um medidor ou número de série distante) e escreve código para cortar e reexaminar a área em uma resolução mais alta.

- Matemática e criação de gráficos visuais:o modelo pode executar cálculos em várias etapas usando código (por exemplo, somar itens em um recibo ou gerar um gráfico do Matplotlib com base em dados extraídos).

- Anotação de imagem:o modelo pode desenhar setas, caixas delimitadoras ou outras anotações diretamente nas imagens para responder a perguntas espaciais, como "Onde este item deve ficar?".

Para ativar o pensamento visual, configure a Execução de código como uma ferramenta. O modelo vai usar automaticamente o código para manipular imagens quando necessário.

Python

# This will only work for SDK newer than 2.0.0

from google import genai

from google.genai import types

import requests

from PIL import Image

import io

import base64

image_path = "https://goo.gle/instrument-img"

image_bytes = requests.get(image_path).content

image = types.Part.from_bytes(data=image_bytes, mime_type="image/jpeg")

client = genai.Client()

interaction = client.interactions.create(

model="gemini-3-flash-preview",

input=[

image,

"Zoom into the expression pedals and tell me how many pedals are there?"

],

tools=[{"type": "code_execution"}],

)

from IPython.display import display

from PIL import Image

import io

for step in interaction.steps:

if step.type == "model_output":

for content_block in step.content:

if content_block.type == "text":

print(content_block.text)

elif content_block.type == "image":

display(Image.open(io.BytesIO(base64.b64decode(content_block.data))))

elif step.type == "code_execution_call":

print(step.code)

elif step.type == "code_execution_result":

print(step.output)

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI } from "@google/genai";

const client = new GoogleGenAI({});

async function main() {

const imageUrl = "https://goo.gle/instrument-img";

const response = await fetch(imageUrl);

const imageArrayBuffer = await response.arrayBuffer();

const base64ImageData = Buffer.from(imageArrayBuffer).toString("base64");

const interaction = await client.interactions.create({

model: "gemini-3-flash-preview",

input: [

{

type: "image",

mime_type: "image/jpeg",

data: base64ImageData,

},

{

type: "text",

text: "Zoom into the expression pedals and tell me how many pedals are there?",

},

],

tools: [{ type: "code_execution" }],

});

for (const step of interaction.steps) {

if (step.type === "model_output") {

for (const contentBlock of step.content) {

if (contentBlock.type === "text") {

console.log("Text:", contentBlock.text);

}

}

} else if (step.type === "code_execution_call") {

console.log("Code:", step.code);

} else if (step.type === "code_execution_result") {

console.log("Output:", step.output);

}

}

}

main();

REST

IMG_URL="https://goo.gle/instrument-img"

MODEL="gemini-3-flash-preview"

MIME_TYPE=$(curl -sIL "$IMG_URL" | grep -i '^content-type:' | awk -F ': ' '{print $2}' | sed 's/\r$//' | head -n 1)

if [[ -z "$MIME_TYPE" || ! "$MIME_TYPE" == image/* ]]; then

MIME_TYPE="image/jpeg"

fi

if [[ "$(uname)" == "Darwin" ]]; then

IMAGE_B64=$(curl -sL "$IMG_URL" | base64 -b 0)

elif [[ "$(base64 --version 2>&1)" = *"FreeBSD"* ]]; then

IMAGE_B64=$(curl -sL "$IMG_URL" | base64)

else

IMAGE_B64=$(curl -sL "$IMG_URL" | base64 -w0)

fi

# Specifies the API revision to avoid breaking changes when they become default

curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-H "Api-Revision: 2026-05-20" \

-d '{

"model": "'$MODEL'",

"input": [

{

"type": "image",

"mime_type":"'"$MIME_TYPE"'",

"data": "'"$IMAGE_B64"'"

},

{"type": "text", "text": "Zoom into the expression pedals and tell me how many pedals are there?"}

],

"tools": [{"type": "code_execution"}]

}'

Para mais detalhes sobre a execução de código com imagens, consulte Execução de código.

Respostas de função multimodal

A chamada de função multimodal permite que os usuários tenham respostas de função que contenham objetos multimodais, melhorando a utilização dos recursos de chamada de função do modelo. A chamada de função padrão é compatível apenas com respostas de função baseadas em texto:

Python

# This will only work for SDK newer than 2.0.0

from google import genai

import requests

import base64

client = genai.Client()

# 1. Define the tool

get_image_tool = {

"type": "function",

"name": "get_image",

"description": "Retrieves the image file reference for a specific order item.",

"parameters": {

"type": "object",

"properties": {

"item_name": {

"type": "string",

"description": "The name or description of the item ordered (e.g., 'instrument')."

}

},

"required": ["item_name"],

},

}

# 2. Send the request with tools

interaction_1 = client.interactions.create(

model="gemini-3-flash-preview",

input="Show me the instrument I ordered last month.",

tools=[get_image_tool],

)

# 3. Find the function call step

fc_step = next(s for s in interaction_1.steps if s.type == "function_call")

print(f"Tool Call: {fc_step.name}({fc_step.arguments})")

# Execute tool (fetch image)

image_path = "https://goo.gle/instrument-img"

image_bytes = requests.get(image_path).content

image_b64 = base64.b64encode(image_bytes).decode("utf-8")

# 4. Send multimodal function result back

interaction_2 = client.interactions.create(

model="gemini-3-flash-preview",

previous_interaction_id=interaction_1.id,

input=[{

"type": "function_result",

"name": fc_step.name,

"call_id": fc_step.id,

"result": [

{"type": "text", "text": "instrument.jpg"},

{

"type": "image",

"mime_type": "image/jpeg",

"data": image_b64,

}

]

}],

tools=[get_image_tool]

)

model_output_step = next(s for s in interaction_2.steps if s.type == "model_output")

print(f"\nFinal model response: {model_output_step.content[0].text}")

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI } from '@google/genai';

const client = new GoogleGenAI({});

// 1. Define the tool

const getImageTool = {

type: 'function',

name: 'get_image',

description: 'Retrieves the image file reference for a specific order item.',

parameters: {

type: 'object',

properties: {

item_name: {

type: 'string',

description: "The name or description of the item ordered (e.g., 'instrument').",

},

},

required: ['item_name'],

},

};

// 2. Send the request with tools

const interaction1 = await client.interactions.create({

model: 'gemini-3-flash-preview',

input: 'Use the get_image tool to show me the instrument I ordered last month.',

tools: [getImageTool],

});

// 3. Find the function call step

const fcStep = interaction1.steps.find(s => s.type === 'function_call');

console.log(`Tool Call: ${fcStep.name}(${JSON.stringify(fcStep.arguments)})`);

// Execute tool (fetch image)

const imageUrl = 'https://goo.gle/instrument-img';

const response = await fetch(imageUrl);

const imageArrayBuffer = await response.arrayBuffer();

const base64ImageData = Buffer.from(imageArrayBuffer).toString('base64');

// 4. Send multimodal function result back

const interaction2 = await client.interactions.create({

model: 'gemini-3-flash-preview',

previous_interaction_id: interaction1.id,

input: [{

type: 'function_result',

name: fcStep.name,

call_id: fcStep.id,

result: [

{ type: 'text', text: 'instrument.jpg' },

{

type: 'image',

mime_type: 'image/jpeg',

data: base64ImageData,

}

]

}],

tools: [getImageTool]

});

console.log(`\nFinal model response: ${interaction2.steps.at(-1).content[0].text}`);

REST

IMG_URL="https://goo.gle/instrument-img"

MIME_TYPE=$(curl -sIL "$IMG_URL" | grep -i '^content-type:' | awk -F ': ' '{print $2}' | sed 's/\r$//' | head -n 1)

if [[ -z "$MIME_TYPE" || ! "$MIME_TYPE" == image/* ]]; then

MIME_TYPE="image/jpeg"

fi

# Check for macOS

if [[ "$(uname)" == "Darwin" ]]; then

IMAGE_B64=$(curl -sL "$IMG_URL" | base64 -b 0)

elif [[ "$(base64 --version 2>&1)" = *"FreeBSD"* ]]; then

IMAGE_B64=$(curl -sL "$IMG_URL" | base64)

else

IMAGE_B64=$(curl -sL "$IMG_URL" | base64 -w0)

fi

# 1. First interaction (triggers function call)

# curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

# -H "x-goog-api-key: $GEMINI_API_KEY" \

# -H 'Content-Type: application/json' \

# -H "Api-Revision: 2026-05-20" \

# -d '{ "model": "gemini-3-flash-preview", "input": "Show me the instrument I ordered last month.", "tools": [...] }'

# 2. Send multimodal function result back (Replace INTERACTION_ID and CALL_ID)

# Specifies the API revision to avoid breaking changes when they become default

curl -X POST "https://generativelanguage.googleapis.com/v1beta/interactions" \

-H "x-goog-api-key: $GEMINI_API_KEY" \

-H 'Content-Type: application/json' \

-H "Api-Revision: 2026-05-20" \

-d '{

"model": "gemini-3-flash-preview",

"previous_interaction_id": "INTERACTION_ID",

"input": [{

"type": "function_result",

"name": "get_image",

"call_id": "CALL_ID",

"result": [

{ "type": "text", "text": "instrument.jpg" },

{

"type": "image",

"mime_type": "'"$MIME_TYPE"'",

"data": "'"$IMAGE_B64"'"

}

]

}]

}'

Combinar ferramentas integradas e chamadas de função

O Gemini 3 permite o uso de ferramentas integradas (como a Pesquisa Google, o contexto de URL e mais) e ferramentas personalizadas de chamada de função na mesma chamada de API, permitindo fluxos de trabalho mais complexos.

Python

# This will only work for SDK newer than 2.0.0

from google import genai

from google.genai import types

client = genai.Client()

getWeather = {

"type": "function",

"name": "getWeather",

"description": "Gets the weather for a requested city.",

"parameters": {

"type": "object",

"properties": {

"city": {

"type": "string",

"description": "The city and state, e.g. Utqiaġvik, Alaska",

},

},

"required": ["city"],

},

}

interaction = client.interactions.create(

model="gemini-3-flash-preview",

input="What is the northernmost city in the United States? What's the weather like there today?",

tools=[

{"type": "google_search"},

getWeather

],

)

# Find the function call step

fc_step = next((s for s in interaction.steps if s.type == "function_call"), None)

if fc_step:

# Simulate a function result

result = {"response": "Very cold. 22 degrees Fahrenheit."}

final_interaction = client.interactions.create(

model="gemini-3-flash-preview",

input=[

{"type": "function_result", "name": fc_step.name, "call_id": fc_step.id, "result": result}

],

tools=[

{"type": "google_search"},

getWeather

],

previous_interaction_id=interaction.id,

)

print(final_interaction.steps[-1].content[0].text)

JavaScript

// This will only work for SDK newer than 2.0.0

import { GoogleGenAI, Type } from '@google/genai';

const client = new GoogleGenAI({});

const getWeatherDeclaration = {

type: 'function',

name: 'getWeather',

description: 'Gets the weather for a requested city.',

parameters: {

type: Type.OBJECT,

properties: {

city: {

type: Type.STRING,

description: 'The city and state, e.g. Utqiaġvik, Alaska',

},

},

required: ['city'],

},

};

const interaction = await client.interactions.create({

model: 'gemini-3-flash-preview',

input: "What is the northernmost city in the United States? What's the weather like there today?",

tools: [

{ type: "google_search" },

getWeatherDeclaration

],

});

// Find the function call step

const fcStep = interaction.steps.find(s => s.type === 'function_call');

if (fcStep) {

const result = { response: "Very cold. 22 degrees Fahrenheit." };

const finalInteraction = await client.interactions.create({

model: 'gemini-3-flash-preview',

input: [

{ type: 'function_result', name: fcStep.name, call_id: fcStep.id, result: result }

],

tools: [

{ type: "google_search" },

getWeatherDeclaration

],

previous_interaction_id: interaction.id,

});

console.log(finalInteraction.steps.at(-1).content[0].text);

}

Migração do Gemini 2.5

O Gemini 3 é nossa família de modelos mais avançada até o momento e oferece uma melhoria gradual em relação ao Gemini 2.5. Ao migrar, considere o seguinte:

- Raciocínio:se você usava engenharia de comandos complexa (como

cadeia de pensamento) para forçar o Gemini 2.5 a raciocinar, teste o Gemini 3 com

thinking_level: "high"e comandos simplificados. - Configurações de temperatura:se o código atual definir explicitamente a temperatura (especialmente para valores baixos em saídas determinísticas), recomendamos remover esse parâmetro e usar o padrão do Gemini 3 de 1,0 para evitar possíveis problemas de loop ou degradação de desempenho em tarefas complexas.

- PDF e compreensão de documentos:se você dependia de um comportamento específico para a análise de documentos densos, teste a nova configuração

media_resolution_highpara garantir a precisão contínua. - Consumo de tokens:a migração para os padrões do Gemini 3 pode aumentar o uso de tokens para PDFs, mas diminuir o uso de tokens para vídeos. Se as solicitações excederem a janela de contexto devido a resoluções padrão mais altas, recomendamos reduzir explicitamente a resolução da mídia.

- Segmentação de imagens:os recursos de segmentação de imagens (que retornam máscaras no nível do pixel para objetos) não são compatíveis com o Gemini 3 Pro ou o Gemini 3 Flash. Para cargas de trabalho que exigem segmentação de imagem integrada, recomendamos continuar usando o Gemini 2.5 Flash com o recurso de pensamento desativado ou o Gemini Robotics-ER 1.6.

- Uso de computador:o Gemini 3 Pro e o Gemini 3 Flash são compatíveis com o Uso de computador. Ao contrário da série 2.5, não é necessário usar um modelo separado para acessar a ferramenta de uso do computador.

- Suporte a ferramentas: agora é possível combinar ferramentas integradas com a chamada de função nos modelos do Gemini 3. O fundamentação do Maps também está disponível para os modelos do Gemini 3.

Compatibilidade com a OpenAI

Para usuários que utilizam a camada de compatibilidade do OpenAI,

os parâmetros padrão (reasoning_effort do OpenAI) são mapeados automaticamente para

equivalentes do Gemini (thinking_level).

Práticas recomendadas para comandos

O Gemini 3 é um modelo de raciocínio, o que muda a forma como você precisa dar comandos.

- Instruções precisas:seja conciso nos comandos de entrada. O Gemini 3 responde melhor a instruções diretas e claras. Ela pode analisar demais técnicas de engenharia de comandos detalhadas ou muito complexas usadas em modelos mais antigos.

- Nível de detalhe da saída:por padrão, o Gemini 3 é menos detalhista e prefere fornecer respostas diretas e eficientes. Se o caso de uso exigir uma personalidade mais conversacional ou "falante", você precisará direcionar explicitamente o modelo no comando (por exemplo, "Explique isso como um assistente amigável e falante").

- Gerenciamento de contexto:ao trabalhar com grandes conjuntos de dados (por exemplo, livros inteiros, bases de código ou vídeos longos), coloque suas instruções ou perguntas específicas no final do comando, depois do contexto de dados. Ancore o raciocínio do modelo nos dados fornecidos começando sua pergunta com uma frase como "Com base nas informações anteriores...".

Saiba mais sobre estratégias de design de comandos no guia de engenharia de comandos.

Perguntas frequentes

Qual é o limite de conhecimento do Gemini 3? Os modelos do Gemini 3 têm um limite de conhecimento de janeiro de 2025. Para informações mais recentes, use a ferramenta Embasamento da pesquisa.

Quais são os limites da janela de contexto? Os modelos do Gemini 3 oferecem suporte a uma janela de contexto de entrada de 1 milhão de tokens e até 64 mil tokens de saída.

Existe um nível sem custo financeiro para o Gemini 3? O Gemini 3 Flash

gemini-3-flash-previewtem um nível sem custo financeiro na API Gemini. Você pode testar o Gemini 3.1 Pro e o 3 Flash sem custo financeiro no Google AI Studio, mas não há um nível sem custo financeiro disponível paragemini-3.1-pro-previewna API Gemini.Meu código

thinking_budgetantigo ainda vai funcionar? Sim, othinking_budgetainda tem suporte para compatibilidade com versões anteriores, mas recomendamos migrar para othinking_levelpara ter um desempenho mais previsível. Não use os dois na mesma solicitação.O Gemini 3 é compatível com a API Batch? Sim, o Gemini 3 é compatível com a API Batch.

O armazenamento em cache de contexto é compatível? Sim, o armazenamento em cache de contexto é compatível com o Gemini 3.

Quais ferramentas são compatíveis com o Gemini 3? O Gemini 3 é compatível com Pesquisa Google, embasamento com o Google Maps, Pesquisa de arquivos, Execução de código e Contexto de URL. Ele também oferece suporte à Chamada de função padrão para suas próprias ferramentas personalizadas e em combinação com ferramentas integradas.

O que é

gemini-3.1-pro-preview-customtools? Se você estiver usando ogemini-3.1-pro-previewe o modelo ignorar suas ferramentas personalizadas em favor dos comandos bash, tente usar o modelogemini-3.1-pro-preview-customtools. Mais informações [aqui][customtools-model].