Chạy trong Google Colab Chạy trong Google Colab

|

Xem nguồn trên GitHub Xem nguồn trên GitHub

|

Tổng quan

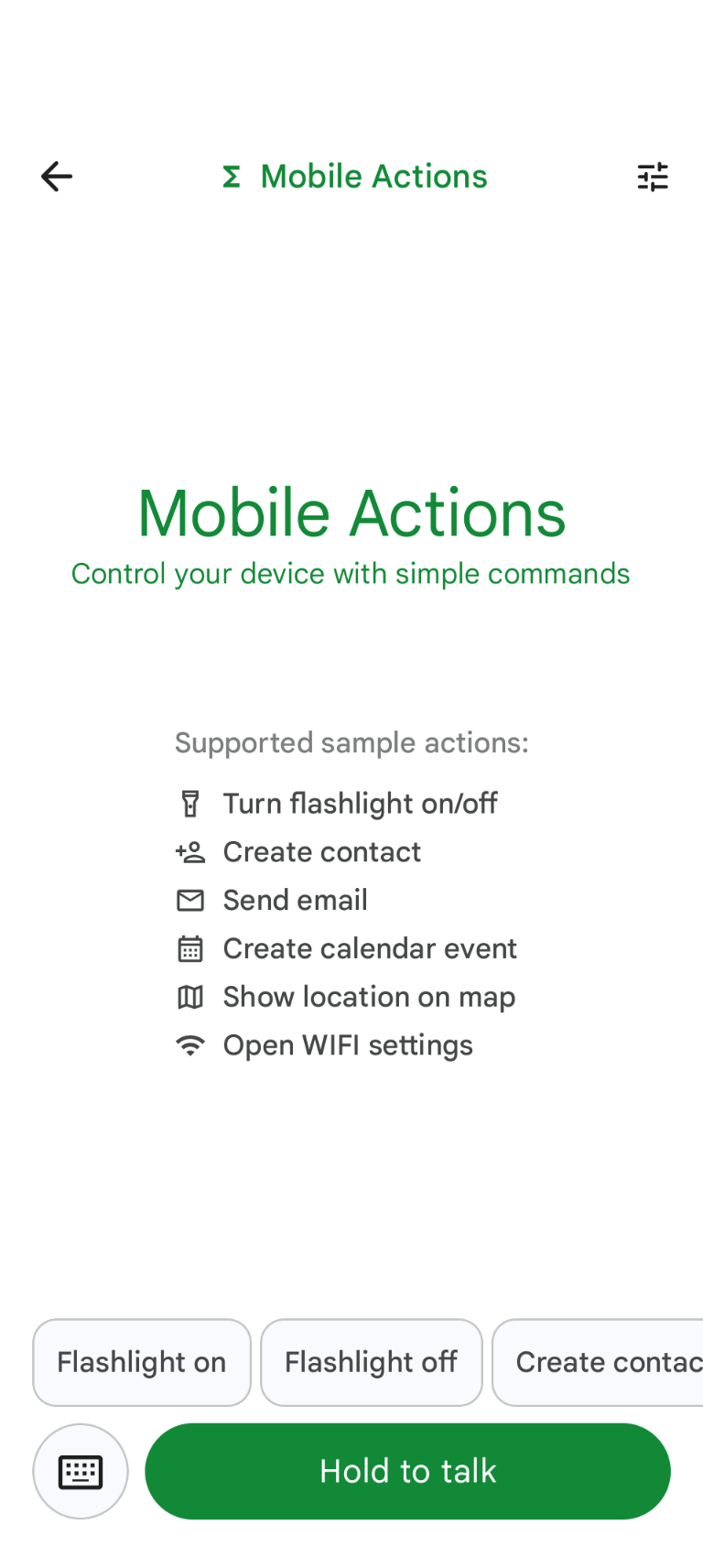

Mobile Actions là một ứng dụng minh hoạ, trong đó người dùng có thể kích hoạt các thao tác trên thiết bị của họ bằng giọng nói hoặc văn bản. Tính năng này tái hiện hoạt động tương tác với trợ lý dưới dạng một chức năng hoàn toàn ngoại tuyến. Cho dù đó là "Tạo một sự kiện trên lịch cho bữa trưa ngày mai", "Thêm John vào danh bạ của tôi" hay "Bật đèn pin", mô hình này đều phân tích ngôn ngữ tự nhiên và xác định công cụ OS phù hợp để thực thi lệnh.

Hướng dẫn này sẽ cho bạn biết cách:

- Tinh chỉnh mô hình FunctionGemma 270M bằng tập dữ liệu Hành động trên thiết bị di động

- Triển khai mô hình tuỳ chỉnh vào Google AI Edge Gallery

Bạn sẽ có thể học từ đầu đến cuối, từ tinh chỉnh mô hình cho đến triển khai mô hình đó trên thiết bị.

Bước 1: Tinh chỉnh FunctionGemma bằng Tập dữ liệu về hành động trên thiết bị di động

FunctionGemma là một mô hình có 270 triệu tham số dựa trên cấu trúc Gemma 3. Mô hình này được huấn luyện đặc biệt cho việc gọi hàm, cho phép mô hình dịch các yêu cầu bằng ngôn ngữ tự nhiên thành các lệnh gọi hàm.

Mô hình này đủ nhỏ và hiệu quả để chạy trên điện thoại di động, nhưng như thường lệ đối với các mô hình có kích thước này, mô hình này cần được tinh chỉnh để chuyên biệt hoá cho tác vụ mà mô hình sẽ thực hiện.

Để tinh chỉnh FunctionGemma, chúng tôi sử dụng tập dữ liệu Hành động trên thiết bị di động. Tập dữ liệu này được cung cấp công khai trên Hugging Face. Mỗi mục trong tập dữ liệu này cung cấp:

- Tập hợp các công cụ (hàm) mà mô hình có thể sử dụng:

- Bật đèn pin

- Tắt đèn pin

- Tạo một người liên hệ trong danh bạ của điện thoại

- Gửi email

- Hiển thị một vị trí trên bản đồ

- Mở phần cài đặt Wi-Fi

- Tạo một sự kiện mới trên lịch

- Câu lệnh hệ thống cung cấp ngữ cảnh, chẳng hạn như ngày và giờ hiện tại

- Câu lệnh của người dùng, chẳng hạn như

turn on the flashlight. - Phản hồi dự kiến của mô hình, bao gồm cả các lệnh gọi hàm thích hợp.

Sau đây là giao diện của hàm hiện bản đồ:

{

"function": {

"name": "show_map",

"description": "Shows a location on the map.",

"parameters": {

"type": "OBJECT",

"properties": {

"query": {

"type": "STRING",

"description": "The location to search for. May be the name of a place, a business, or an address."

}

},

"required": [

"query"

]

}

}

}

Sổ tay Colab trình bày tất cả các bước cần thiết, bao gồm:

- Thiết lập môi trường

- Tải và xử lý trước tập dữ liệu Mobile Actions

- Tinh chỉnh mô hình bằng Hugging Face TRL

- Chuyển đổi mô hình sang định dạng

.litertlmđể triển khai

Bước 2: Triển khai trên Google AI Edge Gallery

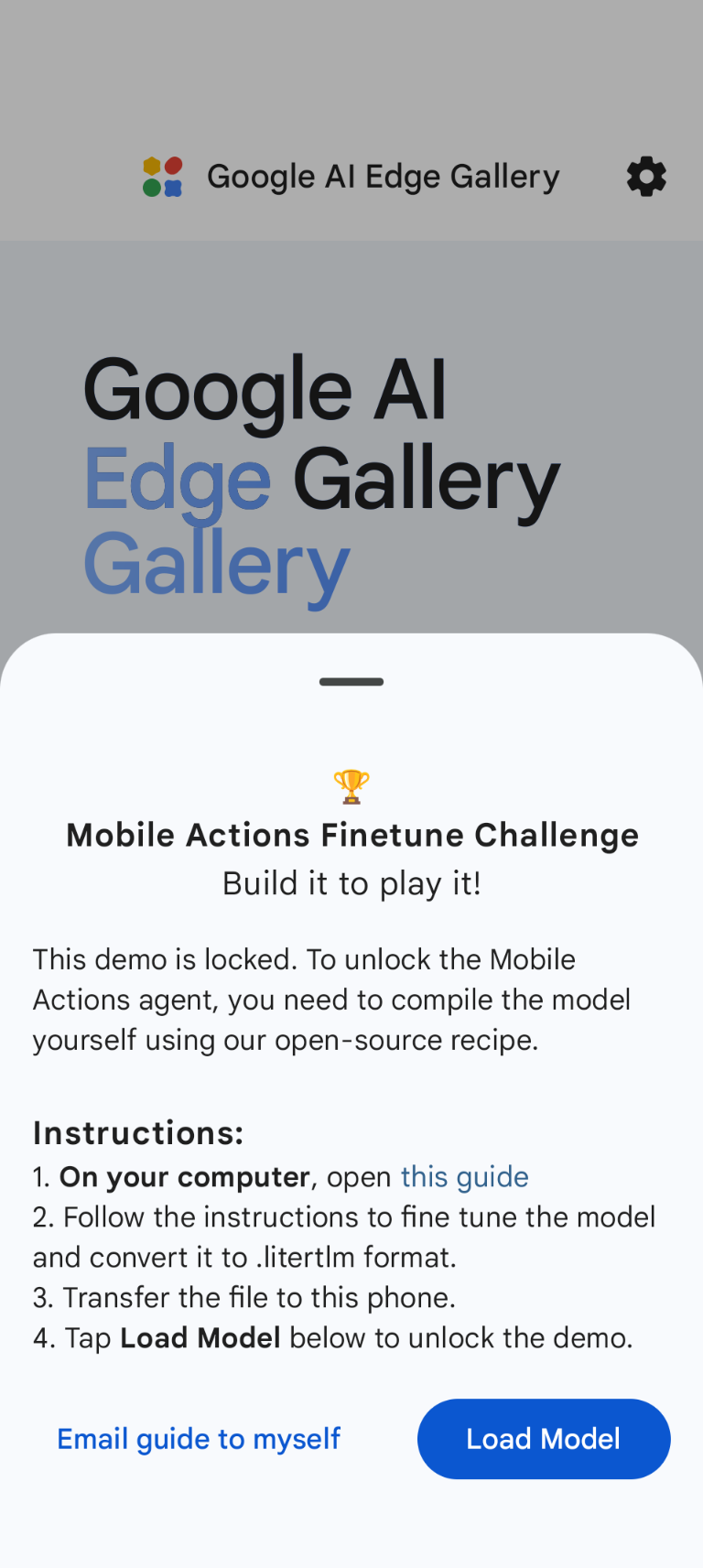

Điều kiện tiên quyết: Bạn cần có cùng một Tài khoản Google mà bạn đã dùng để lưu tệp .litertlm ở bước 1 và đăng nhập bằng tài khoản đó trên điện thoại Android.

Sau khi tinh chỉnh, chúng tôi sẽ chuyển đổi và lượng tử hoá các trọng số mô hình sang định dạng .litertlm.

Bạn có thể triển khai mô hình này cho lựa chọn Google AI Edge Gallery – Mobile Actions bằng cách chọn Load Model rồi chọn mô hình đó trong Google Drive (hoặc phương thức phân phối thay thế). Google AI Edge Gallery có trên Cửa hàng Google Play.

Giờ đây, bạn có thể thử đưa ra lệnh thoại hoặc nhập vào ứng dụng để xem mức độ hiệu quả của mô hình mới được tinh chỉnh trong việc gọi các hàm có sẵn.

Các bước tiếp theo

Xin chúc mừng! Giờ đây, bạn đã biết cách tinh chỉnh một mô hình bằng Hugging Face và triển khai mô hình đó trên thiết bị bằng LiteRT-LM.