MediaPipe El Önemli Noktası Belirleyici görevi, bir resimdeki ellerin önemli noktalarını algılamanıza olanak tanır. Bu talimatlarda, El İşaretçisi'nin iOS uygulamalarında nasıl kullanılacağı gösterilmektedir. Bu talimatlarda açıklanan kod örneğini GitHub'da bulabilirsiniz.

Bu görevin özellikleri, modelleri ve yapılandırma seçenekleri hakkında daha fazla bilgi için Genel bakış bölümüne bakın.

Kod örneği

MediaPipe Tasks örnek kodu, iOS için el yer işaretleyici uygulamasının temel bir uygulamasıdır. Bu örnekte, fiziksel bir iOS cihazdaki kamera kullanılarak kesintisiz bir video akışındaki el yer işaretleri algılanmaktadır. Uygulama, cihaz galerisindeki resim ve videolardaki el yer işaretlerini de algılayabilir.

Uygulamayı kendi iOS uygulamanız için başlangıç noktası olarak kullanabilir veya mevcut bir uygulamayı değiştirirken referans olarak kullanabilirsiniz. El İşaretçisi örnek kodu GitHub'da barındırılır.

Kodu indirme

Aşağıdaki talimatlarda, git komut satırı aracını kullanarak örnek kodun yerel bir kopyasının nasıl oluşturulacağı gösterilmektedir.

Örnek kodu indirmek için:

Aşağıdaki komutu kullanarak git deposunu klonlayın:

git clone https://github.com/google-ai-edge/mediapipe-samplesİsteğe bağlı olarak, git örneğinizi seyrek kontrol kullanacak şekilde yapılandırın. Böylece yalnızca Hand Landmarker örnek uygulamasının dosyalarına sahip olursunuz:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/hand_landmarker/ios/

Örnek kodun yerel bir sürümünü oluşturduktan sonra MediaPipe görev kitaplığını yükleyebilir, Xcode'u kullanarak projeyi açabilir ve uygulamayı çalıştırabilirsiniz. Talimatlar için iOS için Kurulum Kılavuzu'na bakın.

Temel bileşenler

Aşağıdaki dosyalar, El İşaretçisi örnek uygulamasının önemli kodunu içerir:

- HandLandmarkerService.swift: HandLandmarker'ı başlatır, model seçimini yönetir ve giriş verilerinde çıkarım yapar.

- CameraViewController.swift: Canlı kamera feed'i giriş modu için kullanıcı arayüzünü uygular ve sonuçları görselleştirir.

- MediaLibraryViewController.swift: Hareketsiz resim ve video dosyası giriş modu için kullanıcı arayüzünü uygular ve sonuçları görselleştirir.

Kurulum

Bu bölümde, geliştirme ortamınızı ve kod projelerinizi Hand Landmarker'ı kullanacak şekilde ayarlamayla ilgili temel adımlar açıklanmaktadır. Platform sürümü gereksinimleri dahil olmak üzere, MediaPipe görevlerini kullanmak için geliştirme ortamınızı ayarlama hakkında genel bilgi için iOS için kurulum kılavuzuna bakın.

Bağımlılıklar

Hand Landmarker, CocoaPods kullanılarak yüklenmesi gereken MediaPipeTasksVision kitaplığını kullanır. Kitaplık hem Swift hem de Objective-C uygulamalarıyla uyumludur ve dile özgü ek kurulum gerektirmez.

CocoaPods'u macOS'e yükleme talimatları için CocoaPods yükleme kılavuzuna bakın.

Uygulamanız için gerekli kapsülleri içeren bir Podfile oluşturma talimatları için CocoaPods'u kullanma başlıklı makaleyi inceleyin.

Aşağıdaki kodu kullanarak MediaPipeTasksVision kapsülünü Podfile içine ekleyin:

target 'MyHandLandmarkerApp' do

use_frameworks!

pod 'MediaPipeTasksVision'

end

Uygulamanız birim testi hedefleri içeriyorsa Podfile'inizi ayarlama hakkında daha fazla bilgi için iOS için Kurulum Kılavuzu'na bakın.

Model

MediaPipe Hand Landmarker görevi, bu görevle uyumlu bir eğitimli model gerektirir. El İşaretçisi için mevcut eğitimli modeller hakkında daha fazla bilgi edinmek istiyorsanız göreve genel bakıştaki Modeller bölümüne bakın.

Bir model seçip indirin ve Xcode'u kullanarak proje dizininize ekleyin. Xcode projenize dosya eklemeyle ilgili talimatlar için Xcode projenizdeki dosya ve klasörleri yönetme başlıklı makaleyi inceleyin.

Uygulama paketinizdeki modelin yolunu belirtmek için BaseOptions.modelAssetPath mülkünü kullanın. Kod örneği için sonraki bölüme bakın.

Görevi oluşturun

El İşaretçisi görevini, başlatıcılarından birini çağırarak oluşturabilirsiniz. HandLandmarker(options:) başlatıcısı, yapılandırma seçenekleri için değerleri kabul eder.

Özelleştirilmiş yapılandırma seçenekleriyle başlatılmış bir El Yer İşaretçisi'ne ihtiyacınız yoksa varsayılan seçeneklerle bir El Yer İşaretçisi oluşturmak için HandLandmarker(modelPath:) başlatıcıyı kullanabilirsiniz. Yapılandırma seçenekleri hakkında daha fazla bilgi için Yapılandırmaya Genel Bakış başlıklı makaleyi inceleyin.

El İşaretçisi görevi 3 giriş veri türünü destekler: hareketsiz resimler, video dosyaları ve canlı video akışları. Varsayılan olarak HandLandmarker(modelPath:), hareketsiz resimler için bir görev başlatır. Görevinizin, video dosyalarını veya canlı video yayınlarını işlemek için başlatılmasını istiyorsanız video veya canlı yayın çalışma modunu belirtmek için HandLandmarker(options:) öğesini kullanın. Canlı yayın modu için ek bir handLandmarkerLiveStreamDelegate yapılandırma seçeneği de gerekir. Bu seçenek, el yer işaretleyicinin el yer işaretleyici sonuçlarını temsilciye eşzamansız olarak sunmasını sağlar.

Görevi nasıl oluşturacağınızı ve çıkarım işlemini nasıl çalıştıracağınızı görmek için çalıştırma modunuza karşılık gelen sekmeyi seçin.

Swift

Resim

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "hand_landmarker", ofType: "task") let options = HandLandmarkerOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .image options.minHandDetectionConfidence = minHandDetectionConfidence options.minHandPresenceConfidence = minHandPresenceConfidence options.minTrackingConfidence = minHandTrackingConfidence options.numHands = numHands let handLandmarker = try HandLandmarker(options: options)

Video

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "hand_landmarker", ofType: "task") let options = HandLandmarkerOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .video options.minHandDetectionConfidence = minHandDetectionConfidence options.minHandPresenceConfidence = minHandPresenceConfidence options.minTrackingConfidence = minHandTrackingConfidence options.numHands = numHands let handLandmarker = try HandLandmarker(options: options)

Canlı yayın

import MediaPipeTasksVision // Class that conforms to the `HandLandmarkerLiveStreamDelegate` protocol and // implements the method that the hand landmarker calls once it finishes // performing landmarks detection in each input frame. class HandLandmarkerResultProcessor: NSObject, HandLandmarkerLiveStreamDelegate { func handLandmarker( _ handLandmarker: HandLandmarker, didFinishDetection result: HandLandmarkerResult?, timestampInMilliseconds: Int, error: Error?) { // Process the hand landmarker result or errors here. } } let modelPath = Bundle.main.path( forResource: "hand_landmarker", ofType: "task") let options = HandLandmarkerOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .liveStream options.minHandDetectionConfidence = minHandDetectionConfidence options.minHandPresenceConfidence = minHandPresenceConfidence options.minTrackingConfidence = minHandTrackingConfidence options.numHands = numHands // Assign an object of the class to the `handLandmarkerLiveStreamDelegate` // property. let processor = HandLandmarkerResultProcessor() options.handLandmarkerLiveStreamDelegate = processor let handLandmarker = try HandLandmarker(options: options)

Objective-C

Resim

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"hand_landmarker" ofType:@"task"]; MPPHandLandmarkerOptions *options = [[MPPHandLandmarkerOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeImage; options.minHandDetectionConfidence = minHandDetectionConfidence; options.minHandPresenceConfidence = minHandPresenceConfidence; options.minTrackingConfidence = minHandTrackingConfidence; options.numHands = numHands; MPPHandLandmarker *handLandmarker = [[MPPHandLandmarker alloc] initWithOptions:options error:nil];

Video

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"hand_landmarker" ofType:@"task"]; MPPHandLandmarkerOptions *options = [[MPPHandLandmarkerOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeVideo; options.minHandDetectionConfidence = minHandDetectionConfidence; options.minHandPresenceConfidence = minHandPresenceConfidence; options.minTrackingConfidence = minHandTrackingConfidence; options.numHands = numHands; MPPHandLandmarker *handLandmarker = [[MPPHandLandmarker alloc] initWithOptions:options error:nil];

Canlı yayın

@import MediaPipeTasksVision; // Class that conforms to the `MPPHandLandmarkerLiveStreamDelegate` protocol // and implements the method that the hand landmarker calls once it finishes // performing landmarks detection in each input frame. @interface APPHandLandmarkerResultProcessor : NSObject@end @implementation APPHandLandmarkerResultProcessor - (void)handLandmarker:(MPPHandLandmarker *)handLandmarker didFinishDetectionWithResult:(MPPHandLandmarkerResult *)handLandmarkerResult timestampInMilliseconds:(NSInteger)timestampInMilliseconds error:(NSError *)error { // Process the hand landmarker result or errors here. } @end NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"hand_landmarker" ofType:@"task"]; MPPHandLandmarkerOptions *options = [[MPPHandLandmarkerOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeLiveStream; options.minHandDetectionConfidence = minHandDetectionConfidence; options.minHandPresenceConfidence = minHandPresenceConfidence; options.minTrackingConfidence = minHandTrackingConfidence; options.numHands = numHands; // Assign an object of the class to the `handLandmarkerLiveStreamDelegate` // property. APPHandLandmarkerResultProcessor *processor = [APPHandLandmarkerResultProcessor new]; options.handLandmarkerLiveStreamDelegate = processor; MPPHandLandmarker *handLandmarker = [[MPPHandLandmarker alloc] initWithOptions:options error:nil];

Yapılandırma seçenekleri

Bu görevde, iOS uygulamaları için aşağıdaki yapılandırma seçenekleri bulunur:

| Seçenek Adı | Açıklama | Değer Aralığı | Varsayılan değer |

|---|---|---|---|

running_mode |

Görevin çalışma modunu ayarlar. Üç mod vardır: RESİM: Tek resim girişleri için kullanılan mod. VIDEO: Bir videonun kod çözülmüş karelerinin modu. LIVE_STREAM: Kameradan alınan giriş verilerinin canlı yayını için kullanılan mod. Bu modda, sonuçları asenkron olarak alacak bir dinleyici oluşturmak için resultListener çağrılmalıdır. Bu modda, handLandmarkerLiveStreamDelegate, el yer işareti algılama sonuçlarını asenkron olarak almak için HandLandmarkerLiveStreamDelegate sınıfını uygulayan bir sınıf örneğine ayarlanmalıdır.

|

{RunningMode.image, RunningMode.video, RunningMode.liveStream} |

RunningMode.image |

numHands |

El yer işareti algılayıcısı tarafından algılanan maksimum el sayısı. | Any integer > 0 |

1 |

minHandDetectionConfidence |

Avuç içi algılama modelinde el algılamanın başarılı olarak kabul edilmesi için gereken minimum güven puanı. | 0.0 - 1.0 |

0.5 |

minHandPresenceConfidence |

El yer işareti algılama modelindeki el varlığı puanı için minimum güven puanı. Video modu ve canlı yayın modunda, el yer işareti modelinden elde edilen el varlığı güven puanı bu eşiğin altındaysa El Yer İşareti Belirleyici, avuç içi algılama modelini tetikler. Aksi takdirde, sonraki önemli nokta algılamaları için ellerin konumunu hafif bir el izleme algoritması belirler. | 0.0 - 1.0 |

0.5 |

minTrackingConfidence |

El izlemenin başarılı kabul edilmesi için gereken minimum güven puanı. Bu, geçerli çerçevedeki ve son çerçevedeki eller arasındaki sınırlayıcı kutu IoU eşiğidir. El İşaretçisi'nin Video modu ve Akış modunda, izleme başarısız olursa El İşaretçisi el algılamayı tetikler. Aksi takdirde el algılama atlanır. | 0.0 - 1.0 |

0.5 |

result_listener |

Sonuç dinleyicisini, el yer işaretleyicisi canlı yayın modundayken algılama sonuçlarını asenkron olarak alacak şekilde ayarlar.

Yalnızca çalışma modu LIVE_STREAM olarak ayarlandığında geçerlidir |

Yok | Yok |

Çalışma modu canlı yayın olarak ayarlandığında El İşaretleyici, ek handLandmarkerLiveStreamDelegate yapılandırma seçeneğini gerektirir. Bu seçenek, El İşaretleyici'nin el işareti algılama sonuçlarını eşzamansız olarak sunmasını sağlar. Temsilci, her kare için el yer işareti algılama sonuçlarını işledikten sonra El Yer İşareti Belirleyici'nin çağırdığı handLandmarker(_:didFinishDetection:timestampInMilliseconds:error:) yöntemini uygulamalıdır.

| Seçenek adı | Açıklama | Değer Aralığı | Varsayılan değer |

|---|---|---|---|

handLandmarkerLiveStreamDelegate |

El yer işaretleyicinin, canlı yayın modunda el yer işareti algılama sonuçlarını eşzamansız olarak almasını sağlar. Örneği bu mülke ayarlanan sınıf, handLandmarker(_:didFinishDetection:timestampInMilliseconds:error:) yöntemini uygulamalıdır. |

Geçerli değil | Ayarlanmadı |

Verileri hazırlama

Giriş resmini veya çerçevesini El İşaretçisi'ne iletmeden önce MPImage nesnesine dönüştürmeniz gerekir. MPImage, farklı iOS resim biçimlerini destekler ve bunları çıkarım için herhangi bir çalışma modunda kullanabilir. MPImage hakkında daha fazla bilgi için MPImage API'ye bakın.

Kullanım alanınıza ve uygulamanızın gerektirdiği çalışma moduna göre bir iOS resim biçimi seçin.MPImage, UIImage, CVPixelBuffer ve CMSampleBuffer iOS resim biçimlerini kabul eder.

UIImage

UIImage biçimi aşağıdaki çalışma modları için uygundur:

Resimler: Uygulama paketindeki, kullanıcı galerisindeki veya dosya sistemindeki

UIImageresimleriMPImagenesnesine dönüştürülebilir.Videolar: Video karelerini CGImage biçiminde ayıklamak için AVAssetImageGenerator'ı kullanın, ardından bunları

UIImageresimlerine dönüştürün.

Swift

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(uiImage: image)

Objective-C

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

Örnekte, varsayılan UIImage.Orientation.Up oryantasyonuyla bir MPImage başlatılır. MPImage öğesini, desteklenen UIImage.Orientation değerlerinden herhangi biriyle başlatabilirsiniz. El İşaretçisi, .upMirrored, .downMirrored, .leftMirrored, .rightMirrored gibi yansımalı yönleri desteklemez.

UIImage hakkında daha fazla bilgi için UIImage Apple Developer Documentation (UIImage Apple Developer Documentation) sayfasına bakın.

CVPixelBuffer

CVPixelBuffer biçimi, kare oluşturan ve işleme için iOS CoreImage çerçevesini kullanan uygulamalar için idealdir.

CVPixelBuffer biçimi aşağıdaki çalışma modları için uygundur:

Resimler: iOS'un

CoreImageçerçevesi kullanılarak bazı işlemlerden sonraCVPixelBufferresimleri oluşturan uygulamalar, resim çalıştırma modunda El Yer İşaretçisi'ne gönderilebilir.Videolar: Video kareleri, işleme için

CVPixelBufferbiçimine dönüştürülebilir ve ardından video modunda El İşaretçisi'ne gönderilebilir.canlı yayın: Çerçeve oluşturmak için iOS kamera kullanan uygulamalar, canlı yayın modunda El İşaretçisi'ne gönderilmeden önce işleme için

CVPixelBufferbiçimine dönüştürülebilir.

Swift

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(pixelBuffer: pixelBuffer)

Objective-C

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

CVPixelBuffer hakkında daha fazla bilgi için CVPixelBuffer Apple Developer Documentation başlıklı makaleyi inceleyin.

CMSampleBuffer

CMSampleBuffer biçimi, tek tip bir medya türünün medya örneklerini depolar ve canlı yayın çalışma modu için idealdir. iOS kameralarından gelen canlı kareler, iOS AVCaptureVideoDataOutput tarafından CMSampleBuffer biçiminde asenkron olarak yayınlanır.

Swift

// Obtain a CMSampleBuffer. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(sampleBuffer: sampleBuffer)

Objective-C

// Obtain a `CMSampleBuffer`. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithSampleBuffer:sampleBuffer error:nil];

CMSampleBuffer hakkında daha fazla bilgi için CMSampleBuffer Apple Developer Documentation sayfasına bakın.

Görevi çalıştırma

El İşaretçisi'ni çalıştırmak için atanan çalışma moduna özel detect() yöntemini kullanın:

- Hareketsiz resim:

detect(image:) - Video:

detect(videoFrame:timestampInMilliseconds:) - Canlı yayın:

detectAsync(image:timestampInMilliseconds:)

Swift

Resim

let result = try handLandmarker.detect(image: image)

Video

let result = try handLandmarker.detect(

videoFrame: image,

timestampInMilliseconds: timestamp)

Canlı yayın

try handLandmarker.detectAsync(

image: image,

timestampInMilliseconds: timestamp)

Objective-C

Resim

MPPHandLandmarkerResult *result = [handLandmarker detectInImage:image error:nil];

Video

MPPHandLandmarkerResult *result = [handLandmarker detectInVideoFrame:image timestampInMilliseconds:timestamp error:nil];

Canlı yayın

BOOL success = [handLandmarker detectAsyncInImage:image timestampInMilliseconds:timestamp error:nil];

El İşaretçisi kod örneğinde bu modların her birinin uygulamaları daha ayrıntılı olarak gösterilmektedir. Örnek kod, kullanıcının işleme modları arasında geçiş yapmasına olanak tanır. Bu, kullanım alanınız için gerekli olmayabilir.

Aşağıdakileri göz önünde bulundurun:

Video modunda veya canlı yayın modunda çalışırken, giriş karesinin zaman damgasını da El İşaretçisi görevine sağlamanız gerekir.

El İşaretleyici görevi, resim veya video modunda çalışırken giriş resmini ya da kareyi işlemeyi tamamlayana kadar mevcut iş parçacığını engeller. Geçerli mesaj dizisini engellememek için iOS Dispatch veya NSOperation çerçevelerini kullanarak işlemeyi arka plan mesaj dizisinde yürütün.

El İşaretçisi görevi, canlı yayın modunda çalışırken hemen döndürülür ve mevcut iş parçacığı engellenmez. Her giriş çerçevesi işlendikten sonra el yer işaretleyicisi sonucuyla

handLandmarker(_:didFinishDetection:timestampInMilliseconds:error:)yöntemini çağırır. El İşaretçisi, bu yöntemi özel bir seri dağıtım kuyruğunda eşzamansız olarak çağırır. Sonuçları kullanıcı arayüzünde görüntülemek için sonuçları işledikten sonra ana kuyruğa gönderin. El İşaretçisi görevi başka bir kareyi işlerkendetectAsyncişlevi çağrılırsa El İşaretçisi yeni giriş karesini yoksayar.

Sonuçları işleme ve görüntüleme

El Yer İşareti Belirleyici görevi, çıkarım çalıştırıldığında resim koordinatlarındaki el yer işaretlerini, dünya koordinatlarındaki el yer işaretlerini ve algılanan ellerin el hakimiyetini(sol/sağ el) içeren bir HandLandmarkerResult döndürür.

Aşağıda, bu görevin çıkış verilerine örnek verilmiştir:

HandLandmarkerResult çıkışı üç bileşen içerir. Her bileşen bir dizidir ve her öğe, algılanan tek bir el için aşağıdaki sonuçları içerir:

El tercihi

El tercihi, algılanan ellerin sol el mi yoksa sağ el mi olduğunu gösterir.

Önemli noktalar

Her biri

x,yvezkoordinatlarından oluşan 21 el yer işareti vardır.xveykoordinatları, sırasıyla resim genişliği ve yüksekliğine göre [0,0; 1,0] aralığında normalleştirilir.zkoordinatı, bilekteki derinliğin orijin olduğu yer işareti derinliğini temsil eder. Değer ne kadar küçükse yer işareti kameraya o kadar yakındır.zbüyüklüğü,xile yaklaşık olarak aynı ölçeği kullanır.Dünyanın Sınırları

21 el yer işareti de dünya koordinatlarında sunulur. Her önemli nokta,

x,yvezdeğerlerinden oluşur. Bu değerler, orijini elin geometrik merkezinde olan, gerçek dünyadaki 3D koordinatları metre cinsinden temsil eder.

HandLandmarkerResult:

Handedness:

Categories #0:

index : 0

score : 0.98396

categoryName : Left

Landmarks:

Landmark #0:

x : 0.638852

y : 0.671197

z : -3.41E-7

Landmark #1:

x : 0.634599

y : 0.536441

z : -0.06984

... (21 landmarks for a hand)

WorldLandmarks:

Landmark #0:

x : 0.067485

y : 0.031084

z : 0.055223

Landmark #1:

x : 0.063209

y : -0.00382

z : 0.020920

... (21 world landmarks for a hand)

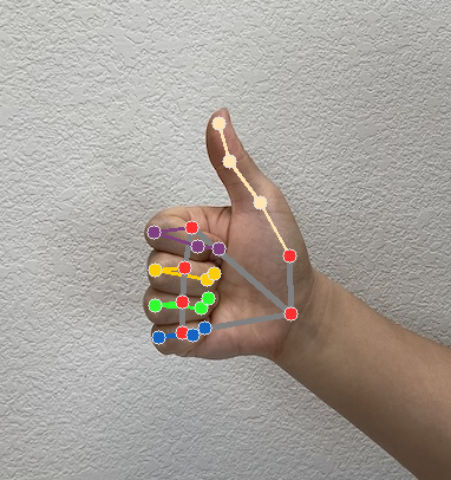

Aşağıdaki resimde görev çıktısının görselleştirmesi gösterilmektedir: