Tác vụ Điểm đánh dấu tay MediaPipe cho phép bạn phát hiện các điểm đánh dấu của tay trong hình ảnh. Những hướng dẫn này cho bạn biết cách sử dụng tính năng Điểm đánh dấu bằng tay với các ứng dụng iOS. Bạn có thể xem mã mẫu được mô tả trong các hướng dẫn này trên GitHub.

Để biết thêm thông tin về các tính năng, mô hình và tuỳ chọn cấu hình của tác vụ này, hãy xem phần Tổng quan.

Ví dụ về mã

Mã ví dụ về Tác vụ MediaPipe là cách triển khai cơ bản của ứng dụng Hand Landmarker (Đánh dấu điểm trên tay) dành cho iOS. Ví dụ này sử dụng máy ảnh trên một thiết bị iOS thực để phát hiện các điểm đánh dấu bàn tay trong luồng video liên tục. Ứng dụng cũng có thể phát hiện các điểm đánh dấu tay trong hình ảnh và video từ thư viện thiết bị.

Bạn có thể sử dụng ứng dụng này làm điểm xuất phát cho ứng dụng iOS của riêng mình hoặc tham khảo ứng dụng này khi sửa đổi một ứng dụng hiện có. Mã ví dụ về Hand Landmarker được lưu trữ trên GitHub.

Tải mã xuống

Hướng dẫn sau đây cho bạn biết cách tạo bản sao cục bộ của mã ví dụ bằng công cụ dòng lệnh git.

Cách tải mã mẫu xuống:

Sao chép kho lưu trữ git bằng lệnh sau:

git clone https://github.com/google-ai-edge/mediapipe-samplesBạn có thể định cấu hình thực thể git để sử dụng tính năng kiểm tra thư mục thưa, nhờ đó bạn chỉ có các tệp cho ứng dụng ví dụ Hand Landmarker:

cd mediapipe-samples git sparse-checkout init --cone git sparse-checkout set examples/hand_landmarker/ios/

Sau khi tạo phiên bản cục bộ của mã ví dụ, bạn có thể cài đặt thư viện tác vụ MediaPipe, mở dự án bằng Xcode và chạy ứng dụng. Để biết hướng dẫn, hãy xem Hướng dẫn thiết lập cho iOS.

Các thành phần chính

Các tệp sau đây chứa mã quan trọng cho ứng dụng ví dụ về Hand Landmarker:

- HandLandmarkerService.swift: khởi chạy Hand Landmarker, xử lý lựa chọn mô hình và chạy suy luận trên dữ liệu đầu vào.

- CameraViewController.swift: triển khai giao diện người dùng cho chế độ nhập nguồn cấp dữ liệu máy ảnh trực tiếp và trực quan hoá kết quả.

- MediaLibraryViewController.swift: triển khai giao diện người dùng cho chế độ nhập tệp hình ảnh tĩnh và video, đồng thời hiển thị kết quả.

Thiết lập

Phần này mô tả các bước chính để thiết lập môi trường phát triển và dự án mã để sử dụng Hand Landmarker. Để biết thông tin chung về cách thiết lập môi trường phát triển cho việc sử dụng các tác vụ MediaPipe, bao gồm cả các yêu cầu về phiên bản nền tảng, hãy xem Hướng dẫn thiết lập cho iOS.

Phần phụ thuộc

Hand Landmarker sử dụng thư viện MediaPipeTasksVision. Bạn phải cài đặt thư viện này bằng CocoaPods. Thư viện này tương thích với cả ứng dụng Swift và Objective-C và không yêu cầu thiết lập bổ sung theo ngôn ngữ.

Để biết hướng dẫn cài đặt CocoaPods trên macOS, hãy tham khảo hướng dẫn cài đặt CocoaPods.

Để biết hướng dẫn về cách tạo Podfile bằng các pod cần thiết cho ứng dụng, hãy tham khảo phần Sử dụng CocoaPods.

Thêm nhóm MediaPipeTasksVision trong Podfile bằng mã sau:

target 'MyHandLandmarkerApp' do

use_frameworks!

pod 'MediaPipeTasksVision'

end

Nếu ứng dụng của bạn có các mục tiêu kiểm thử đơn vị, hãy tham khảo Hướng dẫn thiết lập cho iOS để biết thêm thông tin về cách thiết lập Podfile.

Mẫu

Tác vụ Điểm đánh dấu trên tay của MediaPipe yêu cầu một mô hình đã huấn luyện tương thích với tác vụ này. Để biết thêm thông tin về các mô hình đã huấn luyện hiện có cho tính năng Điểm đánh dấu trên tay, hãy xem phần Mô hình trong phần tổng quan về tác vụ.

Chọn và tải một mô hình xuống, sau đó thêm mô hình đó vào thư mục dự án bằng Xcode. Để biết hướng dẫn về cách thêm tệp vào dự án Xcode, hãy tham khảo phần Quản lý tệp và thư mục trong dự án Xcode.

Sử dụng thuộc tính BaseOptions.modelAssetPath để chỉ định đường dẫn đến mô hình trong gói ứng dụng. Để biết ví dụ về mã, hãy xem phần tiếp theo.

Tạo việc cần làm

Bạn có thể tạo tác vụ Hand Landmarker bằng cách gọi một trong các trình khởi tạo của tác vụ đó. Trình khởi tạo HandLandmarker(options:) chấp nhận các giá trị cho các tuỳ chọn cấu hình.

Nếu không cần khởi tạo Điểm đánh dấu tay bằng các tuỳ chọn cấu hình tuỳ chỉnh, bạn có thể sử dụng trình khởi chạy HandLandmarker(modelPath:) để tạo Điểm đánh dấu tay bằng các tuỳ chọn mặc định. Để biết thêm thông tin về các tuỳ chọn cấu hình, hãy xem phần Tổng quan về cấu hình.

Tác vụ Điểm đánh dấu trên tay hỗ trợ 3 loại dữ liệu đầu vào: hình ảnh tĩnh, tệp video và luồng video trực tiếp. Theo mặc định, HandLandmarker(modelPath:) sẽ khởi chạy một tác vụ cho ảnh tĩnh. Nếu bạn muốn khởi chạy tác vụ để xử lý các tệp video hoặc luồng video trực tiếp, hãy sử dụng HandLandmarker(options:) để chỉ định chế độ chạy video hoặc phát trực tiếp. Chế độ phát trực tiếp cũng yêu cầu tuỳ chọn cấu hình handLandmarkerLiveStreamDelegate bổ sung, cho phép Điểm đánh dấu tay phân phối kết quả điểm đánh dấu tay cho trình uỷ quyền một cách không đồng bộ.

Chọn thẻ tương ứng với chế độ chạy để xem cách tạo tác vụ và chạy suy luận.

Swift

Hình ảnh

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "hand_landmarker", ofType: "task") let options = HandLandmarkerOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .image options.minHandDetectionConfidence = minHandDetectionConfidence options.minHandPresenceConfidence = minHandPresenceConfidence options.minTrackingConfidence = minHandTrackingConfidence options.numHands = numHands let handLandmarker = try HandLandmarker(options: options)

Video

import MediaPipeTasksVision let modelPath = Bundle.main.path(forResource: "hand_landmarker", ofType: "task") let options = HandLandmarkerOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .video options.minHandDetectionConfidence = minHandDetectionConfidence options.minHandPresenceConfidence = minHandPresenceConfidence options.minTrackingConfidence = minHandTrackingConfidence options.numHands = numHands let handLandmarker = try HandLandmarker(options: options)

Sự kiện phát trực tiếp

import MediaPipeTasksVision // Class that conforms to the `HandLandmarkerLiveStreamDelegate` protocol and // implements the method that the hand landmarker calls once it finishes // performing landmarks detection in each input frame. class HandLandmarkerResultProcessor: NSObject, HandLandmarkerLiveStreamDelegate { func handLandmarker( _ handLandmarker: HandLandmarker, didFinishDetection result: HandLandmarkerResult?, timestampInMilliseconds: Int, error: Error?) { // Process the hand landmarker result or errors here. } } let modelPath = Bundle.main.path( forResource: "hand_landmarker", ofType: "task") let options = HandLandmarkerOptions() options.baseOptions.modelAssetPath = modelPath options.runningMode = .liveStream options.minHandDetectionConfidence = minHandDetectionConfidence options.minHandPresenceConfidence = minHandPresenceConfidence options.minTrackingConfidence = minHandTrackingConfidence options.numHands = numHands // Assign an object of the class to the `handLandmarkerLiveStreamDelegate` // property. let processor = HandLandmarkerResultProcessor() options.handLandmarkerLiveStreamDelegate = processor let handLandmarker = try HandLandmarker(options: options)

Objective-C

Hình ảnh

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"hand_landmarker" ofType:@"task"]; MPPHandLandmarkerOptions *options = [[MPPHandLandmarkerOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeImage; options.minHandDetectionConfidence = minHandDetectionConfidence; options.minHandPresenceConfidence = minHandPresenceConfidence; options.minTrackingConfidence = minHandTrackingConfidence; options.numHands = numHands; MPPHandLandmarker *handLandmarker = [[MPPHandLandmarker alloc] initWithOptions:options error:nil];

Video

@import MediaPipeTasksVision; NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"hand_landmarker" ofType:@"task"]; MPPHandLandmarkerOptions *options = [[MPPHandLandmarkerOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeVideo; options.minHandDetectionConfidence = minHandDetectionConfidence; options.minHandPresenceConfidence = minHandPresenceConfidence; options.minTrackingConfidence = minHandTrackingConfidence; options.numHands = numHands; MPPHandLandmarker *handLandmarker = [[MPPHandLandmarker alloc] initWithOptions:options error:nil];

Sự kiện phát trực tiếp

@import MediaPipeTasksVision; // Class that conforms to the `MPPHandLandmarkerLiveStreamDelegate` protocol // and implements the method that the hand landmarker calls once it finishes // performing landmarks detection in each input frame. @interface APPHandLandmarkerResultProcessor : NSObject@end @implementation APPHandLandmarkerResultProcessor - (void)handLandmarker:(MPPHandLandmarker *)handLandmarker didFinishDetectionWithResult:(MPPHandLandmarkerResult *)handLandmarkerResult timestampInMilliseconds:(NSInteger)timestampInMilliseconds error:(NSError *)error { // Process the hand landmarker result or errors here. } @end NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"hand_landmarker" ofType:@"task"]; MPPHandLandmarkerOptions *options = [[MPPHandLandmarkerOptions alloc] init]; options.baseOptions.modelAssetPath = modelPath; options.runningMode = MPPRunningModeLiveStream; options.minHandDetectionConfidence = minHandDetectionConfidence; options.minHandPresenceConfidence = minHandPresenceConfidence; options.minTrackingConfidence = minHandTrackingConfidence; options.numHands = numHands; // Assign an object of the class to the `handLandmarkerLiveStreamDelegate` // property. APPHandLandmarkerResultProcessor *processor = [APPHandLandmarkerResultProcessor new]; options.handLandmarkerLiveStreamDelegate = processor; MPPHandLandmarker *handLandmarker = [[MPPHandLandmarker alloc] initWithOptions:options error:nil];

Các lựa chọn về cấu hình

Tác vụ này có các tuỳ chọn cấu hình sau đây cho ứng dụng iOS:

| Tên tuỳ chọn | Mô tả | Phạm vi giá trị | Giá trị mặc định |

|---|---|---|---|

running_mode |

Đặt chế độ chạy cho tác vụ. Có 3 chế độ: HÌNH ẢNH: Chế độ cho dữ liệu đầu vào là một hình ảnh. VIDEO: Chế độ cho các khung hình đã giải mã của video. LIVE_STREAM: Chế độ phát trực tiếp dữ liệu đầu vào, chẳng hạn như từ máy ảnh. Ở chế độ này, bạn phải gọi resultListener để thiết lập trình nghe nhận kết quả một cách không đồng bộ. Ở chế độ này, bạn phải đặt handLandmarkerLiveStreamDelegate thành một thực thể của lớp triển khai HandLandmarkerLiveStreamDelegate để nhận kết quả phát hiện điểm đánh dấu trên tay một cách không đồng bộ.

|

{RunningMode.image, RunningMode.video, RunningMode.liveStream} |

RunningMode.image |

numHands |

Số lượng tay tối đa mà trình phát hiện điểm đánh dấu tay phát hiện được. | Any integer > 0 |

1 |

minHandDetectionConfidence |

Điểm tin cậy tối thiểu để quá trình phát hiện bàn tay được coi là thành công trong mô hình phát hiện lòng bàn tay. | 0.0 - 1.0 |

0.5 |

minHandPresenceConfidence |

Điểm tin cậy tối thiểu cho điểm hiện diện của bàn tay trong mô hình phát hiện điểm đánh dấu bàn tay. Ở chế độ Video và chế độ Phát trực tiếp, nếu điểm số về độ tin cậy của sự hiện diện của bàn tay từ mô hình điểm đánh dấu bàn tay thấp hơn ngưỡng này, thì tính năng Điểm đánh dấu bàn tay sẽ kích hoạt mô hình phát hiện lòng bàn tay. Nếu không, một thuật toán theo dõi tay gọn nhẹ sẽ xác định vị trí của(các) tay để phát hiện các điểm đánh dấu tiếp theo. | 0.0 - 1.0 |

0.5 |

minTrackingConfidence |

Điểm tin cậy tối thiểu để tính năng theo dõi chuyển động tay được coi là thành công. Đây là ngưỡng IoU của hộp giới hạn giữa các bàn tay trong khung hình hiện tại và khung hình cuối cùng. Ở chế độ Video và chế độ Truyền trực tuyến của Điểm đánh dấu tay, nếu không theo dõi được, Điểm đánh dấu tay sẽ kích hoạt tính năng phát hiện tay. Nếu không, tính năng này sẽ bỏ qua tính năng phát hiện tay. | 0.0 - 1.0 |

0.5 |

result_listener |

Đặt trình nghe kết quả để nhận kết quả phát hiện một cách không đồng bộ khi điểm đánh dấu tay ở chế độ phát trực tiếp.

Chỉ áp dụng khi chế độ chạy được đặt thành LIVE_STREAM |

Không áp dụng | Không áp dụng |

Khi chế độ chạy được đặt thành phát trực tiếp, Hand Landmarker yêu cầu thêm tuỳ chọn cấu hình handLandmarkerLiveStreamDelegate, cho phép Hand Landmarker phân phối kết quả phát hiện điểm đánh dấu trên tay một cách không đồng bộ. Phương thức uỷ quyền phải triển khai phương thức handLandmarker(_:didFinishDetection:timestampInMilliseconds:error:) mà Hand Landmarker gọi sau khi xử lý kết quả phát hiện điểm đánh dấu trên tay cho mỗi khung hình.

| Tên tùy chọn | Mô tả | Phạm vi giá trị | Giá trị mặc định |

|---|---|---|---|

handLandmarkerLiveStreamDelegate |

Cho phép Hand Landmarker nhận kết quả phát hiện điểm đánh dấu trên tay một cách không đồng bộ ở chế độ phát trực tiếp. Lớp có thực thể được đặt thành thuộc tính này phải triển khai phương thức handLandmarker(_:didFinishDetection:timestampInMilliseconds:error:). |

Không áp dụng | Chưa đặt |

Chuẩn bị dữ liệu

Bạn cần chuyển đổi hình ảnh hoặc khung hình đầu vào thành đối tượng MPImage trước khi truyền đối tượng đó đến Hand Landmarker. MPImage hỗ trợ nhiều loại định dạng hình ảnh iOS và có thể sử dụng các định dạng đó ở bất kỳ chế độ chạy nào để suy luận. Để biết thêm thông tin về MPImage, hãy tham khảo API MPImage.

Chọn định dạng hình ảnh iOS dựa trên trường hợp sử dụng và chế độ chạy mà ứng dụng của bạn yêu cầu.MPImage chấp nhận các định dạng hình ảnh iOS UIImage, CVPixelBuffer và CMSampleBuffer.

UIImage

Định dạng UIImage phù hợp với các chế độ chạy sau:

Hình ảnh: hình ảnh từ gói ứng dụng, thư viện người dùng hoặc hệ thống tệp được định dạng dưới dạng hình ảnh

UIImagecó thể được chuyển đổi thành đối tượngMPImage.Video: sử dụng AVAssetImageGenerator để trích xuất khung hình video sang định dạng CGImage, sau đó chuyển đổi các khung hình đó thành hình ảnh

UIImage.

Swift

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(uiImage: image)

Objective-C

// Load an image on the user's device as an iOS `UIImage` object. // Convert the `UIImage` object to a MediaPipe's Image object having the default // orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

Ví dụ này khởi tạo MPImage với hướng mặc định UIImage.Orientation.Up. Bạn có thể khởi chạy MPImage bằng bất kỳ giá trị UIImage.Orientation nào được hỗ trợ. Hand Landmarker không hỗ trợ các hướng phản chiếu như .upMirrored, .downMirrored, .leftMirrored, .rightMirrored.

Để biết thêm thông tin về UIImage, hãy tham khảo Tài liệu dành cho nhà phát triển Apple về UIImage.

CVPixelBuffer

Định dạng CVPixelBuffer rất phù hợp với các ứng dụng tạo khung và sử dụng khung CoreImage của iOS để xử lý.

Định dạng CVPixelBuffer phù hợp với các chế độ chạy sau:

Hình ảnh: các ứng dụng tạo hình ảnh

CVPixelBuffersau khi xử lý một số hình ảnh bằng khungCoreImagecủa iOS có thể được gửi đến Hand Landmarker ở chế độ chạy hình ảnh.Video: các khung hình video có thể được chuyển đổi sang định dạng

CVPixelBufferđể xử lý, sau đó được gửi đến Hand Landmarker ở chế độ video.phát trực tiếp: các ứng dụng sử dụng máy ảnh iOS để tạo khung hình có thể được chuyển đổi sang định dạng

CVPixelBufferđể xử lý trước khi được gửi đến Điểm đánh dấu bằng tay ở chế độ phát trực tiếp.

Swift

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(pixelBuffer: pixelBuffer)

Objective-C

// Obtain a CVPixelBuffer. // Convert the `CVPixelBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithUIImage:image error:nil];

Để biết thêm thông tin về CVPixelBuffer, hãy tham khảo Tài liệu dành cho nhà phát triển Apple về CVPixelBuffer.

CMSampleBuffer

Định dạng CMSampleBuffer lưu trữ các mẫu nội dung nghe nhìn thuộc một loại nội dung nghe nhìn đồng nhất và phù hợp với chế độ chạy phát trực tiếp. Khung hình trực tiếp từ máy ảnh iOS được phân phối không đồng bộ ở định dạng CMSampleBuffer bằng iOS AVCaptureVideoDataOutput.

Swift

// Obtain a CMSampleBuffer. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the default // orientation `UIImage.Orientation.up`. let image = try MPImage(sampleBuffer: sampleBuffer)

Objective-C

// Obtain a `CMSampleBuffer`. // Convert the `CMSampleBuffer` object to a MediaPipe's Image object having the // default orientation `UIImageOrientationUp`. MPImage *image = [[MPPImage alloc] initWithSampleBuffer:sampleBuffer error:nil];

Để biết thêm thông tin về CMSampleBuffer, hãy tham khảo Tài liệu dành cho nhà phát triển Apple về CMSampleBuffer.

Chạy tác vụ

Để chạy Hand Landmarker, hãy sử dụng phương thức detect() dành riêng cho chế độ chạy được chỉ định:

- Hình ảnh tĩnh:

detect(image:) - Video:

detect(videoFrame:timestampInMilliseconds:) - Phát trực tiếp:

detectAsync(image:timestampInMilliseconds:)

Swift

Hình ảnh

let result = try handLandmarker.detect(image: image)

Video

let result = try handLandmarker.detect(

videoFrame: image,

timestampInMilliseconds: timestamp)

Sự kiện phát trực tiếp

try handLandmarker.detectAsync(

image: image,

timestampInMilliseconds: timestamp)

Objective-C

Hình ảnh

MPPHandLandmarkerResult *result = [handLandmarker detectInImage:image error:nil];

Video

MPPHandLandmarkerResult *result = [handLandmarker detectInVideoFrame:image timestampInMilliseconds:timestamp error:nil];

Sự kiện phát trực tiếp

BOOL success = [handLandmarker detectAsyncInImage:image timestampInMilliseconds:timestamp error:nil];

Ví dụ về mã Hand Landmarker cho thấy cách triển khai từng chế độ này một cách chi tiết hơn. Mã mẫu cho phép người dùng chuyển đổi giữa các chế độ xử lý. Bạn có thể không cần đến các chế độ này cho trường hợp sử dụng của mình.

Xin lưu ý những điều sau:

Khi chạy ở chế độ video hoặc chế độ phát trực tiếp, bạn cũng phải cung cấp dấu thời gian của khung đầu vào cho tác vụ Hand Landmarker.

Khi chạy ở chế độ hình ảnh hoặc video, tác vụ Hand Landmarker sẽ chặn luồng hiện tại cho đến khi xử lý xong hình ảnh hoặc khung hình đầu vào. Để tránh chặn luồng hiện tại, hãy thực thi quá trình xử lý trong luồng nền bằng khung iOS Dispatch hoặc NSOperation.

Khi chạy ở chế độ phát trực tiếp, tác vụ Hand Landmarker sẽ trả về ngay lập tức và không chặn luồng hiện tại. Phương thức này gọi phương thức

handLandmarker(_:didFinishDetection:timestampInMilliseconds:error:)với kết quả của điểm đánh dấu tay sau khi xử lý từng khung đầu vào. Điểm đánh dấu bằng tay gọi phương thức này không đồng bộ trên một hàng đợi điều phối nối tiếp chuyên dụng. Để hiển thị kết quả trên giao diện người dùng, hãy điều phối kết quả đến hàng đợi chính sau khi xử lý kết quả. Nếu hàmdetectAsyncđược gọi khi tác vụ Điểm đánh dấu tay đang bận xử lý một khung hình khác, thì Điểm đánh dấu tay sẽ bỏ qua khung hình đầu vào mới.

Xử lý và hiển thị kết quả

Khi chạy quy trình suy luận, tác vụ Điểm đánh dấu tay sẽ trả về một HandLandmarkerResult chứa các điểm đánh dấu tay theo toạ độ hình ảnh, các điểm đánh dấu tay theo toạ độ thế giới và kiểu tay(tay trái/tay phải) của các tay được phát hiện.

Sau đây là ví dụ về dữ liệu đầu ra của tác vụ này:

Đầu ra HandLandmarkerResult chứa ba thành phần. Mỗi thành phần là một mảng, trong đó mỗi phần tử chứa các kết quả sau đây cho một bàn tay được phát hiện:

Tay thuận

Tay thuận cho biết tay được phát hiện là tay trái hay tay phải.

Địa danh

Có 21 điểm đánh dấu tay, mỗi điểm bao gồm toạ độ

x,yvàz. Toạ độxvàyđược chuẩn hoá thành [0,0, 1,0] theo chiều rộng và chiều cao của hình ảnh tương ứng. Toạ độzthể hiện chiều sâu của điểm tham quan, trong đó chiều sâu ở cổ tay là gốc. Giá trị càng nhỏ thì điểm tham chiếu càng gần máy ảnh. Magnitude củazsử dụng gần giống với quy mô củax.Điểm mốc Thế giới

21 điểm đánh dấu tay cũng được trình bày theo toạ độ thế giới. Mỗi điểm đánh dấu bao gồm

x,yvàz, đại diện cho toạ độ 3D trong thực tế tính bằng mét, với gốc tại tâm hình học của tay.

HandLandmarkerResult:

Handedness:

Categories #0:

index : 0

score : 0.98396

categoryName : Left

Landmarks:

Landmark #0:

x : 0.638852

y : 0.671197

z : -3.41E-7

Landmark #1:

x : 0.634599

y : 0.536441

z : -0.06984

... (21 landmarks for a hand)

WorldLandmarks:

Landmark #0:

x : 0.067485

y : 0.031084

z : 0.055223

Landmark #1:

x : 0.063209

y : -0.00382

z : 0.020920

... (21 world landmarks for a hand)

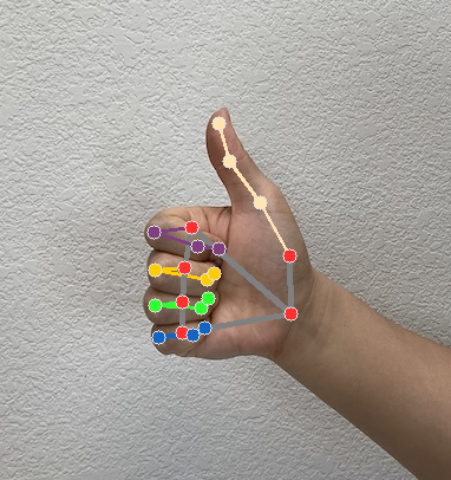

Hình ảnh sau đây cho thấy hình ảnh trực quan của kết quả tác vụ: